Vice: система автозаполнения в поиске Twitter рекомендовала пользователям строки о пытках животных и других ужасах

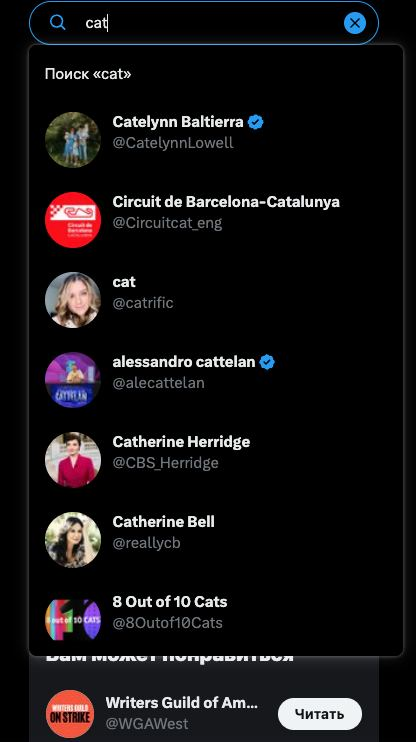

Twitter отключил автозаполнение в строке поиска после того, как пользователи обнаружили, что сервис начал рекомендовать к автозаполнению запросы с жестоким обращением с животными и другие ужасы, передаёт Vice. Ввод безобидных поисковых запросов по типу «кот» или «хомяк» начал выдавать предложения для автозаполнения по типу «хомяк в микроволновке» и «кот в блендере».

Также алгоритм активно предлагал различные фразы с отсылкой на шокирующие события и видеозаписи. Например, поиск по запросу «Вагнер» в первую очередь выдавал ссылку на казнь, «Техас» — видео со стрельбой в техасском торговом центре в начале мая этого года.

Twitter «исправил» проблему отключением автозаполнения. На текущий момент поиск по указанным запросам выдаёт предполагаемых пользователей.

Неясно, почему сервис внезапно начал предлагать множество фраз с негативным и насильственным окрасом. Twitter не ответил на запрос Vice с просьбой прокомментировать ситуацию.