[Перевод] Глубинное обучение: критическая оценка

Резюме

Хотя корни глубинного обучения уходят в прошлое на десятилетия, ни сам термин «глубинное обучение», ни этот подход, не были так популярны до того момента, когда пять лет назад в эту область вдохнули новую жизнь такие работы, как уже ставшее классическим исследование от 2012 года за авторством Крижевский, Сутскевер и Хинтон о глубинной сетевой модели Imagenet (Krizhevsky, Sutskever, & Hinton, 2012).

Что в этой области было открыто за последующие годы? На фоне внушительного прогресса в таких областях, как распознавание речи, распознавание изображений и игры, а также значительного энтузиазма в популярной прессе, я хотел бы рассмотреть десять проблем глубинного обучения (ГО), и заявить, что для создания искусственного интеллекта общего назначения (ИИОН) ГО необходимо дополнять другими техниками.

1. Приближается ли ГО к своему пределу?

Большинство задач, в которых ГО предложило принципиально новые решения (зрение, речь), в 2016–2017 годах вошло в зону уменьшающейся отдачи.

Франсуа Чоле, Google, автор библиотеки для нейросетей Keras

«Прогресс науки движется от одних похорон к другим». Будущее зависит от студента, с большим подозрением относящегося к тому, что я говорю.

Джофф Хинтон, дедушка глубинного обучения

Хотя корни глубинного обучения уходят в прошлое на десятилетия, на него обращали очень мало внимания примерно до 2012 года. Но в том году поменялось решительно всё. Была опубликована серия крайне влиятельных статей — к примеру, статья авторов Крижевский, Сутскевер и Хинтон «Классификация ImageNet при помощи глубинных свёрточных нейронных сетей», добившихся передовых результатов в распознавании образов в проекте, известном, как ImageNet. Другие лаборатории уже работали над сходными проектами [Cireşan, Meier, Masci, & Schmidhuber, 2012]. Ещё до конца года ГО попало на первую страницу The New York Times и быстро стало самой известной технологией из мира ИИ. И если основная идея тренировки нейросетей, содержащих множество слоёв, была не новой, ГО впервые стало практически применимой технологией, благодаря, в частности, увеличению вычислительных мощностей и наборов данных.

С тех пор ГО привело к получению множества передовых результатов в таких областях, как распознавание образов, распознавание речи, перевод между языками, и играет важную роль в широком спектре текущих приложений. Корпорации уже инвестировали миллиарды долларов в борьбе за таланты ГО. Один из известных сторонников ГО, Эндрю Ын, даже предположил, что «если обычный человек может решить задачу, подумав над ней менее секунды, мы, вероятно, сможем автоматизировать её решение при помощи ИИ либо уже сейчас, либо в ближайшем будущем». Недавняя статья в журнале New York Times Sunday Magazine, в основном посвящённая ГО, утверждает, что технология предназначена для «переизобретения самого процесса вычислений». Однако же ГО вполне может приближаться к своему пределу, как я и предсказывал ранее, в начале возрождения этой темы, и как начали говорить такие люди, как Хинтон [Sabour, S., Frosst, N., & Hinton, G. E. (2017). Dynamic Routing Between Capsules] и Чоле [Chollet, F. (2017). Deep Learning with Python. Manning Publications] в последнее время.

Что такое ГО, и что оно продемонстрировало нам по поводу природы интеллекта? Что от него можно ожидать, и когда можно ожидать его провала? Как близко или далеко мы находимся от «искусственного интеллекта общего назначения» (ИИОН), и точки, в которой машины начнут показывать сравнимую с людьми гибкость в решении неизвестных задач? Цель этой работы — придержать иррациональный рост этой темы и рассмотреть, что нам необходимо привнести в эту область, чтобы двигать её далее.

Эта работа написана как для исследователей в данной области, так и для растущего количества потребителей ИИ, не так сильно подкованных технически, но желающих понять, куда движется эта область. Поэтому я начну с небольшого, не очень технического введения, нацеленного на то, чтобы объяснить, что у систем с ГО получается хорошо и почему (раздел 2), перед тем, как перейти к оценке слабых сторон ГО (раздел 3) и некоторых страхов, появляющихся из-за недопонимания возможностей ГО (раздел 4), а потом закончу на перспективах движения вперёд (раздел 5).

ГО вряд ли исчезнет, да это и не нужно. Но после пяти лет с момента возрождения области неплохо критически осмотреть достижения, а также то, чего ГО не смогло достичь.

2. Что такое глубинное обучение и что у него получается хорошо

ГО в первую очередь — статистическая техника классификации закономерностей на основе пробных данных с использованием многослойных нейросетей.

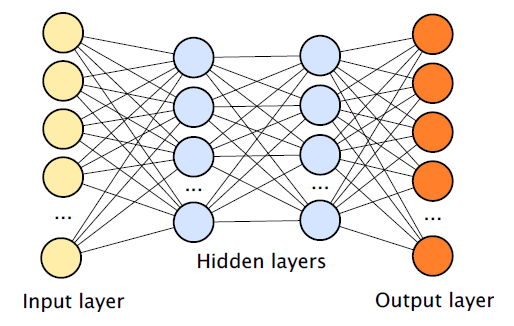

Нейросети, описываемые в литературе по ГО, обычно состоят из набора модулей ввода, принимающих такие данные, как пиксели или слова, множества скрытых слоёв (чем больше слоёв, тем глубже сеть), содержащих скрытые модули (известные также, как узлы или нейроны), и набора модулей вывода, с учётом наличия связей между различными узлами. В типичном случае такую сеть можно натренировать, например, на большом наборе написанных от руки цифр (это входные данные в виде изображений) и меток (выходные данные), определяющих категории, к которым принадлежат входные данные (это изображение — 2, это — 3, и так далее).

Со временем алгоритм обратного распространения ошибки позволяет процессу под именем градиентный спуск подправлять связи между модулями так, чтобы любые входные данные приводили к выдаче соответствующих выходных данных.

В целом связь между вводом и выводом, которую изучает сеть, можно представлять себе как построение карты соответствия. Нейросети, особенно имеющие множество скрытых слоёв, очень хорошо справляются с построением соответствия между вводом и выводом. Эти системы обычно описывают как нейросети, поскольку модули для ввода, скрытые модули и модули для вывода можно представлять себе в виде приблизительных моделей биологических нейронов, пусть и чрезвычайно упрощённые, а связь между модулями некоторым образом представляет связи между нейронами. Давний вопрос, находящийся за пределами данной работы, касается степени биологической достоверности подобных искусственных нейросетей.

Большая часть ГО-сетей использует технологию под названием «свёртка», ставящую такие ограничения на связи сети, что у них естественным образом появляется такое свойство, как трансляционная инвариантность. По сути, эта идея состоит в том, что объект может перемещаться по изображению, не теряя своей идентичности; круг в верхнем левом углу можно признать тем же самым объектом, что и круг в правом нижнем углу (даже без наличия прямых тому доказательств).

Глубинное обучение также известно способностью самостоятельно выстраивать промежуточные репрезентации — к примеру, внутренние модули, реагирующие на такие вещи, как горизонтальные линии или более сложные элементы изображения. В принципе, с бесконечным количеством данных ГО-системы могут справиться с любым конечным детерминистским сопоставлением между любыми наборами ввода и соответствующего вывода, хотя на практике их способность обучиться определённому сопоставлению зависит от многих факторов. Одна из распространённых проблем — угодить в локальный минимум, в котором система застревает с не совсем оптимальным решением, когда лучшего решения нет в числе близлежащих решений. На практике результаты с большими наборами данных обычно получаются неплохими, причём на широком круге потенциальных сопоставлений.

К примеру, в области распознавания речи нейросеть учиться сопоставлять набор звуков речи и набор меток (слов или фонем). При распознавании образов нейросеть учится сопоставлять набор изображений набору меток (к примеру, изображения машин отмечаются, как машины). В системе игры в Atari, разучиваемой сетью DeepMind, нейросети разучивают соответствие между пикселями и позициями джойстика.

Системы ГО чаще всего используются как классификационные, в том смысле, что миссия типичной сети — это решения по поводу того, к какому набору категорий (определяемому выходными модулями нейросети) принадлежит данный ввод. Используя воображение, можно представить, что возможности классификации огромны — вывод может представлять собой слова, координаты на доске для игры в го, да и практически что угодно ещё. В мире бесконечных данных и бесконечных вычислительных ресурсов вряд ли понадобятся другие технологии.

3. Границы возможностей ГО

Границы ГО начинаются с отрицания: мы живём в мире, в котором не бывает бесконечных данных. Системы, полагающиеся на ГО, часто должны заниматься обобщением за пределами определённых виденных ими данных — будь то новое произношение слова или изображение, отличающееся от того, что система уже видела до этого. Там, где данных не бесконечно много, возможности формальных доказательств, гарантирующих высокое качество работы, ограничены.

Как позже обсуждается в статье, обобщение бывает двух видов — интерполяция между двумя известными примерами, и экстраполяция, требующая выхода за пространство известных тренировочных примеров. Чтобы нейросети хорошо обобщали, им обычно требуются большие объёмы данных, а тестовые данные должны походить на тренировочные — так, чтобы новые ответы были интерполяциями между старыми. В работе Крижевского, Сацкевера и Хинтона свёрточную нейросеть с девятью слоями, 60 млн параметров и 650 000 узлов тренировали на миллионе различных примеров, разбитых по тысяче категорий.

Такой подход с использованием грубой силы хорошо работал в сильно ограниченном мире ImageNet, где все стимулы можно развести по относительно небольшому набору категорий. Также он хорошо работает в стабильных областях вроде распознавания речи, в которых образцы неизменным образом сопоставляются с ограниченным набором категорий звуков речи —, но по многим причинам ГО нельзя рассматривать (как это иногда делают в популярной прессе) в качестве общего решения ИИ.

Вот десять проблем, стоящих на пути современных ГО-систем.

3.1 ГО нуждается в данных

Люди способны выучить абстрактные связи за несколько раз. Если я скажу вам, что «шместра» — это сестра возрастом от 10 до 21 года, дав вам единственный пример, вы сразу зе сможете вычислить, если ли у вас шместра, есть ли она у вашего лучшего друга, есть ли она у ваших детей или родителей, и так далее. (Скорее всего, у ваших родителей её уже нет, если даже и была, и это вы тоже могли бы довольно быстро понять).

Обучаясь понятию «шместры», в этом случае — через чёткое определение, вы полагаетесь не на сотни тысяч или миллионы тренировочных примеров, но на возможности представлять абстрактные связи между переменными, похожими на алгебраические. Люди способны выучивать подобные абстракции, как через точное определение, так и через менее явные. Даже семимесячные младенцы способны на это — они выучивают абстрактные правила, похожие на язык, на основе небольшого количества непомеченных примеров всего за пару минут (Marcus, Vijayan, Bandi Rao, & Vishton, 1999). Последующая работа (Gervain and colleagues 2012) показывает, что младенцы способны на похожие вычисления. У ГО сейчас нету механизма для выучивания абстракций через непосредственное определение, данное вслух, и оно работает лучше с тысячами, миллионами или даже миллиардами тренировочных примеров, как делала DeepMind с играми Atari. Как утверждают Бренден Лэйк [Brenden Lake] с коллегами в нескольких недавних работах, люди гораздо эффективнее выучивают сложные правила, чем системы ГО (Lake, Salakhutdinov,

& Tenenbaum, 2015; Lake, Ullman, Tenenbaum, & Gershman, 2016). На эту тему можно посмотреть ещё работу (George et al 2017), и мою собственную работу со Стивеном Пинкером по чрезмерному упорядочиванию ошибок у детей по сравнению с нейросетями (Marcus et al., 1992).

Джофф Хинтон также беспокоился по поводу того, как ГО полагается на большое количество размеченных примеров, и выражал свои опасения в недавней работке по капсюльным сетям со своими соавторами (Sabour et al., 2017), отмечая, что свёрточные нейросети (самая популярная архитектура ГО) может встретиться с «экспоненциальной неэффективностью, которая может стать причиной их гибели. Хороший кандидат — это трудности, с которыми сталкиваются свёрточные сети при обобщениях, связанных с новыми точками зрения (например, вид на объект с другой перспективы при визуальном распознавании образов). Возможность справляться с трансляционной инвариантностью в них встроена, но при других типичных трансформациях нам приходится выбирать между воспроизводством детекторов особенностей, расположенных на экспоненциально растущей решётке и увеличением размера размеченного тренировочного набора сходным экспоненциальным образом».

В задачах с ограниченным набором данных ГО часто не является идеальным решением.

3.2 Глубинное обучение пока что имеет небольшую глубину и плохо переносит полученные знания на другие данные

Хотя ГО способно на некоторые весьма удивительные вещи, важно понимать, что слово «глубинное» относится к его технической, архитектурной особенности (большому количеству скрытых слоёв, используемому в современных нейросетях, поскольку их предшественники использовали только один слой), а не к концептуальной (репрезентации, выстраиваемые в этих сетях, нельзя естественным образом применить к каким-либо абстрактным понятиям вроде «правосудия», «демократии» или «интервенции»).

Даже более призёмлённые вещи вроде «мячик» или «противник» могут оказаться недоступными для сети. Рассмотрим пример работы DeepMind с играми Atari и обучением с подкреплением, комбинирующим ГО с подкреплением (обучаемый пытается добиться максимальной награды). Результаты, якобы, фантастические: система играет наравне или обыгрывает людей-экспертов на широком круге игр, используя единый набор «гиперпараметров», управляющих такими свойствами, как скорость изменения весов в сети, и не обладая предварительными знаниями о конкретных играх и об их правилах. Но эти результаты легко интерпретировать совершенно неверно. К примеру, согласно одному из широко распространившихся видео о том, как система обучается игре в Breakout, «после 240 минут тренировки система поняла, что организация туннеля в стене — наиболее эффективный путь достижения победы».

Но система ничего такого не поняла, она вообще не понимает, что такое туннель и что такое стена. Она просто выучила определённые действия для определённых ситуаций. Тесты с переносом — в которых систему ГО с подкреплением ставят в ситуации, немного отличающиеся от тех, на которых система тренировалась, показывает, что ГО-решения часто оказываются искусственными. К примеру, команда исследователей из Vicarious показала, что более продвинутый потомок Atari system, A3C [Asynchronous Advantage Actor-Critic] не справился с различными некритичными изменениями в игре Breakout (Kansky et al., 2017), такими, как изменение вертикального положения платформы, отбивающей мяч, или появление стены в середине экрана. Из этих демонстраций становится ясно, что нельзя присваивать системе, использующей ГО с подкреплением, способности понять, что такое платформа или что такое мяч. Такие заявления в сравнительной психологии называют ошибкой атрибуции. Дело не в том, что Atari system на самом деле каким-то образом поняла концепцию стены — система просто искусственным образом пробилась сквозь стену в рамках небольшого набора условий, на которые она была натренирована.

Моя собственная команда исследователей из стартапа Geometric Intelligence (позже купленного компанией Uber) обнаружила сходные результаты в контексте игры в слалом. В 2017 команда исследователей из Беркли и OpenAI показала, что в других играх несложно создать сходные состязательные примеры, сбивающие с толку не только оригинальный алгоритм DeepMind, DQN, но и его последователя A3C и несколько других сходных технологий (Huang, Papernot, Goodfellow, Duan, & Abbeel, 2017).

Недавние эксперименты (Robin Jia and Percy Liang, 2017) приходят к тому же выводу в другой области: работе с языком. Различные нейросети были натренированы на поиск ответов на вопросы в задаче, известной как SQuAD (Stanford Question Answering

Database), в которой целью служит подсветка слов в определённой фразе, соответствующих заданному вопросу. К примеру, в одном случае натренированная система впечатляюще правильно, определила квотербека из выигравшей Суперкубок XXXIII команды, как Джона Элвея, на основе изучения небольшого параграфа. Но Джиа и Лиян показали, что простая вставка отвлекающих от темы предложений (например, о якобы случившейся победе Джеффа Дина в другой игре серии) привела к обрушению качества работы системы. У 16 моделей медианные показатели успеха упали с 75% до 36%.

Как это часто и бывает, извлечённые при помощи ГО закономерности оказались гораздо более искусственными, чем это кажется первоначально.

3.3 У ГО пока нет естественного способа работы с иерархической структурой

Лингвист Ноам Хомский не удивился бы проблемам, описанным Джиа и Лияном. По сути большинство текущих языковых моделей на базе ГО представляют себе предложения в виде последовательностей слов, при том, что Хомский давно говорит, что язык имеет иерархическую структуру, в которой более крупные построения рекурсивно составляются из более мелких. К примеру, в предложении «подросток, ранее пересекший Атлантику, установил рекорд кругосветных полётов» основным простым предложением в составе сложного будет «подросток, установивший рекорд кругосветных полётов», а в него будет встроено дополнительное предложение «ранее пересекший Атлантику», уточняющее, какой именно подросток.

В 80-х годах в одной работе (Fodor and Pylyshyn, 1988) были описаны сходные проблемы, связанные с более ранними версиями нейросетей. В своей работе (Marcus, 2001) я предположил, что простые рекуррентные сети (SRN — предшественник современных более сложных ГО-сетей, известных, как RNN) с трудом смогут систематически представлять и расширять рекурсивную структуру различных видов незнакомых им предложений.

А в 2017-м году учёные (Brenden Lake and Marco Baroni, 2017) проверили, соответствуют ли до сих пор эти пессимистические предположения действительности. Как они написали в заголовке работы, современные нейросети «после всех этих лет всё ещё не систематичные». RNN могут «неплохо обобщать данные при небольших различиях в тренировочных и проверочных данных, но когда обобщение требует систематических композиционных навыков, RNN с треском проваливаются».

Те же самые проблемы могут появляться и в других областях, например, при планировании или при управлении моторикой, в которых необходима работа со сложной иерархической структурой, в особенности, если система обречена сталкиваться с новыми ситуациями. Непрямые свидетельства таких ситуаций можно увидеть в проблемах с переносом игр Atari, упомянутых выше, а в более общем случае — в области робототехники, в которой системы обычно не справляются с обобщением абстрактных планов в необычных ситуациях.

Основной проблемой на сегодня остаётся то, что ГО выучивает корреляции между набором особенностей, которые сами по себе «плоские», неиерархичные — что-то вроде простого, неструктурированного однорангового списка. Иерархическая структура (к примеру, синтаксические деревья, отделяющие основные и подчинённые предложения) в таких системах не представляются ни напрямую, ни внутренне. В результате ГО-системы вынуждены использовать наборы различных посредников, оказывающихся в итоге неадекватными — к примеру, позиция слова в предложении по порядку от начала.

Такие системы, как Word2Vec (Mikolov, Chen, Corrado, & Dean, 2013), представляющие отдельные слова в виде векторов, достигают скромных успехов. Некоторые системы, использующие хитроумные трюки, пытаются представлять полные предложения в векторных пространствах, пригодных для ГО (Socher, Huval, Manning, & Ng, 2012). Но, как чётко продемонстрировали эксперименты Лэйка и Барони, рекуррентные сети так и остаются ограниченными в своих возможностях достоверно представлять и обобщать богатые структуры.

3.4 ГО до сих пор с трудом работает с неточно определяемыми понятиями

Если вы не можете объяснить такие нюансы, как разница между «Джон пообещал Мэри уйти» и «Джон пообещал уйти от Мэри», вы не можете сделать выводы по поводу того, кто от кого уходит и что будет дальше. Сегодняшние машинные читающие системы достигли некоторого успеха в таких задачах, как SQuAD, где ответ на данный вопрос непосредственно содержится в тексте, но гораздо меньшего успеха в задачах, в которых выводы выходят за пределы того, что содержится в тексте — благодаря комбинированию либо нескольких предложений (многозначные выводы), либо комбинации предложений с дополнительными знаниями, которые не обозначены в данной выборке текста. Люди при чтении текста часто делают достаточно широкие выводы, не следующие из текста, на основе того, что упомянуто лишь косвенно — к примеру, выводы о характере персонажа, сделанные на основе непрямого диалога.

И хотя работы Боумэна с коллегами (Bowman, Angeli, Potts, & Manning, 2015; Williams,

Nangia, & Bowman, 2017) сделали несколько важных шагов в этом направлении, в настоящее время не существует ГО-системы, способной делать неочевидные выводы на основе знаний о реальном мире с точностью, хоть как-то приближающейся к человеческой.

3.5 ГО до сих пор недостаточно прозрачно

Относительная прозрачность нейросетей, работающих по принципу «чёрного ящика», является одной из основных тем, обсуждаемых в последние несколько лет (Samek, Wiegand, & Müller, 2017; Ribeiro, Singh, & Guestrin, 2016). В текущей реализации ГО-системы обладают миллионами и даже миллиардами параметров, определяемых разработчиками не в виде каких-то человекочитаемых списков переменных, используемых каноническими программистами (типа «last_character_typed»), а в виде их географии в рамках сложной сети (значение активности узла i в слое j в сетевом модуле k). Хотя для визуализации вкладов отдельных узлов сети в сложных сетях были сделаны определённые шаги (Nguyen, Clune, Bengio, Dosovitskiy, & Yosinski, 2016), большинство наблюдателей признают, что нейросети в целом остаются «чёрными ящиками».

Какое это имеет значение в долгосрочной перспективе, остаётся непонятным (Lipton, 2016). Если системы сами по себе достаточно надёжны и самостоятельны, это может и не иметь значения; если важно использовать их в контекстах более сложных систем, для возможности поиска ошибок это может быть критичным.

Проблема прозрачности, не решённая до сих пор, является потенциальной уязвимостью при использовании ГО в таких областях, как финансовые сделки или медицинские диагнозы, в которых использующие их люди хотели бы понять, как именно данная система пришла к данному решению. Как указала Катерина О'Нил (2016), такая непрозрачность также может привести к серьёзным искажениям.

3.6 ГО пока что плохо интегрируется с уже существующими знаниями

Основным подходом к ГО является интерпретационный, то есть, самодостаточный и изолированный от остальных собранных знаний, которые в принципе могли бы быть полезными. Работа с ГО состоит в том, чтобы найти тренировочную базу данных — набор вводных данных, связанный с соответствующими выходными данными — и научить сеть всему, что требуется для решения задачи, выучивая взаимосвязи между входными и выходными данными при помощи хитрых архитектурных вариантов, а также технологий для очистки и дополнения набора данных. Применение предыдущих знаний, имеющихся по данной задаче, за редким исключением (например, свёрточные ограничения сетей, LeCun, 1989), минимизировано.

Таким образом, например, система, используемая в работе Лерера с коллегами (Lerer et al, 2016), пытающаяся обучиться физике падающих башен, не имеет предыдущих знаний по физике (кроме того, что определено в свёртке). Законы Ньютона не вшиваются в её программу, вместо этого система строит их приближение (в рамках определённых ограничений), изучая последствия на основе сырых пиксельных данных. Как я отмечаю в своей следующей работе, исследователи ГО страдают от когнитивного искажения, запрещающего использовать предыдущие знания, даже когда они отлично известны (как это происходит в случае с физикой).

Также неясно, как можно интегрировать имеющиеся знания в ГО-систему в общем случае; в частности из-за того, что знания, представленные в таких системах, в основном сводятся к (по большей части непрозрачным) корреляциям между особенностями, а не к абстракциям количественных постулатов (таких, как, например «все люди смертны»).

Связанная с этим проблема произрастает из культуры, сложившейся в области МО, поощряющей соревнования в области решения самодостаточных, замкнутых проблем, не требующих общих знаний. Эту тенденцию хорошо демонстрирует платформа для соревнований по МО под названием Kaggle, где участники соревнуются на получение лучших результатов на заданном наборе данных. Всё, что им нужно для решения задачи, аккуратно собрано и упаковано, вместе со всеми соответствующими файлами для входных и выходных данных. В таких случаях достигнут отличный прогресс — распознавание речи и некоторые особенности распознавания изображений в принципе можно решить по парадигме Kaggle.

Проблема, однако, состоит в том, что жизнь — это не соревнование Kaggle; дети не получают всех необходимых им данных, аккуратно размещённых в одной директории диска. Обучение в реальном мире предполагает гораздо более случайное поступление данных, а задачи никто аккуратно не упаковывает. ГО отлично работает с такими задачами, как распознавание речи, где есть множество снабжённых метками примеров, но вряд ли кому-то известно, как применять ГО к проблемам с нечёткими параметрами. Как лучше всего починить велосипед, которому в спицы попала верёвка? По какой специальности мне идти на диплом, по математике или нейробиологии? Никакой набор тренировочных данных не даст нам ответов.

Проблемы, меньше связанные с категоризацией и больше — со здравым смыслом лежат вне области применимости ГО, и пока, насколько мне известно, ГО мало что может предложить для решения подобных проблем. В недавнем обзоре здравого смысла мы с Эрни Дейвисом начали с набора простых выводов, которые люди могут легко сделать без всякой прямой тренировки — например, кто выше, принц Уильям или его сын-младенец принц Джордж? Можно ли сделать салат из синтетической футболки? Если воткнуть булавку в морковку, где появится дырка — в морковке или в булавке?

Насколько мне известно, никто не пытался браться за такого рода задачи при помощи ГО. Такие, на первый взгляд, простые задачи, требуют от человека интегрированного знания из несопоставимых источников, поэтому они так далеко отстоят от уютного мира классификаций ГО. Они заставляют подумать о том, что для достижения человеческого уровня когнитивной гибкости наряду с ГО требуются инструменты совершенно другого рода.

3.7 ГО пока что не способно автоматически отличать причинно-следственную связь от корреляции

То, что причинно-следственная связь не есть синоним корреляции — это трюизм, однако это различие серьёзно волнует специалистов в области ГО. Грубо говоря, ГО выучивает сложные корреляции между входными и выходными особенностями, но не строит репрезентации причинно-следственных связей. ГО может легко выучить корреляцию роста и объёма словарного запаса в популяции, но ему будет не так-то просто представить способ, которым эта корреляция выводится из роста и развития людей (дети, вырастая, разучивают всё больше слов, но это не значит, что они растут из-за разучивания слов). Причинно-следственная связь была основой в некоторых других подходах к созданию ИИ (Pearl, 2000), но, вероятно, ГО не приспособлено к таким задачам, и решать их в этой области практически никто не пытался.

3.8 ГО представляет по большей части стабильный мир, причём так, что это в некоторых случаях может представлять проблемы

Логика ГО такова, что она, скорее, будет хорошо работать в очень стабильных мирах — например, в настольной игре го, правила которой не меняются, и хуже работать в таких постоянно изменяющихся системах, как политика и экономика. Касаемо применения ГО для таких задач, как предсказание стоимости акций, есть большая вероятность, что этот подход повторит судьбу проекта Google Flu Trends, изначально отлично предсказывавшего эпидемиологические данные по поисковым запросам, а потом совершенно пропустившего такие вещи, как пик сезона гриппа 2013 года (Lazer, Kennedy, King, & Vespignani, 2014).

3.9 ГО пока что хорошо работает в роли аппроксимации, но его ответам часто нельзя полностью доверять

Частично в результате других описанных в этой секции проблем, ГО-системы хорошо работают на большой части задач выбранной области, однако их легко обмануть.

Растущий набор работ демонстрирует эту уязвимость — от лингвистических примеров Джиа и Лияна, упомянутых выше, до широкого спектра демонстраций в области компьютерного зрения, когда ГО-системы путают изображения, раскрашенные в жёлто-чёрные полосы со школьными автобусами (Nguyen, Yosinski, & Clune, 2014), а заклеенные наклейками указатели парковки с хорошо набитыми холодильниками (Vinyals, Toshev, Bengio, & Erhan, 2014) — при том, что в остальных случаях результаты работы выбранных систем впечатляют.

Из недавних ошибок можно упомянуть слегка повреждённые знаки «стоп» из реального мира, которые система спутала со знаками ограничения скорости (Evtimov et al., 2017), и распечатанные на 3D-принтере черепашки, которых спутали с ружьями (Athalye, Engstrom, Ilyas, & Kwok, 2017). В недавних новостях промелькнула история о проблемах британской полиции, чья система с трудом отличала изображения обнажённых тел от песчаных дюн.

Возможность обмануть ГО-систему, вероятно, впервые была упомянута в работе Цегеды (Szegedy et al, 2013). Четыре годя спустя, несмотря на активную исследовательскую деятельность, никакого надёжного решения этой проблемы не было найдено.

3.10 Глубинное обучение тяжело использовать в прикладных целях

Ещё один факт, следующий из всех упомянутых проблем — ГО не подходит для надёжного решения прикладных задач. Как писала команда авторов из Google в 2014-м, в заголовке важного эссе, на которое так и не было получено ответа (Sculley, Phillips, Ebner,

Chaudhary, & Young, 2014), МО — это «кредитная карточка с технической задолженностью и высокими процентами», что означает, что делать системы, работающие на ограниченном наборе условий довольно легко (достижение краткосрочных целей), но очень сложно гарантировать, что они будут работать в других условиях с неизвестными данными, которые могут не походить не предыдущие тренировочные данные (долгосрочные цели, особенно когда одна система используется в качестве элемента другой, более крупной).

В важном докладе на ICML Леон Ботто в 2015-м сравнил МО с развитием мотора самолёта, и отметил, что хотя разработка самолётов основывается на построении сложных систем из множества простых, для которых возможно получить гарантии надёжной работы, МО не хватает способности давать схожие гарантии. Как отметил Питер Норвиг из Google в 2016-м, МО не хватает инкрементальности, прозрачности и возможности поиска ошибок, присущих классическому программированию, и в МО определённая простота работы меняется на наличие серьёзных проблем с надёжностью.

Хендерсон с коллегами недавно расширили это мнение, сконцентрировавшись на ГО с подкреплением, и отметив несколько серьёзных проблем в областях, связанных с надёжностью и воспроизводимостью (Henderson et al., 2017).

Хотя в автоматизации процесса разработки МО-систем был достигнут определённый прогресс (Zoph, Vasudevan, Shlens, & Le, 2017), сделать ещё предстоит очень много.

3.11 Обсуждение

Конечно же, глубинное обучение, само по себе — это просто математика; описанные выше проблемы появляются не потому, что лежащая в основе ГО математика где-то ошибается. В целом ГО — прекрасный способ оптимизации сложных систем для репрезентации взаимосвязей между входными и выходными данными на достаточно большом наборе данных. Реальная проблема состоит в непонимании того, для чего ГО подходит хорошо, а для чего — не подходит. Техника отлично справляется с проблемами чёткой классификации, в которых широкий спектр потенциальных сигналов необходимо разметить по ограниченному количеству категорий, учитывая, что система хватает данных, а проверочный набор сильно напоминает тренировочный.

Но отклонения от этих предположений могут привести к проблемам; ГО — это всего лишь статистическая технология, а все статистические технологии страдают от отклонения от первоначальных предположений.

ГО-системы работают уже не так хорошо, если данных для тренировки оказывается не очень много, или если проверочный набор отличается в важных вещах от тренировочного, или если набор проверочных примеров широк и наполнен совершенно новыми вещами. А некоторые проблемы в реальном мире вообще нельзя отнести к проблемам классификации. К примеру, к пониманию естественного языка нельзя подходить, как к задаче классификационного построения соответствия между большим конечным набором предложений и большим, конечным набором других предложений. Это, скорее, разметка соответствия между потенциально бесконечным набором входящих предложений, и таким же по объёму набором смыслов, многие из которых могли ранее не встречаться. В такой задаче ГО становится квадратным колышком, который забивают в круглое отверстие — грубым приближением в случае, когда решение должно находиться где-то в другом месте.

Один хороший способ интуитивно понять, почему чего-то не хватает — это рассмотреть набор экспериментов, проведённых мною в 1997 году, когда я проверял некие упрощённые аспекты разработки языков на классе нейросетей, который тогда был популя