Технология будущего. Зачем нужен LIDAR, который появился в iPad Pro

Судя по анализу железа нового iPad Pro, его главная, если не единственная хардверная особенность это новый датчик расстояния LiDAR.

Apple говорит, что NASA отправит с ним людей на Марс, а многие думают, что это прокаченный Face ID. Но как его будут использовать разработчики многие пока не понимают.

Разобрались, в каких индустриях лидар используют прямо сейчас, чем его датчик отличается от чёлки в айфоне и кому на самом деле нужно это минорное обновление планшета.

Спойлер: произошла революция.

Как работает обычный лидар

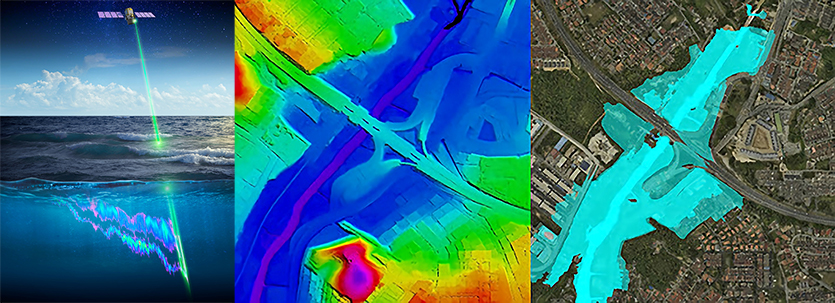

Слева видно, как сенсор составляет 3D карту вокруг себя, а справа — как он улавливает луч от поверхности. Источники: раз, два

По принципу работы радар и лидар отличаются только в источнике энергии, которым они измеряют величины. В первом это радио-волны, во втором лазер. Чаще всего инфракрасный, не видимый человеком.

Название LiDAR идёт от аббревиатуры light detection and ranging, на русском как «обнаружение и определение дальности через свет»

Простейшая система работы такая:

- 1. Излучатель бьёт лазером

- 2. Ресивер получает его обратно

- 3. Компьютер рассчитывает время возвращения луч

- 4. Формируется информация о расстоянии до объекта

Технология удобна тем, что скорость света всегда одна. Так можно составить карту местности, улицы или комнаты. Масштаб в основном зависит от размера датчиков.

Например, вот здесь можно пощупать дату, которая получается на выходе сенсора для автомобилей OS1 от компании OUSTER.

Действие дальнобойного автомобильного датчика OUSTER OS2

NASA составила огромный список того, что умеют лидеры разного типа.

В зависимости от размера и точности сенсора, можно получить следующие данные:

Дальность и высоту Температуру Диффузию и плотность газа Степень облачности Скорость ветра Форма и размер ландшафта Высоту и плотность лесов Шероховатость морской поверхностиИзлучателя отличаются размерами, мощностью, типом лучей, их количеством, статичностью и многим другим. Их цепляют на спутники, самолёты, дроны и автомобили.

Учитывая, сколько материала можно собрать и обработать, естественно, что лидар нужен в десятке разных областей. Пройдёмся по некоторым.

Технологию применяют в автопилотах, космосе и земледелии

С помощью сенсора можно предположить, сколько земли зальёт при наводнении

С помощью сенсора можно предположить, сколько земли зальёт при наводнении

Все сканеры работают за счёт лучей, но от их количества зависит площадь покрытия. Это может был один лазер, который сканирует плотность газа или полоса, которая формирует карту глубины двухмерной территории как на примере выше.

В третьем виде излучатель бьёт квадратным полем, как это сделано в iPad Pro, и формирует объёмный отпечаток помещения, здания или метеорита.

Самоуправляемые машины могут показаться самым очевидным применением. Почти каждая компания внедряет их по несколько штук за раз в свои проекты.

С другой стороны, Элон Маск год назад агрессивно противился им и сказал, что распознавание объектов эффективнее. Директор ИИ в Tesla Андрей Карпати считает лидар ненадёжным костылём по той же причине.

Анализ биосферы проводят датчиками намного больше. У NASA есть список миссий с отчётами по ним. Здесь исследуют состояние озонового слоя, ищут связь связь выбросов и климата и изучают экосистему. Для последнего иногда даже берут спутники.

Но в основном в самолёты или дроны встраивают лазеры с приёмником, которые как валик с краской покрывают территорию под собой. А учёные на базе этих данных строят карты материалов и грунта.

Агрикультура и городское планирование занимают первое место по применению именно из-за этого. Анализ земли и воздуха помогает выбрать места для плодородных полей и такие, чтобы избежать оползней и загрязнённого воздуха.

LiDAR не умеет делать то, что может Face ID. И наоборот

Поняли, что лидар стреляет лазером из дронов, самолётов и спутников. В iPad Pro это работает по тому же принципу, но на минималках.

Не понятно, может ли Apple софтверно научить лидар анализировать воздух, а вот составить карту местности, пусть и не большой, он уже умеет.

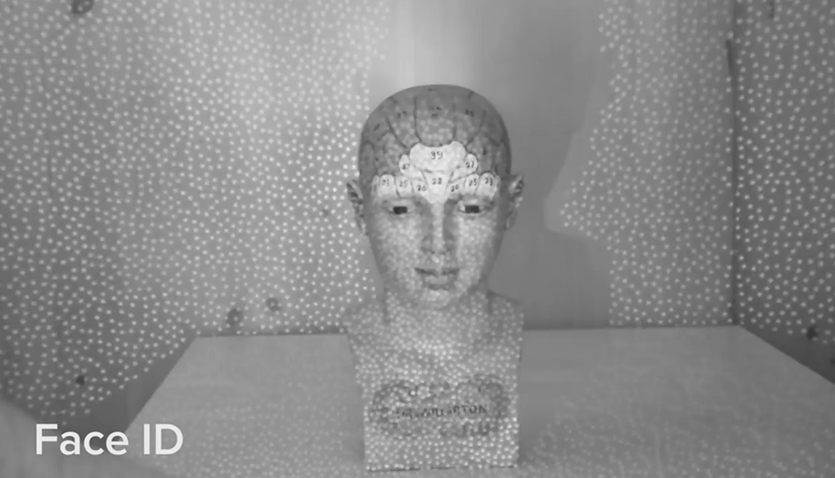

В планшете стоит не один луч, а 1152 в шахматном порядке.

Расчёт сделал так. Судя по изображению в обзоре, айпэд выпускает лазеры в 9 секторов. В каждом по 8 точек на ряд, который дублируется по диагонали. Получаем 8×8*2×9=1152.

Лучи крупнее в диаметре и намного дальше друг от друга, чем в Face ID. Планшет технически не сможет составить точную карту глубины, потому что не считает волосы и даже крупные детали, например уши. Поэтому портретного режима в нём нет.

Зато у LiDAR шире покрытие. В отличие от Face ID работает это приблизительно так:

- 1. Излучатель бьёт дальше крупными точками

- 2. Обновлённый «приёмник» лучше их собирает

- 3. Процессор A12Z собирает из отметок полигоны

- 4. Из полигонов под разными углами составляется карта

В итоге получается цифровой отпечаток помещения, а не вашего лица. Просто из-за других целей инженеры масштабировали проектор.

Точный сенсор айпэда нужен везде. Развлечениям и образованию особенно

Пока система стоит в сравнительно непопулярном устройстве, ей мало кто будет пользоваться. Вот только парк AR-устройств уже огромный и компании времени не теряли.

Всё те же люди продолжат использовать AR-приложения, просто намного чаще. Раньше текстуры прыгали друг на друга, а положение объектов неудачно отлёживалось.

Теперь проблема отвалилась, и некоторые индустрии могут с большей охотой подрубать сканер. Например:

- 1. Студенты и профессоры с приложением по анатомии

- 2. Дизайнеры квартир с быстрым составлением плана

- 3. Ритейл вроде IKEA, который удобно покажет свои товары

- 4. Музеи смогут рендерить скульптуры, а не только картины

Это та часть, которая хоть как-то активна в дополненной реальности. Скорее всего, теперь к ней увереннее подключится спорт и бьюти-сфера.

Apple такая же технологичная компания, как и все остальные. Бывает, что инновации не заходят в массы, как это было с 3D Touch, и их постепенно выпилывают. Но мне кажется, что LiDAR за следующие десятилетие взлетит до ключевой технологии. Вот почему.

В ближайшие годы сканер рискует стать стандартом из-за AR

Катастрофические условия для микро-зрачка iPhone 7. А планшет стоит почти как настоящий

Катастрофические условия для микро-зрачка iPhone 7. А планшет стоит почти как настоящий

Если у вас iPhone 7 или новее, откройте сайт Apple и активируйте режим дополненной реальности, например с iPad или MacBook Pro.

За последние пару крупных апдейтов iOS функцию так прокачали, что смартфон больше не греется и глючит по минимуму, когда дополняет окружение. Отслеживание позиции тоже стало лучше, а с лидаром объекты будут буквально прилипать к сетке, которую айфон построит в реальном времени.

Этот опыт будет идеальным, чтобы люди начали включать игры и приложения не на один раз рад интереса, а пользовались ими постоянно.

А там и до звонков по Face Time в стиле Звёздных Войн недалеко. Взгляд уже научились заменять на искусственный в iOS 13.

Дополненная реальность уже здесь и у неё нет финала

То, что раньше было неудачным Kinect для Xbox, переродилось в киллер-фичу iOS

То, что раньше было неудачным Kinect для Xbox, переродилось в киллер-фичу iOS

Пока я искал информацию для материала, заметил одну вещь. Большинство заголовков о развитии лидаров вышли в последние два года, и в основном в 2019. Видно, что индустрия плотно развивается, в ней около десятка конкурентов и впереди много лет прогресса.

Всё потому что AR настолько среди нас, что мы пропустили переломный момент.

Бесконечные маски в Инстаграме, перебрасывающие сразу на сайт QR-метки, грядущие уведомления об опасных контактах от коллаборации Apple | Google.

В общем, реальности смешиваются и, как это бывает с прогрессом, незаметно для его участников. LiDAR может станет ступенью для осязания всего процесса.

Ходит много слухов о том, что грядущие iPhone 12 Pro тоже оснастят таким сенсором. С учётом потенциала и места для улучшения технологии, легко верю в то, что Apple лучше нас понимает важность лидара, а для использования AR сканер станет критичным параметром.

Похоже, в 2020-м смартфон начнёт отбивать своё название полноценно.

А мы, наконец, будем открывать AR-аппы, потому что они начнут работать так, как любит Apple. Как магия.