Состоялся релиз Stable Diffusion 2.0

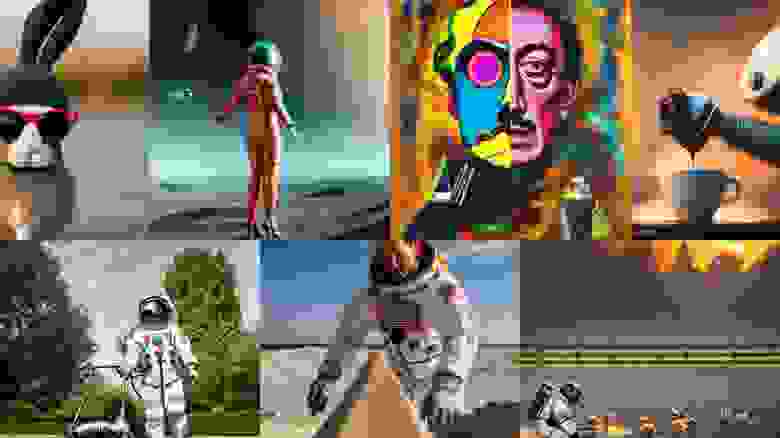

Stability AI сообщила о выпуске модели машинного обучения для генерации изображений Stable Diffusion 2.0. Компания улучшила качество и повысила вариативность получаемых изображений.

В релиз Stable Diffusion 2.0 вошло:

разработчики перешли к использованию текстового кодировщика OpenCLIP, разработанного LAION. Это помогло улучшить качество генерируемых изображений. Модель обучается на наборе данных LAION-5B, после результат проверяется на наличие контента для взрослых с помощью NSFW-фильтра;

релиз включает в себя модуль Upscaler Diffusion, повышающий разрешение изображений в 4 раза. В итоге теперь Stable Diffusion может выдавать результаты с разрешением 2048×2048 пикселей и больше;

модуль depth2img позволяет генерировать исходное изображение и использовать его для получения новых результатов. Отмечается, что функция будет полезна для цифрового творчества.

Также разработчики рассказали, что поработали над оптимизацией. Компанию вдохновляет, что Stable Diffusion пользуется популярностью у миллионов пользователей, поэтому разработчики стремятся сделать модель как можно более доступной. Исходный код проекта и более подробное описание релиза опубликованы в репозитории GitHub.