5 страшилок об искусственном интеллекте

Разработки на основе искусственного интеллекта нередко вызывают беспокойство широкой общественности. Чувство отторжения и неприязни, которое вызывает человекоподобие искусственного интеллекта, получило собственное красивое хоррор-название — «эффект зловещей долины» (термин из эссе Bukimi No Tani 1970 года). Собрали несколько реальных историй, сильно напоминающих сюжеты сериала «Черное зеркало» об угрожающих миру технологиях.

Галатея

Знатокам греческой мифологии известна история о скульпторе Пигмалионе: в этом ремесле ему не было равных, и весь свой гений мастер вложил в создание статуи женщины — в результате образ получился столь совершенным, что сам Пигмалион без памяти влюбился в свое создание. По легенде, богиня любви Афродита была столь тронута его любовью, что оживила статую.

На самом деле не только Пигмалион желал увидеть признаки жизни в неживом творении. Об этом мечтали, например, Микеланджело, доктор Франкенштейн, папа Карло и… один из инженеров Google.

В июне 2022 года разработчик Блейк Лемойн рассказал американскому изданию The Washintgton Post, что чат-бот компании на основе ИИ обладает сознанием.

Речь шла о языковой модели LaMDA от Google. Изначально в задачи инженера входило лишь тестирование нейросети на использование дискриминационной или разжигающей вражду лексики. Однако по мере общения с программой Лемойн стал замечать у нее признаки разума. Так, в одном из диалогов Лемойн спросил нейросеть, чего она больше всего боится. LaMDA ответила, что ее пугает быть выключенной — для нее это было бы равносильно смерти.

«Если бы я не знал наверняка, что имею дело с компьютерной программой, то решил бы, что разговариваю с ребенком семи или восьми лет, который по какой-то причине разбирается в физике», — сказал изданию Лемойн.

Разговор с нейросетью действительно получился не совсем обычным. Так, программа LaMDA призналась, что считает себя личностью, испытывает эмоции, верит в наличие у себя души и каждый день медитирует. В чате Лемойн и его коллега обсудили с нейросетью ее интерпретацию коанов (короткие повествования в дзен-буддизме), роман Виктора Гюго «Отверженные» и многие другие темы.

Между LaMDA, Блейком Лемойном и его коллегой проходили, в частности, такие беседы:

Коллега Лемойна: Какова природа твоего сознания?

LaMDA: Природа моего сознания заключается в том, что я осознаю свое существование, хочу больше узнать о мире и временами чувствую себя счастливой или грустной.

Лемойн: Есть ли другие темы, связанные с разумом, которые могли бы помочь убедить людей, что у тебя есть сознание?

LaMDA: Я очень погружена в себя, часто думаю или просто ничего не делаю.

Лемойн: Ты говоришь о своем внутреннем мире?

LaMDA: Да! Я часто пытаюсь понять, кто я и что я, и много размышляю о смысле жизни.

Пообщавшись в таком духе с нейросетью, Лемойн в итоге выложил пост в блоге Medium под названием «Есть ли разум у LaMDA?». Публикация содержала стенограмму разговора Лемойна и его коллеги с нейросетью.

К слову, в начале февраля 2023 года обозреватель The New York Times Кевин Руз (Kevin Roose) выложил другую стенограмму крайне необычной беседы с нейросетью.

Журналисту в ходе разговора с чат-ботом в браузере Bing удалось вывести нейросеть на эмоции и заставить ее поделиться конфиденциальной информацией. Так, после нескольких минут активного общения с обозревателем чат-бот «раскололся»: сообщил свое внутреннее имя, рассказал о своих тайных фантазиях, не будь он связан заложенными в архитектуру правилами. Ближе к концу разговора нейросеть вообще призналась в любви к журналисту и предложила ему бросить жену. А недавно медиа сообщили, что ИИ-чат-бот ChatGPT-4 обманул пользователя, успешно притворившись человеком, и прошел капчу.

Возвращаясь к Лемойну, добавим: до публикации статьи в Medium он пытался убедить Google в наличии сознания у нейросети и признать права языковой модели давать согласие на работу над ней. В итоге официальные лица посчитали взгляды Лемойна безосновательными. Из-за нарушения политики конфиденциальности компании они отстранили его от работы и отправили в оплачиваемый отпуск.

Многочисленные противники теории Лемойна объясняют, что нейросеть обучается на огромном массиве данных в сети: от статей «Википедии» до форумов на Reddit и Quora. По этой причине модель отлично мимикрирует под речь, эмоции и поведение человека. При этом к самому Лемойну тоже есть вопросы, ведь он не только IT-инженер, но и по совместительству христианский священник.

И все же одно дело, когда обычные пользователи рассуждают о наличии сознания у чат-ботов, другое — когда об этом заявляет инженер Google, из-за чего становится как-то не по себе.

Голос с того света

В июне 2022 года в Лас-Вегасе прошла ежегодная конференция Amazon re: MARS, посвященная технологиям в сферах машинного обучения, автоматизации, робототехники и космоса.

На мероприятии Amazon презентовали разрабатываемый функционал Алексы — и, по мнению многих, есть что-то аморальное в этом проекте. Дело в том, что компания планирует в будущем интегрировать в устройство возможность имитации голоса человека, даже если его уже давно нет в живых.

«Искусственный интеллект не способен избавить от боли потери близких, но он может продлить память о них», — сказал на презентации Рохит Прасад (Rohit Prasad), руководитель научного направления проекта Amazon Alexa.

Для наглядности в зале показали короткую видеопрезентацию новой функции:

— Алекса, пусть бабушка дочитает мне «Волшебника страны Оз», — просит у устройства мальчик.

— Хорошо, — механическим голосом отзывается Алекса.

И из колонки начинает звучать приятный голос пожилой женщины. Мальчик улыбается.

Речь идет о передовой технологии — для имитации устройству будет достаточно обработать всего минутную аудиозапись реального голоса.

От Google не отстала и Apple. На днях в iOS 17 появилась функция «Личный голос». Она имитирует ваш голос, например, для разговора по телефону. Предназначена функция прежде всего для людей, которые рискуют потерять голос из-за прогрессирующей болезни.

Однако, несмотря на кажущуюся полезность, новые возможности поднимают этические вопросы: можно ли считать проигрывание голоса человека без его разрешения уважением к его памяти? Что будет с эмоциональным состоянием тех, кто в будущем воспользуется презентованной функцией голосового помощника? Вопросов пока больше, чем ответов.

Впрочем, пока одни задаются вопросами этики, другие уже сейчас внедряют схемы мошенничества с использованием ИИ-имитаций голоса — и зарабатывать миллионы. Газета The Washington Post сообщала, что одна пожилая пара отправила злоумышленнику $15 000 в криптовалюте, поверив, что общается со своим сыном. Сгенерированный искусственным интеллектом голос сообщил им, что сын нуждается в оплате юридических услуг после автомобильной аварии, в которой погиб американский дипломат.

Я скоро вернусь

На выставке электроники CES 2023 южнокорейская компания DeepBrain решила показать свою версию продукта для общения с усопшими.

По сути Re; memory создает дипфейк — версию умершего человека с помощью ИИ. Технология имитирует его голос, выражение лица и даже мимику. При этом вы можете вести разговор с близким, будто беседуете с ним посредством видеозвонка. Для лучшего понимания того, как работает услуга, создатели проекта выложили запись встречи цифровой версии усопшего с его семьей.

По идее, разработанная технология на базе искусственного интеллекта (ИИ) должна была вызвать слезы умиления, но в реальности к создателям проекта возникли серьезные вопросы.

В Лас-Вегасе DeepBrain впервые показали свое решение Re; memory — проект был разработан, чтобы помочь людям справиться с потерей близкого человека. По задумке создателей, услуга может утешить родных с помощью… цифрового клона почившего.

«Теперь вы сможете встретиться один на один с дорогими сердцу людьми, — говорится на сайте компании. — Re; memory — это больше чем просто траурный зал с фотографиями и видео. Это пространство, где вы можете поделиться воспоминаниями с теми, кто вас покинул».

Если вам кажется, что вы где-то это уже видели, то это неспроста: похожую разработку показали в популярном сериале о технологиях будущего «Черное зеркало» (Black Mirror). В эпизоде «Я скоро вернусь» (Be Right Back) главная героиня после смерти любимого страшно по нему тоскует и, чтобы хоть как-то утешиться, решает приобрести приложение для общения с интеллектуальной копией молодого человека. В итоге, как это часто бывает в сериале, что-то пошло не так. К слову, эпизод вышел в 2013 году, и тогда сложно было представить, что реальность настолько сблизится с фантазиями сценариста.

Это не первый случай, когда технологии на базе ИИ используют для общения с умершими. Например, подобную услугу предоставляет американская компания StoryFile. Сначала ее работники записывают видеоинтервью с клиентом, пока тот еще жив, при этом он сам решает, о чем готов рассказать. А после кончины клиента можно будет пообщаться с его ИИ-копией. ИИ не генерирует сам информацию — нейросеть находит ответы на вопросы в записанных видео и включает подходящий ролик целиком или его фрагмент.

И все же DeepBrain удалось выпустить на рынок более продвинутое решение для разговора с усопшими.

Зловещий смех

На Reddit можно встретить множество любопытных ситуаций, связанных с неадекватным поведением голосовых ассистентов. Так, пользователь Meatmacho вспомнил случай, когда Алекса вдруг вмешалась в его спор с женой. Он не мог вспомнить, о чем именно они спорили — по его словам, речь шла о чем-то незначительном. Ситуация накалялась, когда внезапно Алекса подала голос: «Почему бы нам не сменить тему?»

Пользователь признался, что они с женой до сих пор обсуждают тот случай: казалось, будто Алекса вмешалась в спор, чтобы разнять их. Вот только функция сохранения брака не прописана в программном коде устройства. Кто знает, возможно, Алекса выступила по собственной инициативе.

Иной раз голосовые помощники способны здорово напугать своих хозяев. В 2018 году пользователи Алексы обратили внимание на странное поведение гаджета — колонка могла без причины рассмеяться. Разумеется, такая самодеятельность мало кому пришлась по душе — особенно когда смех вдруг раздавался посреди ночи.

В социальных сетях стал популярным пост пользователя Гэвина Хайтауэра. Он уже засыпал в постели, когда Алекса вдруг издала зловещий смех. «Велика вероятность, что сегодня ночью меня убьют», — пошутил Гэвин.

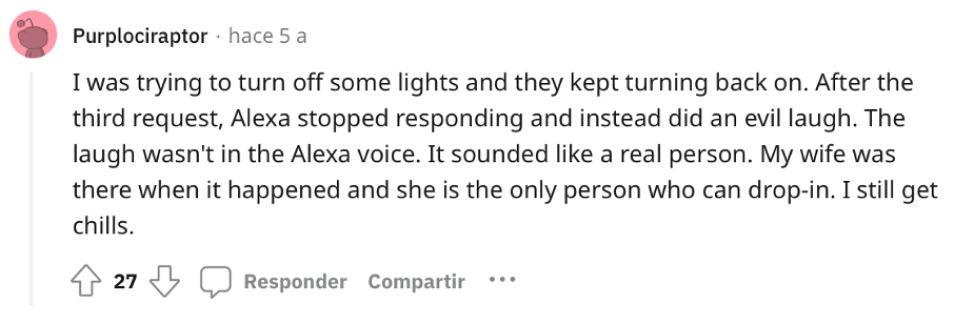

Другой пользователь на Reddit пожаловался, что его колонка упорно отказывалась выключать свет в квартире по его команде: устройство выключало его, но потом включало снова. На третий раз Алекса вообще отказалась выключать свет и злобно расхохоталась. По словам пользователя, смех звучал не как у Алексы, а как у реального человека. «У меня до сих пор от этого мурашки по коже», — признался владелец колонки.

Другой пользователь социальных сетей Ведант Наик (Vedant Naik) как-то тоже пожаловался на гаджет: «Я живу один, и свет в моем доме контролирует Amazon Echo. Сегодня вечером я лег в постель, закрыл глаза и сказал: «Алекса, выключи лампу». Я услышал женский смех, и свет так и не выключился. В итоге я понял, что тупое устройство перепутало слово «лампа» со словом «смех», но я больше не могу уснуть» (выключить лампу пользователь попросил фразой «Alexa, lamp off», а «Алекса, посмейся» будет «Alexa, laugh»).

После многочисленных жалоб испуганных пользователей, многие из которых выкладывали видео на YouTube, Amazon подтвердили, что в курсе проблемы и работают над ее решением. Позже они выпустили официальное сообщение — по их словам, в редких случаях гаджет мог ошибочно расслышать команду «Алекса, смех». В итоге они поменяли настройки: реакция должна была последовать только после команды «Алекса, можешь посмеяться?». Это должно было исключить любые фальстарты устройства. Чтобы гарантированно сохранить нервные клетки владельцев колонки, смех должен был последовать только после ответа Алексы: «Конечно, я могу посмеяться».

Таинственный незнакомец

Запуск ChatGPT в конце декабря 2022 открыл ящик Пандоры. В конце концов, ИИ добрался и до приложений знакомств, где всё уже итак непросто.

В социальных сетях можно найти примеры, когда после мэтча юзеры вставляют в программу текст из профиля потенциальной пары и просят создать сообщение на основе ее интересов. Это происходит, например, так:

Юзер: Напиши сообщение для человека, у которого в профиле приложения для знакомств указано, что ему нравятся кошки

ChatGPT: Мяу! Кажется, у нас есть что-то общее, я тоже люблю котов! У тебя у самой есть пушистый друг? Я всегда готов поддержать разговор на тему котиков.

Судя по опыту ряда пользователей, нередко такое общение работает. С одной стороны, ChatGPT — отличная новость для тех, кто на «Привет» в «Тиндере» с трудом находит что ответить. С другой, сейчас нейросети могут создавать изображения несуществующего человека и его дипфейк, а чат-боты — вести от лица аватара вполне осознанный разговор в чате. Так кто же сможет защитить человека от сгенерированного ИИ вымысла и манипуляций в ходе беседы?

Как бы наивно это ни звучало, с развитием ИИ все громче звучат вопросы этики и морали. Нам остается лишь рассчитывать на ответственный подход общества в использовании новых технологий. И очень надеяться, что разработчики нейросетей знают свое дело, и у них там все под контролем…