Конференция Nvidia GTC Europe 2018: высокопроизводительные вычисления и искусственный интеллект

Введение

Начался октябрь, а это уже традиционно означает, что настало время очередной европейской конференции GPU Technology Conference, посвященной различным применениям решений компании Nvidia. Вот уже который год эта технологическая конференция проводится не только в родной для них Калифорнии, но и в других точках нашей планеты: в Китае, Германии, Израиле, Тайване, Токио и Вашингтоне.

И так как в этот раз дело происходит в Мюнхене, то большая часть GTC снова посвящена автомобильной тематике — применению решений компании в автомобилях: информационно-развлекательных системах, системах автопилотирования и так далее. Nvidia принимает самое непосредственное участие в разработке и продвижении автономных средств передвижения вот уже несколько лет, у них есть даже полноценная платформа для автопилотов и собственный автономный автомобиль, предназначенный для обкатки соответствующих решений.

Тема автопилотов в последние годы одна из самых «горячих» — можно вспомнить об успехах Tesla и их совместных разработках с Nvidia. Да и другие компании, вроде Waymo и родного для нас Яндекса, также привлекают всеобщее внимание, тестируя автопилотируемые такси в разных уголках мира. Аналитики ожидают скорой революции в сфере автономных автомобилей, эта индустрия грозит вырасти в несколько раз буквально за одно лишь следующее десятилетие. Поэтому совершенно неудивительно, что тематическими проектами сейчас занимаются тысячи крупных компаний и маленьких стартапов.

Но не думайте, что мюнхенская GTC была посвящена исключительно автомобилям. Совсем нет, особенно если говорить о крупных анонсах — далеко не все они связаны с автомобильной тематикой. В этом году Nvidia даже в Мюнхене большое значение придавала и другим сферам применения своих продуктов — научной, финансовой, медицинской и так далее. Давайте же подробно рассмотрим все самые важные анонсы и интересные экспонаты европейской GTC.

Для тех, кому удобнее воспринимать информацию в визуальном формате, мы также подготовили и полноценный видеорепортаж с этой конференции (заранее просим прощения за качество звука — при востребованности такого формата отчетов обязуемся его в дальнейшем улучшить):

Аппаратная трассировка лучей

Ключевые выступления главы компании Nvidia — Дженсена Хуанга — всегда вызывают большой интерес. Попасть на первые ряды в зале всегда не так просто, зал для выступления на GTC забивается полностью без исключений, тут присутствует как профильная пресса, многочисленные аналитики и партнеры компании, так и сотрудники самой Nvidia.

Выход главы компании на сцену всегда сопровождается аплодисментами — присутствующие ждут интересных анонсов, порой неожиданных даже для сотрудников компании. Харизматичность Дженсена и его великолепные ораторские способности сложно оспорить — на наш взгляд, он является одним из лучших глав известных компаний в этом плане, его всегда интересно слушать. Тем более, когда ему есть о чем рассказать.

Дженсен не мог не упомянуть самую важную тему последних месяцев для Nvidia — трассировку лучей. Напомним, что технология аппаратной трассировки лучей была анонсирована на графической выставке SIGGraph 2018, а чуть позже были выпущены и графические процессоры архитектуры Turing с поддержкой ускорения трассировки лучей: игровое семейство GeForce RTX и профессиональные решения Quadro RTX.

Основной отличительной особенностью нового семейства RTX стала поддержка именно аппаратного ускорения трассировки лучей при помощи выделенных специализированных блоков, что позволяет использовать физически корректные расчеты взаимодействия лучей света, в отличие от привычной растеризации, лишь примерно имитирующей их распространение в трехмерном мире.

Анонс технологии RTX и аппаратно поддерживающих ее решений позволил разработчикам начать внедрение алгоритмов, использующих трассировку в их проектах. И пусть пока что производительность не позволяет заменить растеризацию полностью во всех случаях, но сочетание растеризации и трассировки лучей, применяемой для рендеринга части эффектов, слишком сложных или невозможных при растеризации, уже позволяет добиться заметного улучшения итогового качества.

Так как конференция GTC не игровая, а вполне серьезная, то возможности трассировки Дженсен показывал по демонстрации «The Speed of Light», посвященной 70-летию спортивных автомобилей марки Porsche, которую впервые показали на летней SIGGraph.

Эта демонстрация реального времени показывает рендеринг концепта Porsche 911 Speedster с использованием возможностей архитектуры Turing при помощи движка Unreal Engine, в последних версиях получившего поддержку технологии RTX.

Итоговое качество картинки реального времени, отрисовываемой на паре карт Quadro RTX в этой демонстрации, слабо отличается от изображений, часами рендерящихся в 3D-пакетах. Технология RTX позволяет обеспечить приличный скачок в качестве рендеринга реального времени, который эта демонстрация наглядно показывает.

Движок Unreal Engine использует физически корректный фотореалистичный рендеринг высочайшего качества, а трассировка лучей в этой экспериментальной демонстрации используется для визуализации отражений и преломлений, теней и глобального освещения, которые трудно отрисовать с таким качеством, применяя общепринятую растеризацию.

Но чуть ли не еще больше нам понравилась ускоренная на GPU визуализация с применением трассировки лучей в приложении промышленного дизайна Autodesk VRED. Чем же она так хороша? Все очень просто — рендерер VRED, кроме самой трассировки, использует еще и экспериментальную поддержку шумоподавления при помощи возможностей искусственного интеллекта — нейросети, исполняемой на тензорных ядрах GPU семейства Turing.

Такой шумодав позволяет значительно улучшить качество рендеринга в реальном времени, так как картинка, отрисованная трассировкой лучей с малым их количеством, всегда слишком шумная, а шумодав с искусственным интеллектом умеет «подрисовывать» недостающие пиксели, очень эффективно убирая практически весь шум.

В итоге изображение становится еще более качественным. Если без фильтра шумоподавления при повороте камеры или перемещении объектов картинка практически тонет в шуме, то с подобным «умным» шумодавом она всегда получается весьма приличного качества, как вы можете убедиться по этому короткому видеоролику.

Нейросети становятся все быстрее и умнее

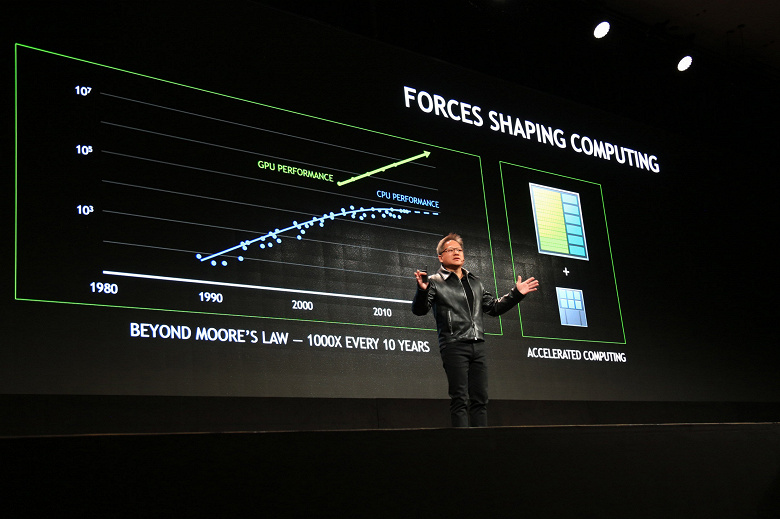

Так как конференция GTC далеко не только, да и вообще не столько о графике, то довольно быстро ключевое выступление Дженсена перешло на очень любимую им тему применения GPU в задачах искусственного интеллекта. Глава Nvidia уже довольно давно рассказывает о том, что закон Мура для универсальных процессоров мертв, но так как графические процессоры к ним не относятся, то они продолжают увеличивать свою производительность, да и вообще: за ними — будущее!

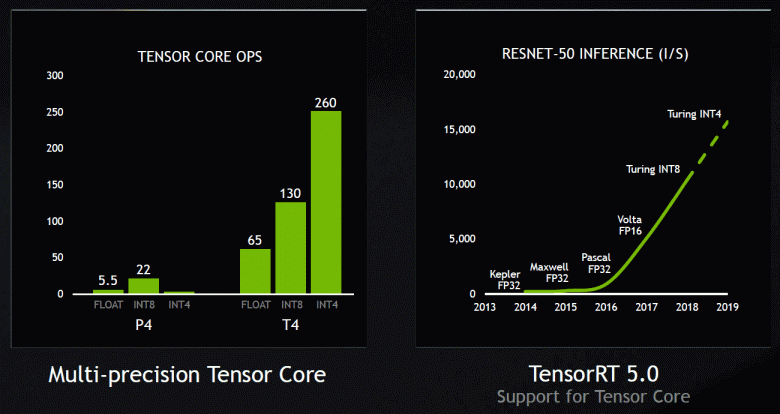

Очень сильно в росте производительности решениям Nvidia помогает внедрение тензорных ядер, предназначенных для решения задач глубокого обучения, тренировке и инференсу нейросетей, умеющих производить вычисления с различной точностью расчетов, а не только общепринятыми 32- или 64-битами. Все новые графические процессоры архитектуры Turing, а также и решения семейства Volta, умеют снижать точность вычислений до 16-, 8- и даже 4-бит, если подобное ухудшение точности расчетов допускается в конкретной задаче.

Темпы роста производительности GPU с учетом таких хитростей составляют даже не десятки, а порой сотни и тысячи раз, если брать промежуток в несколько лет. Сам Дженсен пошутил про гипотетический «закон Дженсена» (хотя он и не называл свое имя, конечно), согласно которому производительность графических процессоров должна увеличиваться в тысячу раз каждые десять лет.

В принципе, если сравнивать 32-битные вычисления с 4-битными, то можно насчитать и не такие приросты. Впрочем, эта условность не отменяет того факта, что производительность GPU действительно продолжает расти большими темпами, особенно учитывая специализацию на некоторых видах расчетов. Развитие целой отрасли высокопроизводительных вычислений уже какое-то время не опирается исключительно на темпы роста производительности универсальных процессоров, а все больше зависит от возможностей графических процессоров.

RAPIDS — ускорение машинного обучения

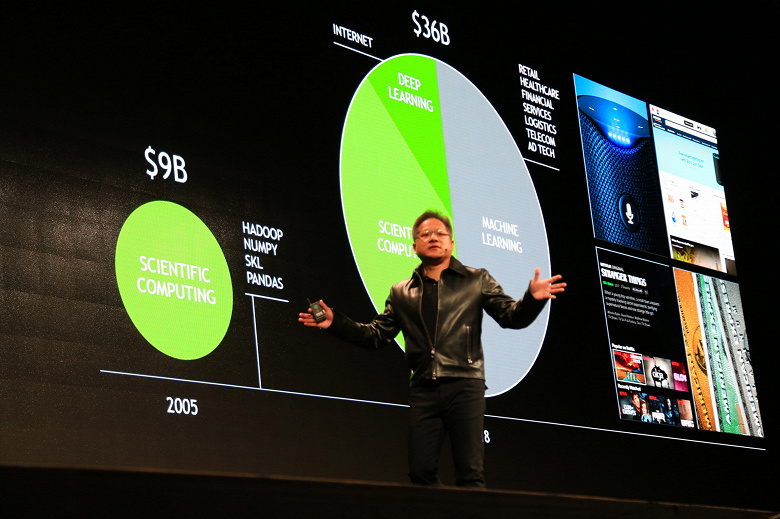

Анонсы компании на конференции GTC частенько связаны с поиском новых рынков, потенциально интересных для компании. Вот и в этот раз Дженсен совсем не просто так показывал слайд с ожидаемым объемом рынка машинного и глубокого обучения. Аналитики оценивают объем серверного рынка научных вычислений и машинного обучения в 20 миллиардов долларов в год, а вместе с глубоким обучением рынок высокопроизводительных вычислений оценивается уже в 36 миллиардов долларов в год.

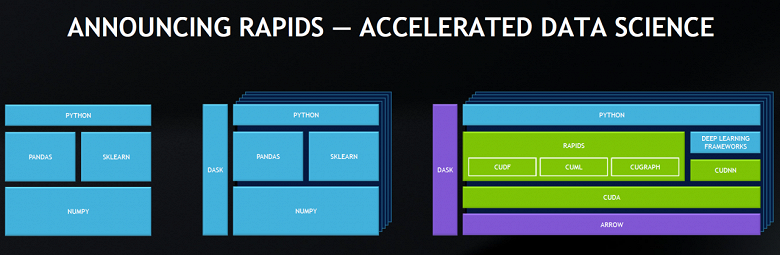

Глубоким обучением Nvidia занимается уже довольно давно, но ведь кроме нейросетей есть и масса других применений для высокопроизводительных вычислений, которые до определенного времени использовали в основном универсальные процессоры. В компании решили изменить положение дел, анонсировав набор библиотек с открытым кодом RAPIDS, который служит для комплексного анализа данных и машинного обучения — полностью на графических процессорах.

Новый набор библиотек открывает возможности оптимизированных вычислений на CUDA через высокоуровневый интерфейс Python, он работает на всех решениях компании из семейств Pascal, Volta и Turing, а объединение мощностей нескольких GPU при помощи NVLink и NVSwitch позволит в разы повысить производительность и объем общей памяти, что явно придется по вкусу исследователям, которым все время не хватает производительности.

Анонсированное в Мюнхене программное обеспечение способно обеспечить значительный рост производительности в таких сложных задачах аналитики, как прогнозирование спроса на товары и предсказание поведения покупателей для магазинов, прогнозирование случаев мошенничества в операциях с кредитными картами и многих других. Таким образом, аналитики впервые получили все необходимые инструменты, чтобы обрабатывать огромные массивы данных на GPU.

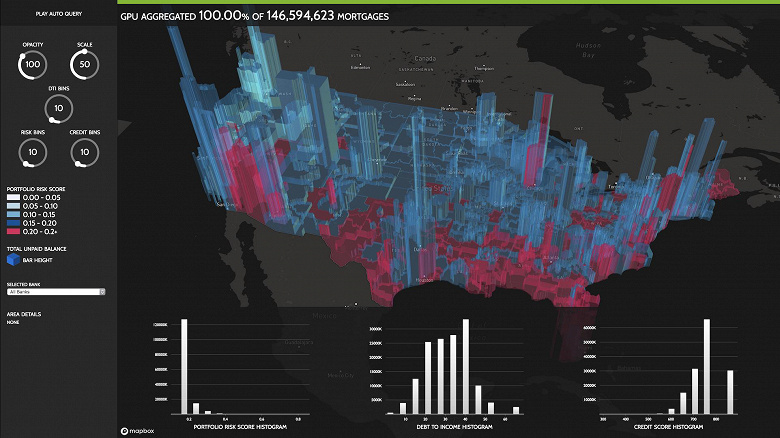

В частности, Дженсен показал весьма наглядный анализ данных крупнейшего американского ипотечного агентства Fannie Mae, которое финансирует более 20% всех ипотечных кредитов в США. Эта компания занимается поддержкой вторичного рынка ипотеки, скупая ипотечные кредиты у банков, консолидируя их и выпуская под обеспечение специальные ценные бумаги, обеспечивая финансирование для выдачи новых кредитов.

Конечно же, столь крупной компании в такой серьезной задаче крайне полезен анализ больших данных. Причем — действительно больших, ведь данные о кредитных историях миллионов человек за шестнадцать лет занимают до 400 гигабайт памяти и для их анализа требуются огромные вычислительные возможности. Все эти данные можно проанализировать и сделать прогнозы по своевременности выплат потенциальными заемщиками в том или ином случае. И для этого отлично подходит самая крупная система на основе графических процессоров — Nvidia DGX-2, если к ней добавить RAPIDS.

Дженсен показал визуализацию анализа данных о риске несвоевременных выплат ипотечных кредитов — на карте США цветом показаны регионы, в которых с выплатами по кредитам все в порядке (это голубой цвет и высокие колонки — например, Сан-Франциско), и те штаты, где все несколько печальнее — к примеру, во Флориде и Техасе.

Такими возможностями впечатлились далеко не только Fanny Mae, но и другие крупные компании, вроде Walmart — крупнейшая в мире сеть оптовой и розничной торговли. Они также нуждаются в анализе больших массивов данных и уже начали совместную работу с Nvidia с применением платформы RAPIDS.

К примеру, для ритейлеров был бы весьма полезен максимально точный прогноз востребованности товаров в магазинах, чтобы избежать их затаренности на складах или наоборот — недостатке товара в магазинах. Также об интересе к набору библиотек RAPIDS заявили и другие крупные компании: Hewlett Packard Enterprise, Cisco, Dell EMC, Lenovo, NetApp, SAP и т. д.

Высокопроизводительные системы DGX

Первые тесты набора библиотек RAPIDS на системе Nvidia DGX-2 показали 50-кратный прирост производительности по сравнению с системами на базе универсальных процессоров, что позволяет сократить время вычислений с нескольких дней до нескольких часов или с часов до минут, в зависимости от сложности задач. Неудивительно, что новый набор библиотек Nvidia получил широкую поддержку как у технологических лидеров индустрии, так и новых компаний в области разработки открытого ПО.

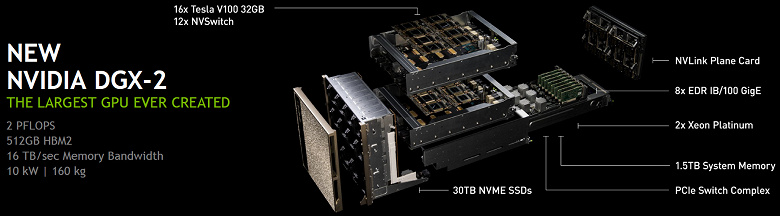

Подобные вычисления требуют большого объема высокопроизводительной оперативной памяти, и тут Nvidia есть что предложить. Даже одиночные GPU имеют по 32 ГБ памяти и более, а системы DGX-1 и DGX-2 увеличивают объем памяти до 256 и 512 ГБ, соответственно. Nvidia называет DGX-2 крупнейшей системой на основе графического процессора, она основана на шестнадцати ускорителях Tesla V100, объединенных при помощи NVSwitch, и имеет производительность до двух петафлопс, 512 ГБ быстрой памяти типа HBM2 с пропускной способностью в 16 терабайт в секунду.

Возле систем семейства DGX на выставке Nvidia частенько можно было заметить группы солидных людей, обсуждающих возможности применения этих систем в их бизнесе. Вероятно, даже сравнительно высокая цена вариантов DGX не способна смутить потенциальных покупателей на фоне высочайшей производительности графических процессоров во многих задачах, что оправдывает их приобретение. Тем более, что Nvidia планомерно расширяет и улучшает возможности программного обеспечения, предлагая не просто какие-то железки, а полноценные решения с готовым и проработанным софтом.

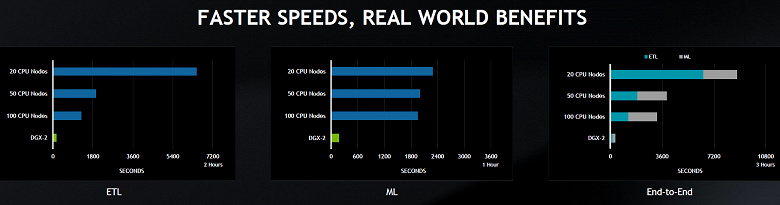

Одной из любимых тем Дженсена являются традиционные сравнения производительности систем на основе универсальных процессоров и GPU. Естественно, в максимально удачных для последних вариантах. В частности, на слайдах компании было показано сравнение производительности суперкомпьютерных систем на нескольких десятках CPU с единственной системой DGX-2. Естественно, что последняя вышла явным победителем, в десятки раз сократив время, требующееся на вычисления.

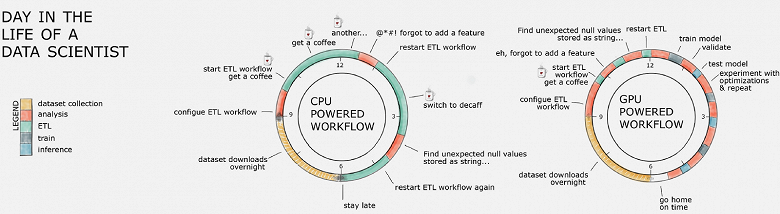

Графики производительности давно стали для нас привычными, но Дженсен показал и диаграммы распределения рабочего времени ученых, занимающихся научными вычислениями в разных сферах, которые можно ускорить при помощи графических процессоров. Специалисты, использующие универсальные CPU, занимаются конкретно работой не так уж часто, куда дольше ожидая промежуточных результатов, в перерывах попивая кофе.

В то время как ускорение задач на GPU позволяет увеличить эффективное рабочее время, сократив простои в работе. Не уверены, что это понравится всем ученым, но часть из них точно будет довольна — хотя бы те, кто не очень любит кофе. Правда, у всех пользователей систем на GPU уже не останется таких оправданий, как слишком долгие вычисления.

AGX — решения для автономных машин

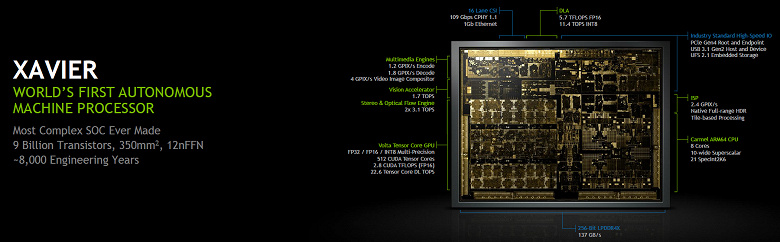

Большую часть своего выступления Дженсен посвятил различным сферам применения системы-на-чипе Xavier, которая лежит в основе таких решений новой линейки AGX, как Drive, Jetson и Clara. Все их объединяет мощная система-на-чипе Xavier, состоящая из 9 миллиардов транзисторов и различных типов вычислительных ядер, а все остальное конфигурируется — добавляются другие чипы, вплоть до пары GPU семейства Turing.

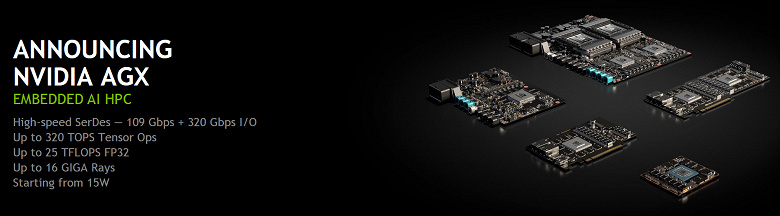

И если Jetson AGX Xavier раньше был известен просто как Xavier, то теперь он получил новое имя. Суффикс AGX ввели аналогично GTX, RTX и DGX — чтобы линейка продуктов Nvidia вся была трехбуквенной: RTX — это графические решения для развлечений и профессиональной графики, DGX — профессиональные высокопроизводительные решения, AGX — автономные машины различного формата: Drive, Jetson и Clara.

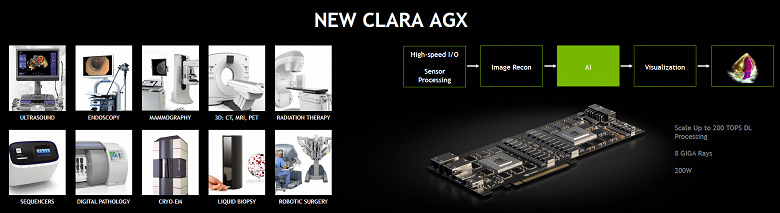

Решения линейки AGX могут быть как весьма компактные, с низким энергопотреблением в 15 ватт, так и мощнейшими вычислительными системами с 320 триллионами тензорных операций в секунду и расчетом до 16 гигалучей в секунду при трассировке. В частности, специализированный для медицинских целей вариант Clara AGX Xavier имеет в составе один GPU семейства Turing и обеспечивает скорость в 200 триллионов тензорных операций в секунду при энергопотреблении в 200 Вт.

Вычислительная платформа Nvidia Clara позволяет ускорить задачи искусственного интеллекта при обработке медицинских изображений. Платформа эта универсальная и масштабируемая, она поставляется со всеми необходимыми утилитами и инфраструктурой, чтобы ученые скорее переходили к привычному для них делу, а не занимались адаптацией и оптимизацией. По сути, Nvidia предоставляет им возможности высокопроизводительных вычислений, а уж они должны разрабатывать собственные алгоритмы уже для GPU.

В своем мюнхенском выступлении, Дженсен наглядно показал, что конкретно дает применение решений компании в медицине. Слева вы можете увидеть обычный снимок, получаемый при использовании современного медицинского оборудования, а посередине — улучшенный при помощи искусственного интеллекта вариант, в котором все внутренние органы распознаны искусственным интеллектом и подсвечены.

При необходимости, можно еще больше улучшить качество отрисовки изображения — вплоть до применения трассировки лучей, которая также поддерживается в Clara AGX (изображение справа). С ее помощью медики могут получить фактически фотореалистичные изображения интересующих их внутренних органов с максимальной точностью и детализацией.

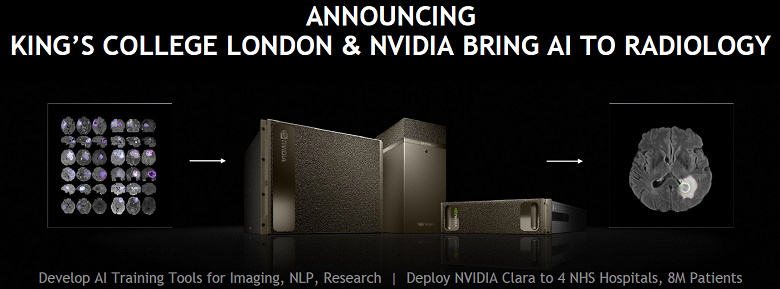

Не обошлось и без конкретных анонсов, связанных с применением Clara на практике. Один из лидеров в области медицинских исследований — Королевский Колледж Лондона — стал первым в Европе партнером Nvidia по медицине. Это учреждение уже начало использовать суперкомпьютеры Nvidia DGX-2 и платформу Clara AGX в радиологических и патологических исследованиях, чтобы улучшить лечение миллионов пациентов сразу в нескольких больницах Великобритании.

Возможности DGX-2 используются колледжем при анализе данных и обработке медицинских изображений, вроде рентгеновских снимков и других подобных исследованиях. Большое количество памяти и огромные вычислительные возможности DGX-2 позволяют обрабатывать трехмерные массивы данных буквально за минуты, а не за дни, как это делается кластерами на основе универсальных процессоров. Применение суперкомпьютера Nvidia в медицинских задачах с использованием искусственного интеллекта, позволяет ускорить процесс получения качественных снимков, что должно привести к прорывам в диагностике и лечению некоторых видов рака, к примеру.

Также решения Nvidia применяются при нанопоровом секвенировании — быстром определении последовательности молекул ДНК и РНК — в устройствах компании Oxford Nanopore. Применение нанопорового секвенирования особенно полезно для наблюдения за распространением вирусов в полевых условиях, при отслеживании распространения эпидемий Эбола и Зика. Устройства Oxford Nanopore позволяют обнаружить вирусы в биологических образцах и полевых условиях как можно быстрее.

Но при чем тут Nvidia? В карманном компьютере MinIT, подключаемом к USB-порту компьютера, используется Jetson AGX, в основе этого прибора — ячейка, позволяющая провести одновременное секвенирование до 512 молекул ДНК или РНК. А в высокопроизводительном секвенаторе PromethION, служащем для анализа больших массивов данных и включающем 48 ячеек с 3000 нанопорами каждая, установлено уже сразу четыре графических процессора Volta V100 для очень быстрой обработки данных. Применение первых устройств предпочтительно тогда, когда важна портативность в полевых условиях, а вторые обеспечивают максимально быстрое получение большого количества результатов.

Jetson AGX и роботы

После анонса решений AGX, последняя версия вычислительной платформы Jetson, предназначенной для роботов и других встраиваемых систем, получила название Jetson AGX Xavier, и она точно так же основана на мощной и сложной системе-на-чипе Nvidia, имеющей на борту множество вычислительных ядер различного назначения при сохранении довольно компактного размера — это такая небольшая черненькая коробочка.

На основе различных вариантов платформы Jetson вот уже несколько лет разрабатывается большое количество различных роботов. К примеру, в выставочном центре Мюнхена был представлен однорукий манипулятор Roboception с продвинутым компьютерным зрением, запрограммированный очень аккуратно переносить яблоки из одной коробки в другую, тщательно прицеливаясь и присасываясь к нежным плодам.

Еще одним интересным экспонатом на выставке роботов был умный мусорный бак Bin-E, автоматически сортирующий выброшенный в него мусор с использованием компьютерного зрения и распознавания образов, и использующий для этого искусственный интеллект, ускоренный на платформе Jetson. При демонстрации не обошлось без забавного казуса — сортировка сработала лишь после легкого постукивания демонстратором по баку.

И в этом году не обошлось без сельскохозяйственного применения Jetson. Компания Bilberry представила свое решение для опрыскивания удобрениями полей, также использующее компьютерное зрение и искусственный интеллект для определения «нужных» растений, которые требуется опрыскивать. Система сканирует поле и опрыскивает только необходимые участки, обеспечивая экономию удобрений до 80%.

Ну, а следующий выставочный экспонат был совсем уж необычным. Мы уже привыкли к автопилотам в наземных транспортных средствах, но ведь подобная система подходит и для других транспортных средств — морских, воздушных и даже железнодорожных. Работники из этих индустрий внимательно следят за происходящим в сфере автопилотирования, на выставке даже был замечен представитель «Российских железных дорог». А один из вариантов автопилота для морских судов, с использованием платформы Jetson и искусственного интеллекта, был представлен на выставке роботов.

Возвращаясь к выступлению Дженсена, обратим внимание на анонсированные им ранее возможности симулятора среды обучения для роботов — Isaac. В этом симуляторе применяются технологии компании для эффективного обучения умных машин в виртуальной среде, имитирующей условия реального мира еще до того, как робота с обученным искусственным интеллектом отпустят в «свободное плавание» по реальности. Это — комплексная система симуляции, предназначенная для обучения и тестирования роботов с искусственным интеллектом в сложных трехмерных средах и реалистичных сценариях.

У Nvidia есть даже свой собственный экспериментальный робот Carter, выпущенный для демонстрации возможностей их платформы Jetson, который занимается мелкими задачами в офисе компании — развозит заказанную пищу по отделам и так далее. Для начальной тренировки нейросети, на которой он основан, применялась виртуальная среда Isaac, и лишь потом уже обученный робот был выпущен в просторные офисные помещения здания Endeavour.

Новости автопилотируемой платформы Drive

Европейская часть GTC проходит в Мюнхене не просто так — именно тут сосредоточены автопроизводители и связанные с ними стартапы. Где еще, как не в сердце европейского автопрома, стоит рассказывать о достижениях, связанных с автопилотированием? И такие достижения есть.

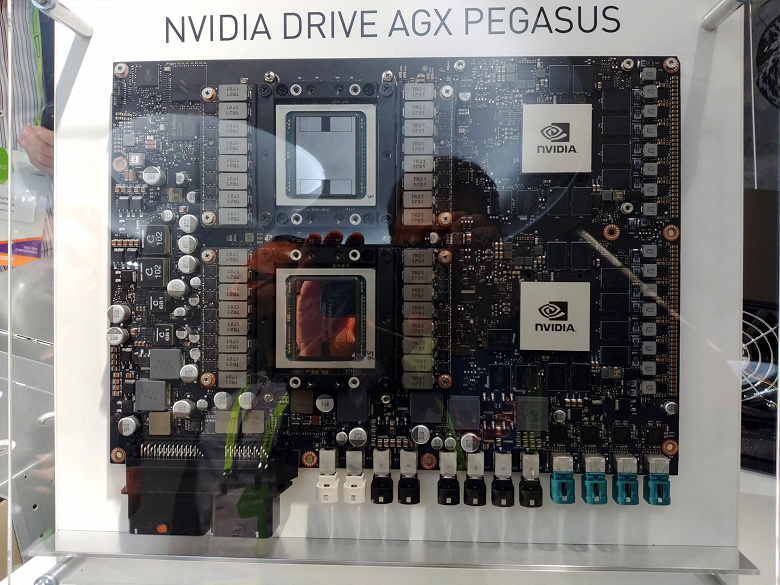

Платформа Drive AGX Xavier имеет производительность, превышающую необходимую для создания автономных автомобилей с условием многократного резервирования, но есть и более продвинутые варианты. Если Drive AGX Xavier обеспечивает 30 трлн. операций в секунду, то Drive AGX Pegasus дает скорость еще более чем в 10 раз больше, и этого уже хватит для полноценных автопилотов пятого уровня.

В плюсах у Drive AGX не только высокая производительность, но и открытость платформы, которую можно дорабатывать так, как это нужно автопроизводителям, равно как и не возбраняется использовать свой собственный набор камер и датчиков. Еще одним плюсом является поддержка обновления ПО — функции могут добавляться и улучшаться со временем, без необходимости смены аппаратной платформы, и новые возможности станут доступны покупателям без смены автомобиля на новый.

В своем выступлении Дженсен показал, на что способен автопилот компании уже сейчас. Совсем недавно прошел тестовый заезд собственного беспилотного автомобиля Nvidia BB8 по 80-километровому маршруту, расположенному в загруженном трафиком районе Кремниевой долины. Главным достижением этого путешествия стал абсолютно не требующий вмешательства человека заезд — сидящий в автомобиле водитель ни разу не вмешивался в управление транспортом.

Чтобы такой результат стал реальностью, нейросеть тренировали в том числе и в виртуальном пространстве при помощи Drive Constellation и Drive Sim. И после этого он показал себя неплохо и на реальной дороге.

Автопилот Nvidia, основанный на платформе Drive AGX Pegasus, управлял машиной полностью самостоятельно, выезжал на автостраду и съезжал с нее, по необходимости менял полосы и даже опережал другие автомобили. Дженсен уточнил, что это был не просто демонстрационный заезд в каких-то стерильных условиях и с опытным аппаратным и программным обеспечением, а то, что уже сейчас доступно всем заинтересованным лицам. «Первая в мире платформа для автономных транспортных средств» Drive AGX Pegasus уже доступна для заказов автопроизводителей.

И если предыдущие платформы автопилотирования такого уровня автономности занимали весь багажник, то финальный вариант Drive AGX Pegasus имеет размер крупного ноутбука, только потолще, потребляет куда меньше энергии, чем предыдущие решения, и способен обеспечивать работу сразу нескольких нейросетей одновременно.

Эта мощнейшая платформа на основе сразу четырех чипов (по два SoC и GPU) имеет производительность до 320 триллионов тензорных операций в секунду, и обеспечивает ПО автопилота многократным резервированием, чтобы та не полагалась при работе лишь на какой-то единственный алгоритм или датчик.

Ключевым компонентом платформы является программное обеспечение. ПО в комплекте Nvidia Drive расширяемое, оно постоянно улучшается по функциональности автопилотирования, компьютерного зрения и обработке данных. А операционная система Drive OS обеспечивает безопасную и безошибочную работу всех составляющих программной части.

С одной стороны, 80 километров полностью автономно — это уже неплохо само по себе. С другой — у некоторых конкурентов подобные поездки уже чуть ли не миллионами километров исчисляются. Впрочем, виртуальная среда, в которой BB8 также усиленно тестируется, может быстро нивелировать это преимущество, и в этом — сила Nvidia.

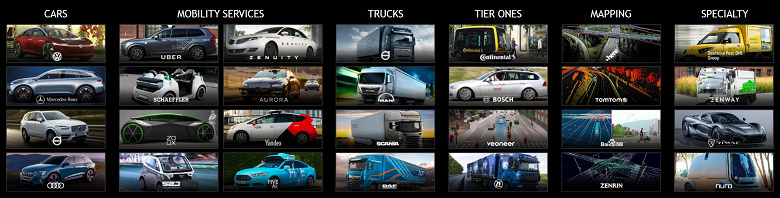

Анонсы соглашений с крупными автопроизводителями не заставили себя ждать. В своем ключевом выступлении Дженсен объявил, что шведская компания Volvo выбрала решения Drive AGX Xavier для своих будущих автомобилей с уровнем автономности 2+. Электронные мозги с искусственным интеллектом Nvidia появятся в начале следующего десятилетия в серийных моделях компании — наследниках 90-й и 60-й серий.

По словам представителей Volvo, высокоинтегрированная платформа Drive AGX Xavier позволит обеспечить быструю разработку автопилотируемой системы при одновременном сокращении затрат. Уже первые автомобили на ее основе предложат возможности, значительно превышающие способности существующих ассистентов для водителя. Инженеры двух компаний совместно работают над улучшением возможностей автопилота, включая обзор на 360 градусов и систему мониторинга состояния водителя.

Вообще, Volvo известна как активный сторонник безопасности на дорогах, и они понимают, что качественный автопилот должен снизить аварийность, так как безошибочный робот способен освободить человека как минимум от основной части работы по управлению машиной. Но для этого нужны действительно мощные вычислительные возможности и поддержка ускорения задач искусственного интеллекта, чем как раз и отличаются решения Nvidia. Именно поэтому в Volvo решили выбрать Nvidia Drive AGX Xavier — первую в мире подобную систему, сочетающую шесть различных типов вычислительных ядер, созданную специально для задач автопилотирования.

Сразу за этим анонсом последовали и другие похожие объявления — компания Continental также решила выпустить линейку автопилотируемых автомобилей и роботизированных шаттлов с применением платформ Drive AGX Xavier и Pegasus. Эта система будет масштабироваться по возможностям от уровня 2+ до четвертого, а производство автомобилей они должны начать в 2021 году.

Шведская компания Veoneer — поставщик систем автономного пилотирования — также выбрала платформу Nvidia Drive AGX Xavier для разработки собственной системы четвертого уровня под именем Zeus. Этот компьютер с искусственным интеллектом использует программное обеспечение Nvidia Drive и собственный код под авторством стартапа Zenuity, а производство автомобилей на его основе должно начаться в 2021 году.

В общем, новые системы беспилотного управления Nvidia Drive AGX с поддержкой возможностей искусственного интеллекта легли в основу сразу нескольких автомобилей с уровнем автономности от 2+, выход которых на рынок запланирован уже в 2020 году. Все они созданы на базе системы Xavier с дополнительным чипом семейства Turing, и уже очень скоро Nvidia должна начать получать от автомобильного рынка немалый доход.

Автомобили с выставки

Если продолжать разговор об автомобилях, то всего различных экземпляров на выставке было представлено более двадцати. Это и простые концептуальные модели и автопилотируемые концепты, и планирующиеся к выпуску машины и уже продающиеся экземпляры, в том или ином виде использующие решения Nvidia, вроде Мерседеса А-класса с его интуитивным пользовательским интерфейсом MBUX.

Внешне особенно выделялся Audi Elaine — взгляд на будущее автопилотируемых легковых электромобилей премиум-класса. Концепт Elaine использует искусственный интеллект, большое количество встроенных сенсоров различного типа и мощный вычислительный компьютер на основе решений Nvidia Drive, обеспечивающий ему заявленный четвертый уровень автономности. Автомобиль может двигаться без участия человека в пробках со скоростью не более 60 км/ч и на трассе со скоростью не более 130 км/ч, выполняя обгоны и меняя полосы при необходимости.

Как и многие другие концепт-кары, это — очень красивый автомобиль с футуристичной светотехникой, просто огромными колесами диаметром в 23 дюйма и матричными светодиодными блоками, а вместо обычных зеркал тут применяются модные сейчас видеокамеры. Персональный помощник Audi использует машинное обучение, чтобы прогнозировать потребности водителя и пассажиров: настраивает климат-контроль, запоминает типичные маршруты, ищет места для парковки и т. п.

Следующим упомянем собственный тестовый автономный автомобиль компании Nvidia — BB8. Уже по его внешнему виду понятна вся серьезность — количество различных сенсоров впечатляет. Тут и радары и лидары и огромное количество камер различного назначения и типа, но оно и понятно, ведь это — тестовый автомобиль для разработки собственного программного обеспечения компании, использующий платформу Nvidia Drive. На выставочном экземпляре особое внимание было уделено слежению за состоянием водителя. В котором, собственно, эта машина уже и не очень то и нуждается…

К слову о подобных возможностях — компания VisionLabs, один из лидеров в системах компьютерного зрения, анонсировала на европейской GTC функции распознавания лиц платформой Nvidia Drive. Эта технология потенциально способна заменить все ключи, обеспечив безопасный доступ к автомобилю, персонализацию его настроек и многое другое.

Платформа VisionLabs Luna является подключаемой частью платформы Nvidia Drive IX, работающей на суперкомпьютере Nvidia Drive AGX. Это решение позволит создать автомобили следующего поколения с принципиально новым подходом к управлению, но для этого искусственный интеллект в процессе идентификации должен работать максимально надежно.

Еще одним интересным экземпляром, выставленным на входе в выставочный центр Мюнхена, стал автопилотируемый электробус на основе турецкой модели Temsa MD9, показывающий будущее общественного транспорта в крупных городах. Внедрить полноценный автопилот проще всего именно в такие транспортные средства, имеющие четко выделенный маршрут и относительно низкую скорость передвижения. Собственно, автопилотируемые поезда и электрички уже существуют, почему бы и автобусам не стать такими?