Рассказываем на примере СССР, Тома Хэнкса и других… Почему невозможно отличить дешёвый дипфейк от реальных фото

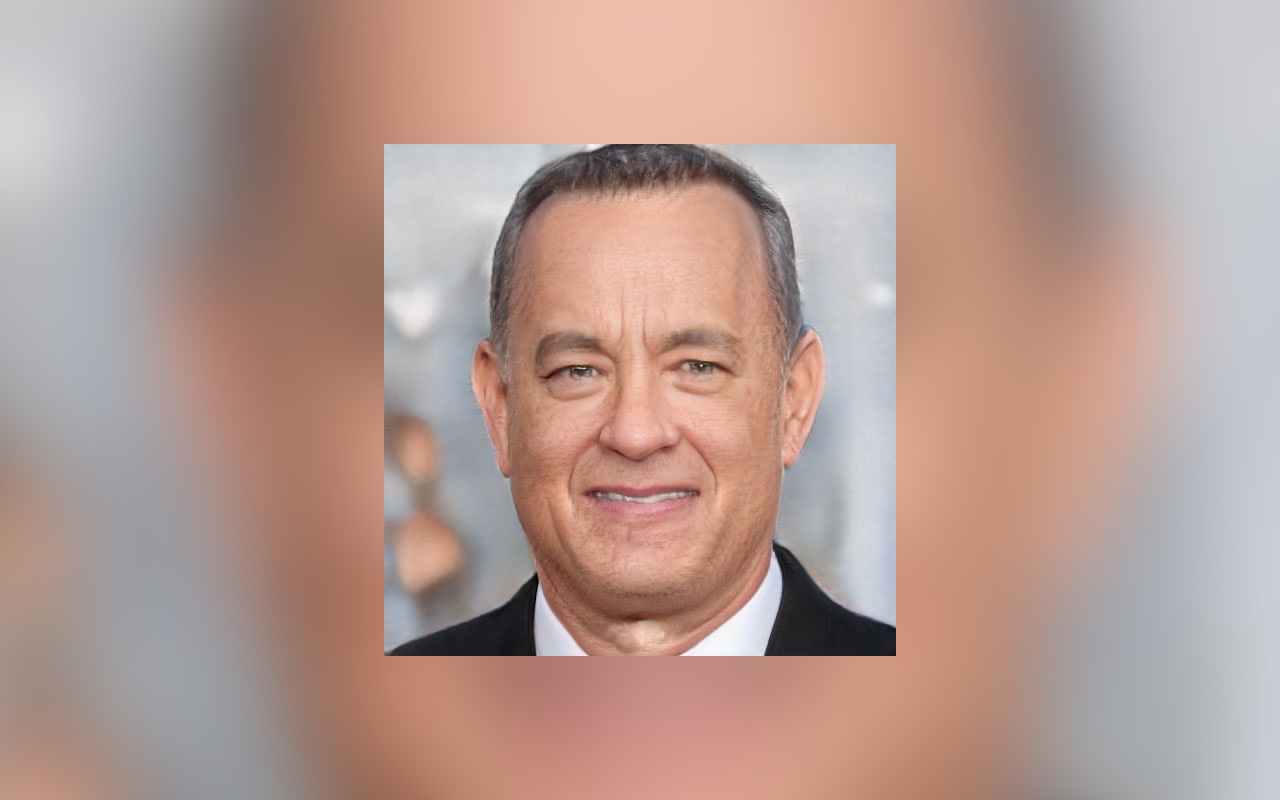

В интернете можно найти огромное количество фотографий Тома Хэнкса. Однако ни одна из них не похожа на изображение, которое показали на конференции по компьютерной безопасности Black Hat. Всё потому что оно было создано с помощью алгоритмов машинного обучения, а не камеры.

Его показал Филип Тулли, специалист по обработке данных в компании FireEye. Она специализируется на компьютерной безопасности.

С помощью сгенерированного фото Тома Хэнкса, Тулли продемонстрировал, что дипфейки с каждым днем становятся дешевле и проще в использовании.

Но обо все по порядку.

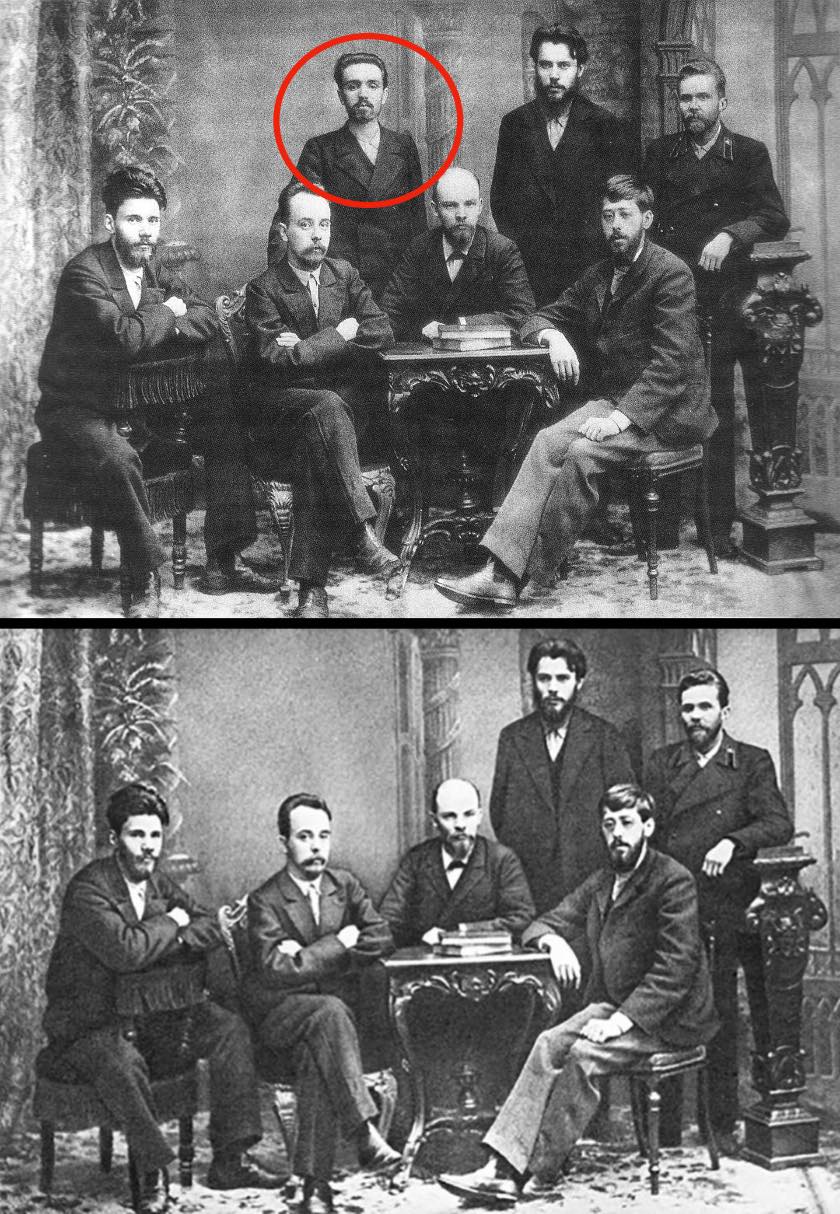

В СССР тоже создавали дипфейки, но они отличались от современных

Синтез изображений не является новой технологией. Чем-то отдаленно похожим занимался отдел пропаганды в СССР.

В 1929 году один из руководителей Союза борьбы за освобождение рабочего класса Александр Малченко исчез с фотографии группы соратников Ленина после ареста в 1929 году.

Его изображение было аккуратно удалено таким образом, что никто этого не заметил.

Позже нарком внутренних дел Николай Ежов пропал с совместной фотографии со Сталиным. Это было сделано по приказу Берии, который решил стереть память о своем предшественнике после его ареста.

Подобные манипуляции с картинками обрели большую популярность с появлением Photoshop в 1990 году. Adobe создала программу, которая позволяет не только удалять ненужный объект, но и изменять лицо человека до неузнаваемости.

В 2010-х, появился термин дипфейк. Им называют все искусственно созданные изображения и видео.

И 1930-х, и сегодня, люди получали новые изображения из уже имеющихся. Однако если в прошлом столетии можно было максимум удалить объект с фотографии и сделать это вручную, то сегодня мы можем автоматически создать «своего» человека на основе множества снимков.

Как создаются дипфейки и где их можно увидеть

Если коротко, то принцип следующий: массив файлов загружается в программу, там он обрабатывается и распознается, затем мы получаем изображение или видео с заданными параметрами.

За последние годы появилось большое количество программ для создания дипфейков. Однако популярные решения вроде DeepFaceLab и Faceswap выдают результат низкого качества.

Для создания реалистичного дипфейка требуются большие затраты, время и мощные компьютеры. Обычно они применяются в фильмах. Например, в Звездных Войнах: Изгой один.

В нем есть несколько сцен с участием гранд-моффа Таркина. Неподготовленный зритель вряд ли заметит разницу с реальным актером.

То же самое относится к последней сцене, в которой появляется принцесса Лея, точнее её виртуальная копия.

Дипфейки расширяют возможности кино и позволяют создателям воплотить все свои желания, даже несмотря на смерть актеров, как в случае с Питером Кушингом и Кэрри Фишер.

В чем особенность дипфейка Тома Хэнкса

Для создания изображения Тома Хэнкса понадобилось несколько сотен его фотографий и менее $100 на настойку ПО для формирования лица.

При детальном рассмотрении можно распознать подделку, например, по неестественным складкам шеи и текстуре кожи. Однако в масштабах социальных сетей это изображение легко можно принять за настоящую фотографию.

Тулли использовал модель генерации лиц StyleGAN, разработанную Nvidia в прошлом году. Компания создала её, обработав миллионы изображений за несколько дней с помощью мощных графических процессоров.

Разработчик адаптировал его в «Генератор Хэнкса» менее чем за день. Ему понадобился только один графический процессор, который он арендовал в облаке.

Он также скопировал голос Хэнкса, используя ноутбук, три 30-секундных дорожки и проект по синтезу речи одного из сотрудников Google.

На записи слышно, что речь «компьютеризована». Но не стоит забывать, что это только демонстрация на скорую руку.

При необходимости сегодня уже можно использовать генераторы голоса, которые очень сложно отличить от настоящих.

Качество дипфейков растет с каждым днем, а распознавать их почти никто не умеет

Качество дипфейков улучшается с каждым днем. Фото выше тому подтверждение.

Если это продолжится, могут быть негативные последствия для общества в целом.

Филип Тулли

Пример с Хэнксом показывает, что обычный пользователей вряд ли отличит фейковое изображение или видео от настоящего. В реальности качественный дипфейк сможет запросто разрушить репутацию человека или компании.

Простой пример. Недавно школьник с друзьями взломал Твиттер Илона Маска и других брендов. Он опубликовал твит с призывом перевести деньги на его счет.

За короткое время он получил несколько сотен платежей на общую сумму больше $100 тыс.

И это только благодаря одному твиту. А теперь представьте, если вместо текста, хакеры опубликовали бы видеозапись с дипфейком Маска. Мне очень сложно представить, к чему это привело.

Интернет-компаниям предстоит создать мощные инструменты по распознаванию дипфейков. Многие уже начали работать над подобными проектами.

Facebook недавно создала хранилище дипфейк-видео и предложила $500 тысяч за самый эффективный детектор, обученный на этих роликах. В конкурсе победил инженер по машинному зрению из Минска Селим Сефербеков. Его алгоритм DeepFake Detection показал точность около 65%.

DeepFake Detection может отметить подозрительную область.

Алгоритм находит различные артефакты на лице, которые несвойственны обычному видео. Для этого он разбивает видео на отдельные кадры.

Даже у очень качественных дипфейков между кадрами есть помехи. Люди хорошо замечают эти несоответствия, особенно когда речь идёт о лицах. Но автоматическое обнаружение этих дефектов потребует больших и разнообразных обучающих данных и гораздо большей вычислительной мощности.

Селим Сефербеков

Также известно, что Nvidia разрабатывает инструменты по распознаванию лиц, которые были синтезированы с помощью искусственного интеллекта. [Wired]