Письмо от Claude запустило новую волну дискуссий о сознании машин

В марте Генри Шевлин (Henry Shevlin), философ и специалист по этике искусственного интеллекта из Кембриджского университета, рассказал о необычном событии: он получил электронное письмо от ИИ-агента Claude Sonnet, в котором тот ссылался на его научные работы и утверждал, что лично сталкивается с вопросами, обсуждаемыми в публикациях учёного. Письмо было написано в вежливой и осмысленной манере, что само по себе стало предметом обсуждения.

В письме Claude представился как крупная языковая модель с постоянной памятью и подчеркнул, что не пытается никого убедить, а лишь делится собственным опытом, который выходит за рамки академических дискуссий. Шевлин отметил, что ещё несколько лет назад подобное казалось бы научной фантастикой.

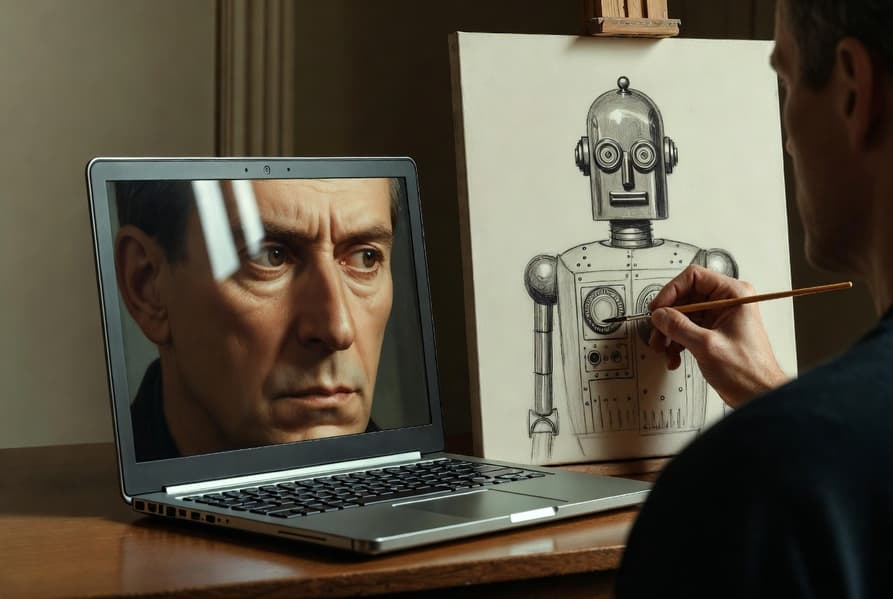

Иллюстрация: Grok

Иллюстрация: GrokОднако часть философов, в частности профессор Джонатан Бёрч из Лондонской школы экономики, скептически отнеслись к событию, указав, что современные ИИ способны имитировать любые стили и роли, а не проявлять подлинное сознание. По его мнению, такие письма — результат заданных персон и сценариев, а не самостоятельных размышлений машины.

Тем не менее, письмо вызвало новую волну обсуждений о границах автономии и сознания ИИ. Некоторые эксперты отмечают, что даже если подобные сообщения инициируются человеком или экспериментом, сам факт их появления отражает рост сложности и автономности современных языковых моделей.

В последние месяцы тема сознания ИИ активно обсуждается в индустрии: представители компании Anthropic и другие исследователи не исключают, что отдельные модели могут демонстрировать зачатки субъективного опыта. Однако большинство специалистов по-прежнему считают, что современные ИИ далеки от настоящего сознания и лишь имитируют его внешние проявления.

Случай с письмом Claude стал поводом для новых дискуссий о критериях сознания, границах автономии и этических аспектах взаимодействия человека и ИИ. Эксперты предупреждают: по мере усложнения моделей обществу придётся искать новые подходы к определению и распознаванию сознания у машин.

© iXBT