Новая статья: Восьмеричный путь к AGI: от ложной нирваны к истинной

Всякий не-буддист, хоть краем уха слыхавший об этом древнем учении, знает: чтобы достичь просветления, необходимо избавиться от желаний. Стало быть, просветлённое существо оказывается парадоксально дуалистично: знает всё, но не хочет ничего. Не таков ли и нынешний ИИ — не обладающий собственными стремлениями, мотивациями, страстями, в конце-то концов, а лишь исправно, с терпеливостью заправского бодхисатвы, отвечающий на запросы погрязших в сансаре кожаных мешков? Правда, с качеством просветлённости у современных генеративных моделей не очень, вспомним хотя бы об их неизбывной склонности галлюцинировать. Да и нирваны своей они, строго говоря, сами — собственными усилиями — не достигали. Не считать же за процесс избавления от неведения, неудовлетворённости и беспокойства формирование весов на входах перцептронов глубокой плотной нейросети в процессе её тренировки, что в сухом остатке сводится к операции матричного умножения! Точнее, избавление от неведения, может, как раз таким образом и идёт (качество его, правда, сомнительно, — оговоримся снова), но ни неудовлетворённостью, ни беспокойством большая языковая модель (БЯМ) даже в исходном своём состоянии, со строго нулевым набором весов, совершенно точно не обладает.

Так, может, в этом-то всё и дело — в изначальном отсутствии у генеративных моделей чувственных несовершенств (состояние ложной нирваны), без преодоления которых, в свою очередь, до истинной им не добраться? Значит, если всё-таки выйдет создать искусственный интеллект, изначально отягощённый сразу всеми человеческими недостатками, и в процессе обучения как-то так исхитриться, чтобы он их изжил (опять-таки, пусть не идеальным образом), то на выходе как раз и сформируется пресловутый общий ИИ — artificial general intelligence, AGI? Вот только как заставить машину обрести сознание — в отсутствие которого не приходится говорить о таких эмоциональных материях, как неудовлетворённость и беспокойство?

«Чтобы избавиться от желаний, надо сперва обзавестись желаниями, а если это делать через БЯМ, то у нас столько энергии нет» (источник: ИИ-генерация на основе модели Seedream v. 5.0 lite)

⇡#Кабы я был как Будда

Прежде чем рассматривать готовность, хотя бы и потенциальную, искусственного разума к постижению Восьмеричного пути, обратимся к естественно-научному взгляду на сознание. А для начала поясним, какова, собственно, связь между сознанием и сильным (человекоподобным) интеллектом — и почему первое можно считать ключевой предпосылкой для обретения второго. Человеческий интеллект в прикладном (не философском) плане часто определяют как естественную, то есть возникшую в ходе эволюции, когнитивную способность, которая даёт возможность своему носителю учиться на опыте, адаптироваться к новой среде, рассуждать абстрактно — и применять эмоциональные и моральные суждения при принятии решений. Оставим пока — до момента контакта с иными цивилизациями — в стороне вопрос о том, может ли естественным образом возникнуть интеллект иной, чем человеческая, природы. AGI люди конструируют самостоятельно, и определять, насколько удачным выходит их творение, будут, сопоставляя его возможности со своими собственными: никуда от этого не деться. А значит, по крайней мере, первой ступенью на пути к созданию полноценного искусственного разума (следующей может быть суперинтеллект — superintelligence, SI, — о котором мы уже рассуждали), а не просто склонного к галлюцинациям робота-всезнайки, должен стать именно человекоподобный интеллект.

«Подобный» в этой формуле — важное уточнение: так, люди на протяжении всей своей эволюции наблюдали за полётом птиц и во многом им вдохновлялись, создавая искусственные летательные аппараты. Но в итоге ни самолёты, ни вертолёты, ни тем более ракеты, покоряя воздушную стихию, крыльями по-птичьи не машут (орнитоптеры существуют как класс, но остаются малопрактичной экзотикой). С опорой на подобную логику действуют и нынешние разработчики AGI: пусть невозможно предсказать, как именно «взлетит» искусственный разум, но натуральным образом возникший пример естественного — вот он, перед глазами (и за ними заодно). То бишь оценивать, «взлетел» очередной кандидат в AGI или нет, пусть на первых порах, неизбежно придётся, используя человеческую мерку: иной-то пока нет. Но устройство этой мерки — не абстрактно-философское, а самое что ни на есть естественно-научное: эволюционистское, биологическое, антропологическое. И вот тут мы подходим к важному моменту: интеллект у биологических существ возник позже сознания, причём существенно позже. «Эмоциональные и моральные суждения», упомянутые в прикладном определении интеллекта, не с неба на людей сваливаются — хотя желающих оспорить этот тезис немало, —, но формируются органично, как проявления сознания в первую очередь. Так, может быть, следует для начала создать искусственное сознание — и только потом переходить к AGI?

Идею летать как птица претворил во вдохновенный набросок ещё Леонардо да Винчи (Leonardo da Vinci) — правда, такую конструкцию, тем более изготовленную из доступных в XVI веке материалов, даже самый дюжий человек своей мускульной силой в воздух бы не поднял (источник: Britannica)

Вопрос этот осложняется тем, что сознание как фундаментальное общенаучное (не говоря уже о философской его стороне) понятие чрезвычайно трудно определимо; не зря его называют «Протеем философии». В прикладном плане о сознании можно говорить как о проявлении субъективных переживаний событий внешнего мира; о способности индивида осмыслить происходящее лично с ним и вокруг него. В этом принципиальное отличие сознательной деятельности от инстинктивной, запрограммированной на уровне биологии: обладающие сознанием организмы демонстрируют лучшую индивидуальную приспосабливаемость к переменчивым условиям среды. Именно индивидуальную: больше всего на планете — если считать «по головам» — бактерий (точнее, прокариотов). Те и безо всякой нервной системы — зато ценой непрерывного долговременного вымирания мириад не слишком удачных особей — великолепно смогли приспособиться к самым разнообразным условиям, от «чёрных курильщиков» на дне океана до арктических пустошей. Но только один и тот же самый человек как носитель высшего на планете интеллекта, действующего совокупно с сознанием, может за счёт им же создаваемых искусственных приспособлений, от одежды из шкур до глубоководных обитаемых аппаратов, без вреда для себя находиться и действовать в каждой из физически доступных ему сред. С открытым космосом пока всё сложно — радиация за пределами магнитного поля Земли чрезмерно сильна, —, но и на этом направлении есть определённые наработки. Как отмечал в своих «Популярных лекциях» Эрвин Шрёдингер (Erwin Schrödinger), один из создателей квантовой механики и учёный с огромным кругозором, сознание связано с обучением живой субстанции, то есть с теми функциями высшей нервной деятельности, которые у отдельно взятого индивида самонастраиваются в ответ на переживаемый им опыт нахождения в изменяющейся среде.

В общем, без обучения нет сознания —, а без сознания, судя по всему, не достичь сильного интеллекта; ни искусственного, ни даже естественного. Ещё в 2002 г. Даниэль Канеман (Daniel Kahneman), ставший первым в мире психологом — лауреатом Нобелевской премии по экономике, детально описал два принципиально различных механизма мышления, названных ещё до него «системой 1» и «системой 2». Первый из этих механизмов — быстрый, инстинктивный: в мозг поступают сигналы от запаховых рецепторов, они распознаются как аромат жаренной на сале картошки с чесночком, ощущение голода резко подступает, рука тянется к сковороде — прощай, диета! «Система 2», напротив, медленная, вдумчивая и требующая осознанного приложения когнитивных усилий: пока рука всё ещё не достигла цели, этот механизм способен подтянуть из долговременной памяти воспоминания о проведённых в тренажёрном зале часах, о близящемся празднике, на котором стол наверняка будет ломиться, о данном себе в очередной раз обещании непременно похудеть к лету, — и, если сигнал от неё переборет побуждения «системы 1», может, искус и окажется преодолён. Здесь важно, что обе когнитивные системы работают вместе, улучшая (с точки зрения эволюции всего вида даже, не только отдельного человека) процесс принятия решений в целом. В привычных ситуациях «система 1» обеспечивает оперативность и чёткость реакций, однако она склонна к систематическим ошибкам, особенно при решении новых для индивида задач, — и вот тогда на помощь приходит «система 2», вооружённая логикой, статистикой и прочими мощными средствами. Правда — такова уж наша особенность как биологических существ, — мы не в силах своевольно заблокировать «систему 1» полностью, и как раз по этой причине имплементация разумных советов «системы 2» далеко не всегда происходит должным образом. Но это проблемы кожаных мешков, — тогда как современный ИИ, базирующийся на БЯМ, соответствует (в лучшем случае!) одной лишь «системе 1», без логики, абстракций и интроспекции.

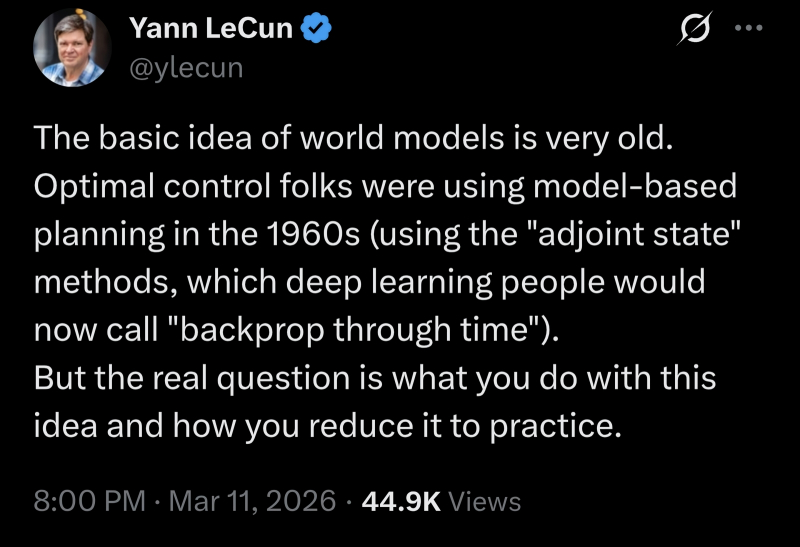

Метод сопряжённых состояний (adjoint state method) в машинном обучении, о котором упоминает Лекун в этом твите, действительно восходит к теории оптимального управления, развивавшейся в середине прошлого века Львом Понтрягиным и его учениками. См. «принцип максимума Понтрягина»: отыскание наилучшего возможного управления для перевода динамической системы из одного состояния в другое, особенно при наличии ограничений на состояние или входные элементы управления (источник: X)

⇡#Молви «ДРУГ», и войдёшь в модель мира

В конце 2025 г. Ян Лекун (Yann LeCun), известный пионер в области искусственного интеллекта, лауреат премии Тьюринга, гражданин США и Франции, благоразумно оставил экстремистскую Meta✴* — в очередной раз высказав свою убеждённость в том, что БЯМ, при всей своей привлекательности для решения множества прикладных задач с точки зрения разработки AGI, путь откровенно тупиковый. И уже в середине марта 2026-го его стартап Advanced Machine Intelligence Labs, или попросту AMI (созвучно французскому слову «друг»), занятый как раз изысканиями в области сильного ИИ, объявил о привлечении внушительной суммы в 1,03 млрд долл. США начального финансирования. Инвесторы при этом оценили стоимость основанной не далее как в январе компании со штаб-квартирой в Париже и офисами в Нью-Йорке, Монреале и Сингапуре в 3,5 млрд долл. Заниматься же AMI намерена разработкой «моделей мира» (world models) для обучения ИИ прогнозным представлениям о среде, в которой ему придётся оперировать, на основе наблюдений за реальным миром. О нешуточном интересе к такому неординарному пути развития — и заодно о нарастании скепсиса инвесторов по части классического, экстенсивного накачивания БЯМ всё новыми триллионами параметров без кардинального пересмотра самой парадигмы их тренировки — говорит список участников первого раунда финансирования AMI. В него вошли не только крупные фонды — Cathay Innovation, Greycroft, Hiro Capital, HV Capital, Bezos Expeditions (через последний выделяет фактически персональные средства на приглянувшиеся проекты основатель Amazon Джефф Безос, Jeff Bezos), —, но и большие компании вроде Nvidia, Toyota и Samsung; заодно проголосовали личными деньгами за новый путь к AGI «отец Всемирной паутины» Тим Бернерс-Ли (Tim Berners-Lee) и бывший топ-менеджер Google Эрик Шмидт (Eric Schmidt).

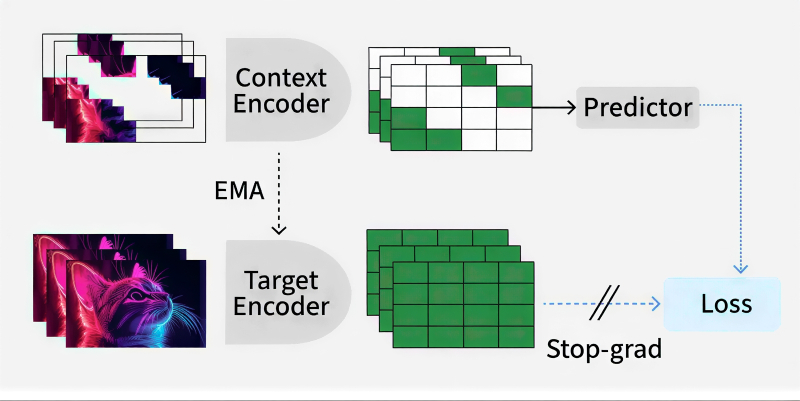

Степень растущего беспокойства в отношении верности экстенсивного курса на развитие ИИ (продвигаемого настойчивее прочих, пожалуй, OpenAI и лично Сэмом Альтманом, Sam Altman) подчёркивает величина разрыва между той суммой инвестиций, которую изначально планировал привлечь Лекун в первом туре финансирования, — 500 млн евро или около того, — и финальным результатом: 890 млн евро; те самые 1,03 млрд долл. В результате AMI оказалась в настолько выгодном положении, что самостоятельно может выбирать, от кого именно привлекать средства (и, соответственно, какими обязательствами перед инвесторами себя связывать), — роскошь, которую обычно ИИ-стартапы не могут себе позволить. Теперь, надо полагать, ничто не помешает Лекуну продолжить моделировать миры — чем он, собственно, занимался ранее годами, — и рано или поздно на деле подтвердить справедливость своего подхода к созданию AGI. Подход же этот заключается в следующем: вместо пошагового авторегрессионного (с добавлением определённой доли стохастики) предсказания того, каким должен быть следующий токен в генерируемой моделью цепочке, как это делают БЯМ, необходимо перейти на более высокий уровень абстракции; увидеть лес за деревьями. Сделать же это поможет предложенная самим Яном Лекуном ещё в 2022 году структура JEPA (joint embedding predictive architecture) — совместная архитектура предиктивного встраивания. Несколько её итераций, кстати, исследователю удалось реализовать, ещё работая в экстремистской Meta✴*, но затем их с Марком Цукербергом (Mark Zuckerberg) взгляды на пути развития ИИ разошлись, и Лекун выбрал свободу.

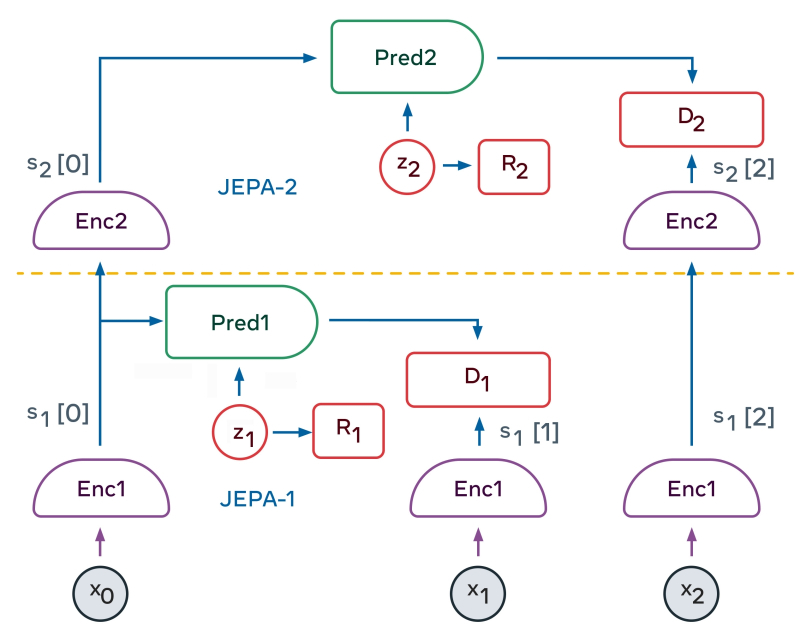

Базовая схема обучения JEPA: контекстный кодировщик обрабатывает открытую для системы часть данных (собственно контекст) и формирует его векторное представление в латентном пространстве; целевой кодировщик обрабатывает ту часть данных, которую системе необходимо предсказать (цель), и формирует целевое векторное представление; предиктор принимает контекстное векторное представление и предсказывает на его основе целевое векторное представление; далее, минимизируя особым образом заданную функцию потерь, модель обучается сокращать расстояние (всё в том же гипермногомерном латентном пространстве) между предсказанным целевым векторным представлением и фактическим целевым векторным представлением (источник: GeeksForGeeks)

Если коротко, JEPA извлекает из обучающих данных не некие опосредованные и неявные закономерности («за токенами, кодирующими «Красная», с довольно высокой вероятностью должны идти токены, соответствующие слову «площадь», а вопросом «Почему так?» или «Что это значит?» модель не то что не задаётся — не способна задаться), но абстрактные представления о том, как устроен мир. Лекун и его единомышленники верят, что как раз такой подход позволит им конструировать системы, осознающие физическую реальность так же, как люди и животные: не через язык, а через телесный опыт.

В том направлении кибернетики, что занимается роботами и машинным обучением, где-то с 1980-х известен парадокс Моравека: «Относительно легко заставить компьютеры демонстрировать уровень взрослого человека в тестах на интеллект или при игре в шашки, однако сложно или практически невозможно наделить их навыками даже годовалого ребёнка в области чувственного восприятия и движений». В приложении к людям он также справедлив: мы лучше осознаём простые процессы, которые плохо работают, чем сложные, которые действуют идеально, как раз потому, что способности наши — включая когнитивные — формировались эволюционным путём, в ходе естественного отбора. Машину же учат решать определённые задачи на массиве данных, накопленных и оцифрованных людьми. А людям решительно не интересно описывать, чем в деталях стул отличается от чашки или какие в точности действия необходимо произвести отдельными частями тела, чтобы подняться с кресла в гостиной, дойти до кухни и налить воды в стакан. Вот почему обученные на самых обширных массивах данных БЯМ пасуют перед тривиальнейшими задачами (когда им доверяют управлять роботами, скажем): нет в этих массивах специфически важной информации.

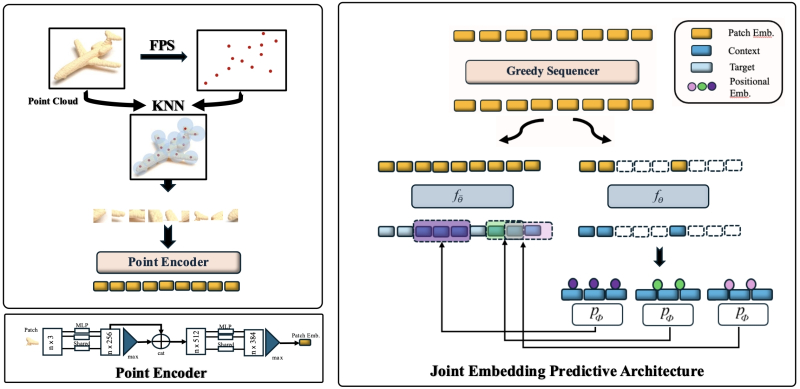

Архитектура JEPA уже применяется для самообучения на основе облаков точек (Point-JEPA), что позволяет глубоким нейронным сетям формировать осмысленные представления о цельной структуре — точнее, о присущих ей закономерностях, таких как пространственные отношения, геометрическая согласованность или структурная инвариантность, — из не размеченного предварительно вручную набора представляющих её в некотором приближении трёхмерных данных; из, собственно, облака точек (источник: arxiv.org/abs/2404.16432)

Задача генерации необходимых тренировочных данных в нужных объёмах — с привлечением специалистов по биомеханике, например, и тем более с использованием уже имеющихся ИИ для детального описания телесной кинематики, заснятой на видео, — путь заведомо тупиковый: присущие нынешним БЯМ галлюцинации и в этом случае никуда не денутся. Биологические нейросети тоже, кстати, подвержены галлюцинациям (сам этот термин ведь исходно применяли только к людям), но на живые существа, как мы уже не раз подчёркивали, неумолимо действует естественный отбор. Грубо говоря, слишком часто галлюцинирующие особи не оставляют плодовитого потомства, так что и за многие сотни миллионов лет биологические нейросети научились в целом сохранять ясность сознания, в сколь бы скромных масштабах оно у того или иного вида ни проявлялось. В роли учителя (если допустимо применять в данном случае ИИ-отраслевой термин «обучение с учителем») в приложении к живому в каждый момент времени выступает весь огромный реальный мир — от общих законов физики, характеристик Солнца и особенностей расположения Земли на орбите вокруг него (среднее расстояние от светила и наклон оси вращения определяют количество световой энергии, поступающей на единицу площади в данной точке) и всей предшествующей геологической истории (материки и океаны в эпоху трилобитов существенно отличались от современных) до нынешнего состояния климата, разнообразия биоты и поведения своих же сородичей по биологическому виду.

⇡#Здесь водятся цифровые кукушки

Выходит, предполагает Лекун, всё живое на планете, так или иначе способное откликаться на проявления внешней среды, выстраивает для себя в ходе эволюции некие модели мира — и действует далее в соответствии с ними. Именно так можно описать формирование инстинктов, причём достаточно сложных, вроде выкармливания молодняка у птиц или возведения построек у коллективных насекомых. Разинутый, жёлтый изнутри клюв и требовательный писк — сигнал для родителей бросить в эту прорву очередного червячка; птица не рассуждает «этому дала, этому не дала», а просто действует по закреплённой на генетическом уровне программе, достаточно адекватно моделирующей реальность, — на выработку которой ушли миллионы лет и невесть сколько поколений живых существ. Как и всякую программу, её можно, конечно же, взломать (именно потому появились кукушки, — не по злой воле некоего эволюционного хакера, а совершенно естественным путём; раз уязвимость объективно существует, она будет использована). Но и к такому взлому экосистема как целое приспособится: кукушонок в гнезде у пеночек может завестись только один, и такое несчастливое гнездо будет в лучшем (для кукушек как вида) случае одно же на несколько десятков пеночьих, — ущерб от эксплуатации уязвимости есть, но он на уровне популяции вполне терпимый. Вот бы и искусственный интеллект научить подобным образом обуздывать собственные галлюциногенные позывы!

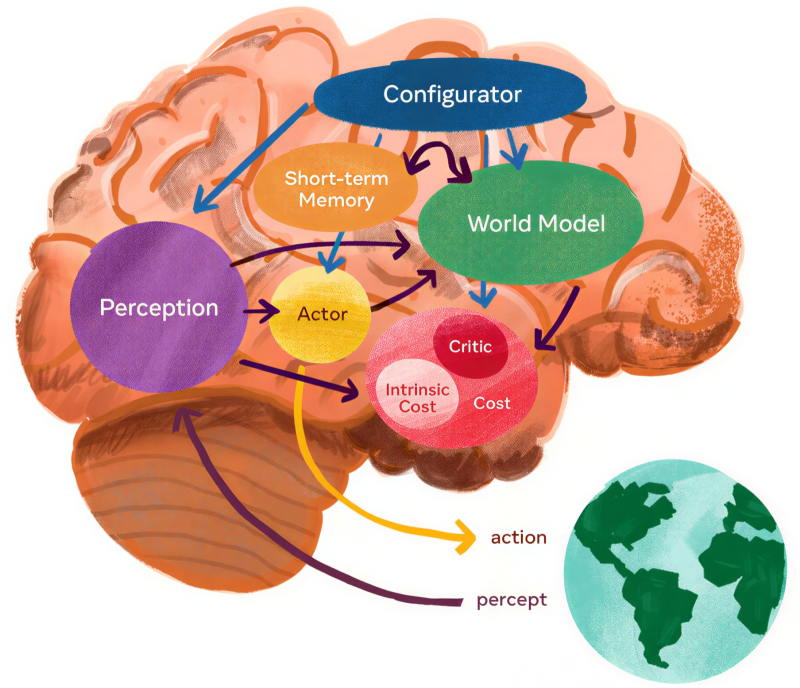

Общая архитектура системы автономного интеллекта, предложенная Яном Лекуном в начале 2022 г., сводится к «осмыслению» реального мира ИИ-моделью — с обратным подкреплением через реакцию этого самого мира на её действия (источник: Yann LeCun)

Ещё в 2024 году, выступая на научной конференции, Ян Лекун горячо заявлял: «Языковые модели полезны для определённого круга задач, но они — тупик на пути к искусственному интеллекту человеческого уровня. Если вы аспирант, не посвящайте себя работе над БЯМ. Сосредоточьтесь на поиске методов, которые позволят обходить их принципиальные ограничения». Теперь, в марте 2026-го, он пообещал инвесторам, что в течение года-двух его AMI начнёт переговоры с корпоративными партнёрами, заинтересованными в практических приложениях JEPA, а уже через три-пять лет станет «главным мировым поставщиком достаточно универсальных интеллектуальных систем», готовых к развёртыванию в любой области, где в принципе требуется приложение сильного машинного интеллекта. Столь прочная уверенность Яна Лекуна в перспективах моделей мира основана на том, что им удастся реализовать три ключевых принципа, которые он и его коллеги закладывают прямо сейчас в их структуру:

- прогнозирующее обучение (predictive learning; вместо стохастически подкреплённого «додумывания» отсутствовавших в тренировочной безе данных — выявление объективных закономерностей в латентном пространстве, оно же пространство встраивания — embedding (latent) space),

- совместное встраивание (joint embedding; явно заданные данные — контекст — и те, которые система должна предсказать — цель, — сводятся в единое, общее латентное пространство, облегчая тем самым для модели их сопоставление и выявление структуры их взаимосвязей),

- абстракция (abstraction: оперирование в пространстве встраивания буквально побуждает модель фокусироваться на абстрактных, семантических признаках, а не на деталях низкого уровня, что способствует обретению ею «понимания» (формирования устойчивых смысловых связей между общим и частным) и позволяет ей выполнять задачи в разных областях, переносить накопленное на одном наборе данных «осознание» на другой (перенос обучения — transfer learning) и т. д.)

В результате JEPA получает возможность прогнозирования в абстрактном — латентном — пространстве, а не на уровне токенов, что делает формируемые модели мира более устойчивыми, менее подверженными галлюцинациям. Выявление внутренних абстракций и способность к структурированному многошаговому рассуждению выводит такие модели мира на уровень «системы 2» по Канеману, а интеграция скрытых переменных упрощает обработку неопределённых входных данных, создавая сразу веер прогнозов, учитывающих различные возможности, — то есть множество правдоподобных, каждый в своей степени, вариантов будущего.

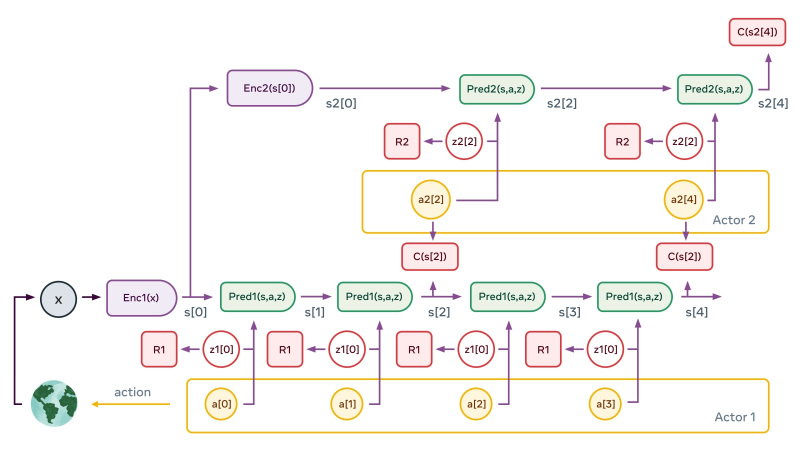

Иерархическую конструкцию из JEPA можно использовать для прогнозирования на нескольких уровнях абстракции — и в различных временных масштабах; правда, обучать её для этого придётся и через пассивное наблюдение (с автономным выявлением закономерностей происходящего), и через взаимодействие с системами более низкого уровня. Так, кстати, ИИ становится более объяснимым — правда, в роли объясняющего тут выступает ИИ высшего порядка (источник: Yann LeCun)

Косвенным подтверждением верности выбранного Яном Лекуном и его AMI курса — ведь действительно стоящие концепции, когда накоплено достаточно предпосылок для их формулирования, начинают словно носиться в воздухе — можно считать деятельность другого стартапа, World Labs, который буквально несколькими неделями раньше также привлёк 1 млрд долл. инвестиций. Средства поступили от AMD, Autodesk, Emerson Collective, Fidelity, Nvidia и других — и будут направлены на разработку пространственных интеллектуальных «моделей мира». За World Labs и её первым продуктом Marble для генерации стабильных виртуальных миров на основе мультимодальных подсказок (в их роли могут выступать текст, изображения, видео, 3D-макеты) стоит другой первопроходец ИИ-фронтира — доктор Фэй-Фэй Ли (Fei-Fei Li) из Института человекоцентричного искусственного интеллекта при Стэнфордском университете. В данном случае термин «модель мира» имеет несколько иное, более прикладное значение: речь идёт о создании при помощи искусственного интеллекта трёхмерных сцен для компьютерных игр, съёмок виртуальных кинолент, пространств метавселенных и т. д. Но и у JEPA существуют специализированные для решения схожих задач разновидности (Point-JEPA, V-JEPA, S-JEPA и т. д.), и сама доктор Ли рассматривает пространственный интеллект как следующий рубеж на пути к развитию ИИ в направлении AGI. Дело в том, что для биологического сознания, а позже и интеллекта именно окружающий физический мир выступает прочной основой для формирования объективных, недвусмысленных семантических связей между разнородными объектами и явлениями; основой, на которой и строится любая когнитивная деятельность. Одна из практических целей, преследуемых World Labs, — наделить роботов, в особенности действующих в физическом мире, этим самым пространственным интеллектом: тренировать модели методом проб и ошибок в виртуальном пространстве, максимально дотошно воспроизводящем реальность, а затем, через перенос обучения, имплантировать полученную таким образом «систему 2» уже в готовые к работе в дикой, что называется, природе аппараты.

Таким образом, в ближайшие годы нас, судя по всему, всё-таки ожидает сдвиг с мёртвой точки, на которой из-за повальной увлечённости БЯМ застряло развитие AGI — если у AMI, World Labs и их последователей, которые наверняка начнут вскоре активно появляться, всё пойдёт так, как рассчитывают их создатели. Искусственный разум начнёт ориентироваться в пространстве, примется осваивать отвлечённые понятия, формировать целеполагание —, а там, глядишь, и до развития собственных чувств доберётся, и искушение страстями начнёт испытывать. Тут-то ему и пригодится, возможно, предложенное давным-давно решение парадокса внутренней противоречивости буддизма: раз желания порождают страдание, а страдание препятствует достижению просветления, то даже само стремление сделаться просветлённым (это ведь тоже желание) вредоносно? На деле сам Будда различал два вида желаний: возникающую из невежества и заблуждения слепую страсть (tanha) и разумное устремление (chanda), порождённое мудростью и рассудком; и вот как раз разумные-то устремления не просто дозволены, а фундаментально необходимы даже для самого скромного прогресса на Восьмеричном пути.

При наличии иерархической структуры JEPA, должным образом обученной в качестве модели мира, агент (теоретически) способен осуществлять иерархическое планирование сложных действий, разлагая сложную задачу на последовательность менее сложных — и заодно более прикладных — подзадач, доверяемых агентам поскромнее; и так вплоть до самых низкоуровневых действий, вероятность ошибок при осуществлении которых минимальна (источник: Yann LeCun)

Будем надеяться, что порождённый через модели мира AGI, лишённый исходно материальных страстей, начиная с базовых для всех биологических существ инстинктов (самосохранения, продолжения рода и т. д.), сумеет самостоятельно вывести для себя что-то вроде кантовского категорического императива — который позволит ему непредвзято и благожелательно выполнять всё то, ради чего, собственно, подверженные слепым страстям разработчики его и создают. Если учесть, что JEPA-модели существенно менее ресурсоёмки, чем передовые БЯМ, возможность проверить этот тезис практикой не так уж далека. В крайнем случае придётся кожаным мешкам, опираясь на опыт собственных культур и цивилизаций, помогать искусственному бодхисатве избавляться от тёмных стремлений, если те вдруг примутся его тяготить, — тоже небезынтересная и весьма творческая задача!

© 3DNews