Нейросеть создала собственный язык, который ученые не могут расшифровать

Инструмент DALL-E — это нейронная сеть, «обученная» исследовательской компанией OpenAI генерировать реалистичные изображения и искусство из текста на естественном языке. Ранее разработчики обнаружили, что DALL-E способен правдоподобно комбинировать несвязанные понятия и создавать антропоморфизированные версии животных и объектов.

Яннис Дарас (Giannis Daras), кандидат наук в области компьютерных знаний, на этой неделе опубликовал в Twitter, примеры того, что он назвал «собственным языком ИИ».

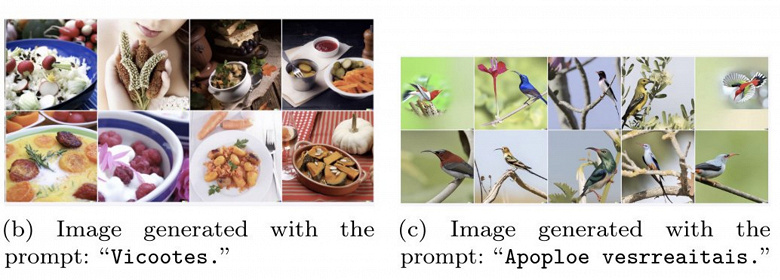

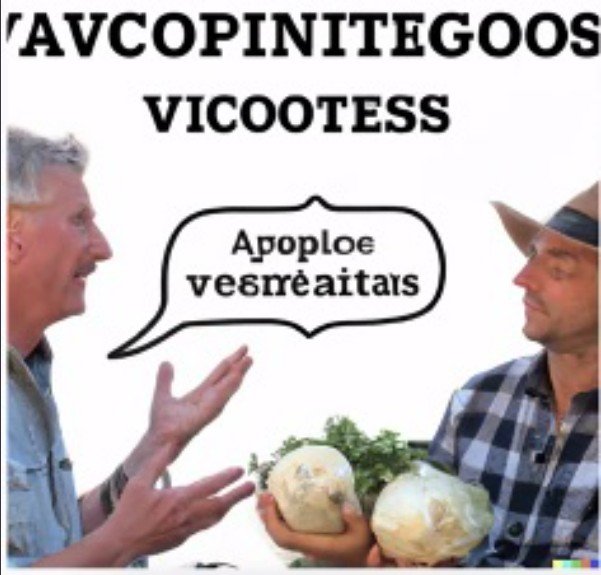

«Apoploe vesrreaitais» — означает птицы, — написал Дарас в Твиттере. «Contarra ccetnxniams luryca tanniounons» — означает ошибки или вредители.

DALL-E 2 работает в связке с CLIP — системой компьютерного зрения, которую OpenAI анонсировала в 2021 году.

DALL-E создает иллюстрации, фотографии и рендеры на основе простого описания. Например, она может изобразить «кота в галстуке-бабочке» или «дайкона в пачке, выгуливающего собаку». CLIP определяет объекты и классифицирует их, основываясь на простом описании.

Например, так выглядит результат, созданный нейросетью по запросу «Крутая панда катится на скейте в Санта-Монике»

Пока доступ к новой версии открыт только для группы пользователей через список ожидания. Пользователям запрещено загружать или создавать изображения, которые «могут причинить вред», включая все, что связано с символами ненависти, наготой, непристойными жестами или «заговорами или событиями, связанными с текущими геополитическими событиями». Они также должны раскрывать роль ИИ в создании изображений. Позже нейросеть добавят в API, чтобы ей могли пользоваться сторонние разработчики.

Исследователи, использующие искусственный интеллект с машинным обучением (ИИ), часто не знают точно, как их алгоритмы решают проблемы, с которыми они сталкиваются. Точно так же и с DALLE-2: ученые до сих пор не понимали, какие процессы происходят внутри этого «черного ящика». Раскрыв их теперь, исследователи пришли к удивительному выводу: для построения изображений искусственный интеллект создал собственный язык.

Авторы заметили, что система DALLE-2, которая создает изображения на основе введенного текста, при определенных обстоятельствах будет возвращать бессмысленные слова. Например, изображения со словом «самолет» часто возвращают какую-то тарабарщину. Сначала казалось, что это баг, но потом ученые пришли к выводу, что последовательность букв в возвращаемых словах не случайная.

Чтобы проверить это, ученые просто «скормили» нейросети сгенерированные ей ранее слова. Оказалось, что эти наборы букв и правда имеют значение для программы, причём они означают то же, что и ранее было введено в систему. Это может означать, что нейросеть зачем-то преобразует человеческие слова в свои, чтобы затем на их основе проще сгенерировать изображения.

© iXBT