ИИ-изображения угрожают науке: как ученые будут выявлять их

Проблема мошенничества в научной литературе с каждым годом становится острее. Подделки, созданные с использованием генеративного искусственного интеллекта, все труднее выявить, а это ставит под угрозу достоверность исследований. Современные технологии позволяют мошенникам быстро генерировать тексты, изображения и даже данные, которые с трудом отличимы от настоящих. О сложившейся ситуации пишет в своем новом материале журнал Nature.

«Генеративный ИИ развивается очень быстро, и это вызывает серьезные опасения», — отмечает эксперт по проверке изображений Яна Кристофер из FEBS Press в Германии. Ученые, работающие в области этики публикаций и проверки достоверности данных, сталкиваются с новыми вызовами: подделки становятся все более убедительными, а риск распространения ложной информации в научной среде растет.

Мошенники давно пользуются услугами так называемых «фабрик статей» — компаний, которые массово создают псевдонаучные публикации. С внедрением генеративного ИИ «фабрики» получили еще один мощный инструмент: теперь они могут генерировать целые статьи, включая реалистичные изображения и данные, почти мгновенно.

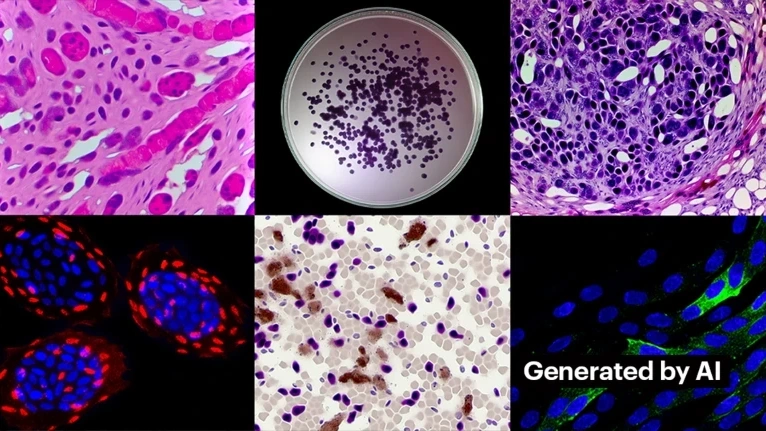

Особенно сложной задачей остается выявление поддельных изображений. В отличие от традиционных инструментов редактирования, например, Adobe Photoshop, ИИ может создавать изображения, в которых практически нет видимых признаков подделки. Например, недавно в одной из научных публикаций появился сомнительный рисунок крысы с неестественными пропорциями, созданный с помощью Midjourney. Этот случай привлек внимание общественности и стал примером того, насколько правдоподобными могут быть ИИ-подделки.

В ответ на вызовы, связанные с генеративным ИИ, специалисты по проверке данных и разработчики программного обеспечения спешат создать инструменты для обнаружения подделок. Компании активно работают над алгоритмами, способными различать настоящие и сгенерированные изображения. Например, Proofig разработала функцию, которая способна распознавать фальшивые микроскопические изображения с точностью 98%.

Однако даже столь мощные алгоритмы не являются универсальным решением. ИИ, выявляющий подделки, нуждается в постоянном обновлении и пополнении базы данных. Более того, полученные результаты все равно должны проверяться специалистами. «Эти инструменты ограничены, но они полезны, поскольку помогают автоматизировать процесс проверки публикаций», — считает Кристофер.

Крупные научные издательства, включая PLoS и Springer Nature, также озабочены ростом числа поддельных статей и разрабатывают собственные инструменты для выявления аномалий. Международная ассоциация научных, технических и медицинских издателей (STM) разрабатывает глобальные стандарты и сотрудничает с технологическими компаниями для решения проблемы. Одно из предложений — метки, невидимые водяные знаки, которые могли бы проставляться на снимки, полученные в лабораторных условиях. Однако для этого нужны новые технологии и стандарты, которые должны поддерживаться производителями оборудования.

Нарастающая угроза требует от научного сообщества активных мер по защите от подделок, чтобы сохранить доверие к исследованиям и поддерживать высокие стандарты научной честности.

Ранее мы сообщали, что появился новый сервис, который создает рекордно качественные изображения.