Google DeepMind переосмыслил указатель мыши: Gemini научили понимать, на что именно указывает пользователь

Исследователи из подразделения Google DeepMind представили концепцию AI-enabled pointer — нового типа курсора, который превращает обычное наведение мыши в полноценное взаимодействие с искусственным интеллектом. Вместо длинных текстовых промптов пользователь сможет просто указать на нужный объект и дать короткую команду вроде «сравни это», «объясни» или «перемести сюда».

В компании считают, что сам принцип взаимодействия с компьютером практически не менялся последние полвека: курсор по-прежнему обозначает лишь координаты на экране. DeepMind предлагает сделать следующий шаг — научить систему понимать не только положение указателя, но и смысл того, на что смотрит пользователь.

Новая концепция строится вокруг идеи контекстного ИИ. Сегодня большинство ИИ-инструментов работают в отдельных окнах: пользователь должен копировать текст, загружать изображения или самостоятельно описывать проблему. В Google хотят убрать этот барьер и встроить ИИ прямо в повседневную работу с интерфейсом.

Источник: Google DeepMind

Источник: Google DeepMindНапример, пользователь сможет навести курсор на таблицу в PDF-файле и попросить «сделать график», выделить рецепт и сказать «увеличь ингредиенты вдвое», или указать на фотографию здания и запросить «проложи маршрут». Система будет автоматически понимать контекст — где находится объект, что именно выбрано и какое действие логично выполнить.

В основе концепции лежат четыре принципа, которые Google считает ключевыми для будущих интерфейсов с ИИ. Первый — отказ от «ИИ-детуров», когда человеку приходится переключаться между приложением и отдельным чат-ботом. Второй — автоматическое понимание визуального контекста вокруг курсора. Третий — использование естественного человеческого языка вместо промптов. И четвёртый — превращение элементов интерфейса из набора пикселей в «осмысленные сущности»: адреса, даты, объекты, рестораны, документы и другие элементы, с которыми ИИ может работать напрямую.

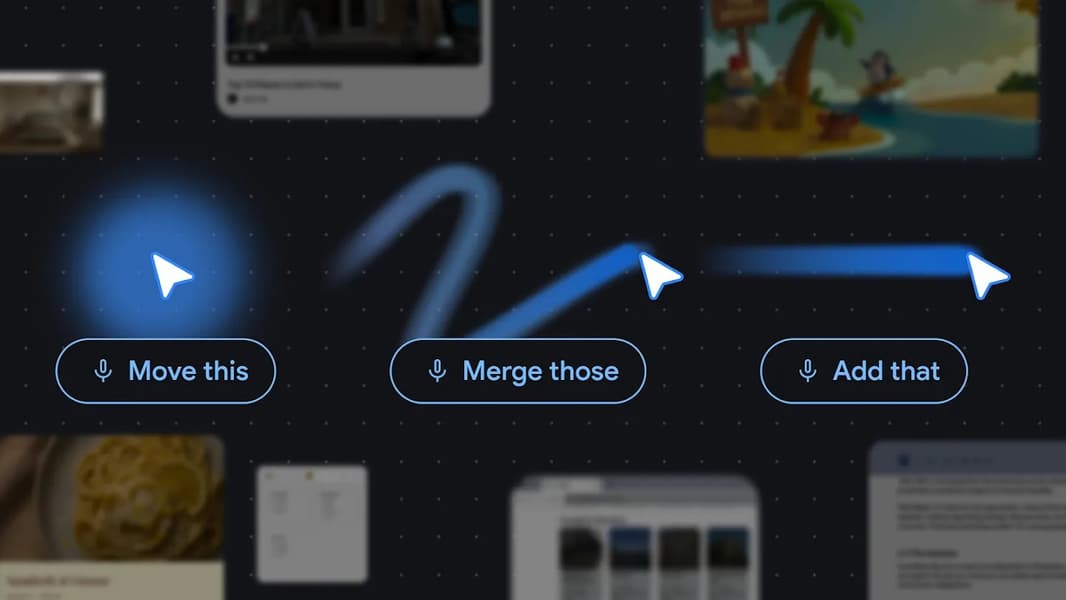

По сути, DeepMind пытается перенести в интерфейс естественную человеческую модель общения, где люди постоянно комбинируют речь и жесты. Вместо длинных инструкций человек обычно говорит: «передвинь это сюда» или «исправь вот здесь», а собеседник понимает контекст по жестам и ситуации. В Google считают, что современные мультимодальные модели вроде Gemini уже достаточно развиты, чтобы реализовать такую механику и для компьютеров.

Компания уже начала внедрять элементы новой концепции в свои продукты. В браузере Google Chrome появилась возможность вызывать Gemini поверх веб-страницы и задавать вопросы о конкретных элементах сайта. Пользователь может выделить несколько товаров и попросить сравнить их или указать место в комнате на изображении и запросить визуализацию новой мебели.

Кроме того, Google анонсировала функцию Magic Pointer для будущих ноутбуков Googlebook — устройств, которые компания проектирует как платформу для постоянного взаимодействия с ИИ. Экспериментальные функции также тестируются в Google AI Studio и лаборатории Google Labs Disco.

Фактически речь идёт о попытке переосмыслить сам интерфейс персонального компьютера в эпоху генеративного ИИ. Если раньше основным способом общения с компьютером были клавиатура и мышь, то теперь Google предлагает сделать курсор своего рода «лазерной указкой» для ИИ-агента, который понимает не только команды, но и намерение пользователя.

© iXBT