Большая фотоэкскурсия по московскому облаку 1cloud

Это — фотоэкскурсия по московскому дата-центру DataSpace, в котором размещается наше оборудование. Покажем системы безопасности ЦОД, серверные стойки и само железо.

Внимание — под катом много фото.

Мы в 1сloud предоставляем услуги аренды виртуальной инфраструктуры с 2012 года. Наш проект начал работу в Петербурге, но со временем мы расширили географию. Сегодня наше железо размещается в четырех дата-центрах: Xelent, Dataspace, Ahost и beCloud. Первый находится в Санкт-Петербурге, второй — в Москве, третий — в Алма-Ате (Казахстан), четвёртый — в Минске (Беларусь).

Во всех этих дата-центрах установлено примерно одинаковое оборудование. И далее мы расскажем, как оно размещается в московском дата-центре.

Безопасность дата-центра

Начнем показ с внешнего периметра дата-центра DataSpace. Здание обнесено пятиметровым мелкоячеистым забором с вращающимися шипами сверху и противоподкопной защитой. Проходы на территорию закрыты полноростовыми турникетами. Рядом с ними стоят посты службы безопасности.

Чтобы попасть «за забор», нужно предъявить бесконтактный ключ и пройти идентификацию на КПП. Если сотрудник забыл удостоверение (паспорт), ему придется идти за ним домой.

Следующий «рубеж» — бронированные шлюзовые кабины в зоне приема посетителей. В кабинах стоят считыватели карт доступа и сканеры отпечатка ладони.

Между кабинами можно увидеть две таблички Tier III. Dataspace — это первый дата-центр в России, который прошел три этапа сертификации Tier III от Uptime Institute.

На фото выше — сканер сетчатки глаза. Они установлены на входе во все помещения с критическим оборудованием инженерной инфраструктуры центра обработки. Помимо сканеров, доступ все так же контролируется электронными ключами.

Также на всей территории дата-центра ведется видеонаблюдение. По всему комплексу установлено более ста видеокамер, записи с которых хранятся не менее пяти лет.

Дата-центр предоставляет возможность организовать выделенное защищенное пространство (клетку).

Наше оборудование расположено в обычных стойках DataSpace. Мы арендуем стойки целиком. У нас большой объем оборудования, поэтому доступ к нему должен быть только у наших специалистов.

Электропитание и охлаждение

Один из наиболее заметных нюансов в зале — заземление. Шина медная и подключена к внешнему контуру заземления.

Согласно требованиям ЦОД, заземляется все оборудование, требующее для своей нормальной работы отдельной линии заземления, в соответствии со стандартом ГОСТ 12.1.030–81 (система стандартов безопасности труда).

Работы по подключению оборудования к сети электропитания и к шинам защитного заземления проводят исключительно сотрудники дата-центра. Все провода маркируются.

Хаотичное распределение кабелей приводит к потерям воздушного потока, что может вызвать перегрев оборудования и вывести его из строя. Чтобы исключить перегрев (и выполнить требования корпоративных стандартов качества выполняемых работ) в DataSpace кабели проложены в специальных лотках. В качестве бонуса эффективный кабель-менеджмент помогает снизить энергопотребление систем кондиционирования.

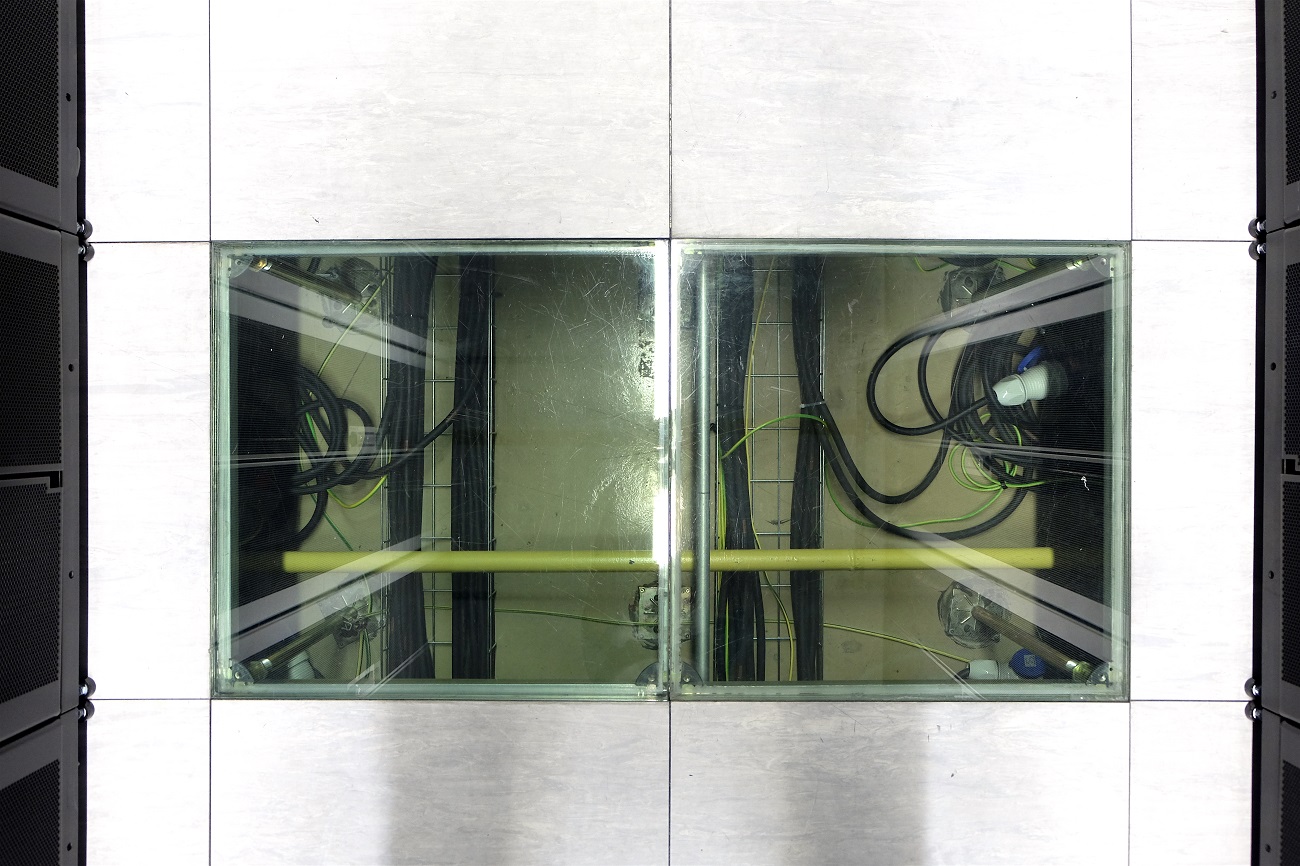

Стандартно, каждая стойка получает два независимых защищенных луча электропитания. Кабели электропитания проложены под фальшполом, высота которого составляет 60 см. Фальшпол можно трансформировать, изменять расположение плит. Это дает возможность при необходимости переставлять стойки с оборудованием.

В машинных залах дата-центра организованы холодные коридоры. Из них оборудование получает воздух для охлаждения и выдувает его в сторону горячего коридора. Холодный коридор отделен от горячего, чтобы избежать перемешивания воздуха и, опять же, сократить расходы на кондиционирование.

К слову, параметр энергоэффективности функционирования ЦОД DataSpace (этот параметр называется PUE) составляет 1,5. Он равен отношению общей мощности, потребляемой дата-центром, к мощности, потребляемой железом в стойках. Для сравнения, средний коэффициент PUE по Европе равняется 1,8.

Помимо кабель-менеджмента и холодных коридоров, достигнуть такого показателя энергоэффективности DataSpace помогает технология фрикулинга. ЦОД отключает чиллеры зимой и охлаждает машинные залы за счет холодного воздуха с улицы. Это позволяет значительно сократить траты электроэнергии и уменьшить счета за электричество.

Стойки и оборудование

В дата-центре двенадцать серверных залов площадью в 250 кв. метров каждый. Все они одинаковые и стоят на втором, третьем и четвёртом этажах. В каждом зале стоят примерно 88 стоек.

У каждого клиента ЦОД свои ключи от стоек с оборудованием. Дубликат есть у сотрудников DataSpace, поэтому если нужно сделать простую операцию с железом: заменить диск, переключить соединение, произвести реконфигурацию оборудования, необязательно высылать своего специалиста. Можно попросить об этом инженеров на месте — это нормальная практика, которая предоставляется в рамках клиентской поддержки ЦОД.

На фото ниже — подъемный стол, на котором перемещают серверы, коммутаторы и другое оборудование. Без таких «тележек» никак — вес отдельных шасси с дисками может составлять десятки килограмм. Если пришла большая поставка железа, сотрудники дата-центра могут предоставить эти тележки (и другой рабочий инструмент) в пользование.

Далее, покажем само железо. Начнем с системы хранения данных NetApp E2860. Максимальное количество поддерживаемых дисков — 60 штук. Пока что в ней заняты 30 слотов — там стоят 8-терабайтные накопители. Еще у нас есть более ранняя модель СХД — NetApp E2760.

Это довольно медленные системы, потому они используются в качестве холодного хранилища — там лежат бекапы.

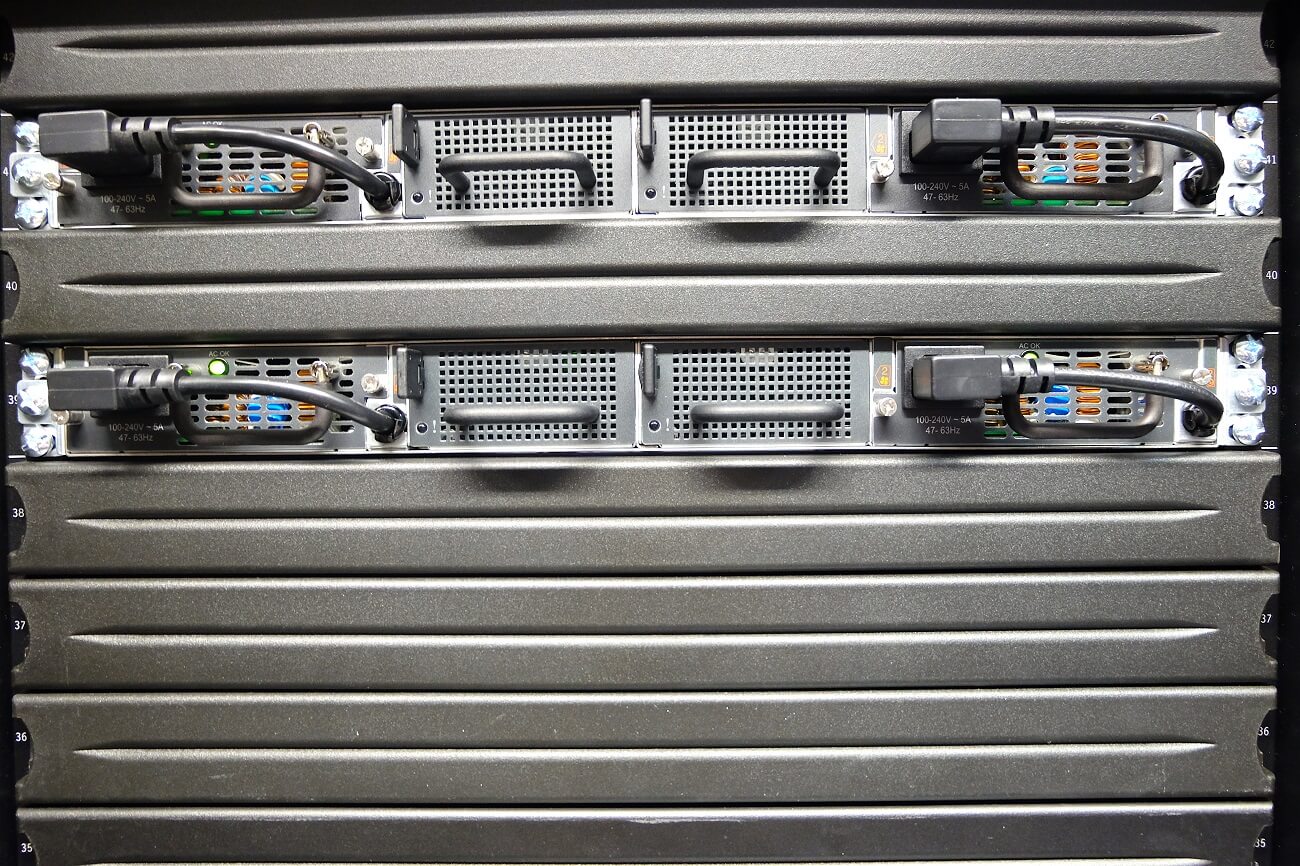

Сзади у NetApp E2860 расположились контроллеры и блоки электропитания.

Еще одна из установленных СХД — NetApp FAS2554 с полкой расширения DS4246. В ней стоят SATA-диски в количестве 24 штук. Каждый из них имеет объем в 4 ТБ. Это хранилище тоже отведено под бекапы и «медленные» датасторы.

Cisco UCS FI 6296 — свитчи комплекса Cisco UCS. Это центральные устройства, которые отвечают за подключение всех серверов в стойке к сетям 10GbE и Fibre Channel. Система имеет 48 фиксированных портов и слоты для трех расширительных модулей, каждый из которых добавляет еще 16 Ethernet-портов. При этом порты многофункциональны — они поддерживают технологию FCoE (Fibre Channel over Ethernet), которая позволяет переносить кадры Ethernet через FC.

К Cisco UCS FI 6296 подключаются серверные корзины Cisco UCS 5108 с блейд-серверами B200 M3, B200 M4 и B480 M5. В частности, модель B200 M3 имеет два 10-ядерных процессора Intel Xeon E5–2690 v2, а B200 M4 — два 20-ядерных процессора Intel Xeon E5–2698 v4.

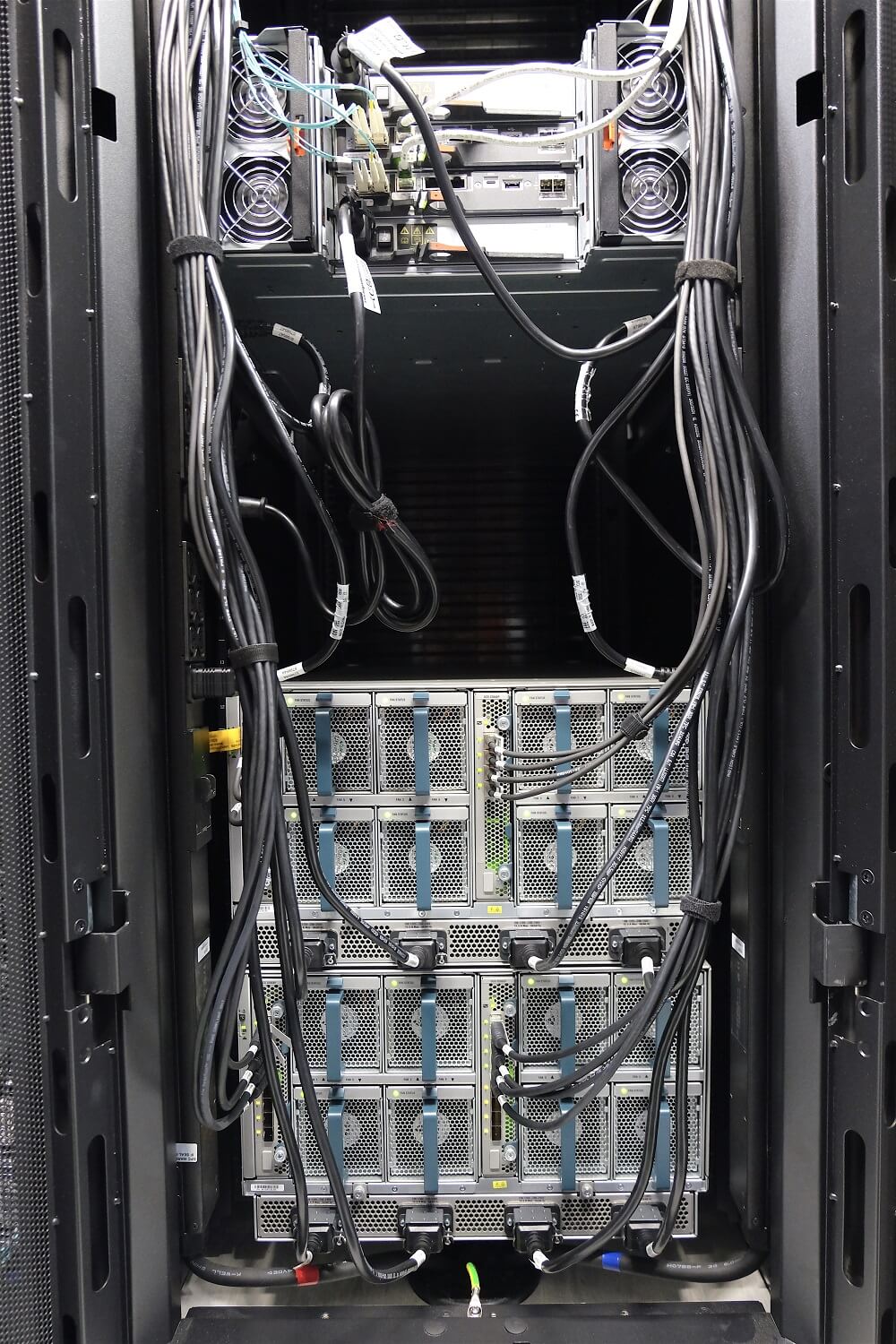

Здесь видно NetApp E2860, установленный в верхней части стойки и две корзины Cisco UCS 5108 внизу.

СХД NetApp AFF300, специально оптимизированная для работы с SSD-накопителями. Над ней расположилась полка DS224С с двадцатью четырьмя SSD-дисками по 7,6 ТБ.

Всего система NetApp AFF300 может обслуживать до 30 ПБ дискового пространства на быстрых «твердотельниках».

Управляют системой два 16-ядерных процессора Intel Broadwell-DE. Их частота составляет 1,70 ГГц. Каждый контроллер имеет четыре модуля оперативной памяти RDIMM ECC по 32 ГБ (это 128 ГБ в сумме). 120 ГБ выделено под кеш, а оставшиеся восемь — под энергонезависимую память NVRAM.

На фото выше — СХД NetApp FAS8040 с полками расширения DS2246. Это гибридные полки с SAS-дисками емкостью в 1,2 ТБ. Массивы серии FAS8000 тоже имеют многопроцессорные CPU от Intel и NVRAM. Они гарантируют уровень доступности системы не ниже 99,999%.

В этой СХД используются SSD-накопители, которые выступают в роли флеш-пула (flash pool).

Так выглядят NetApp FAS8040 и полки расширения DS2246 сзади с коммутационными проводами.

И, наконец, в наших стойках стоят кластерные свитчи NetApp CN1610. Они используются для объединения контроллеров FAS8040, FAS8080, AFF300 в единый кластер СХД (Clustered ONTAP).

На этом мы закончим нашу фотоэкскурсию по облаку 1cloud.

Если у вас есть вопросы о структуре и архитектуре облака, можете написать нам на почту: support@1cloud.ru. Наши специалисты помогут и проконсультируют.

Несколько постов из нашего корпоративного блога: