[Перевод] «Творчество» искусственного интеллекта меняет наши представления о реальном

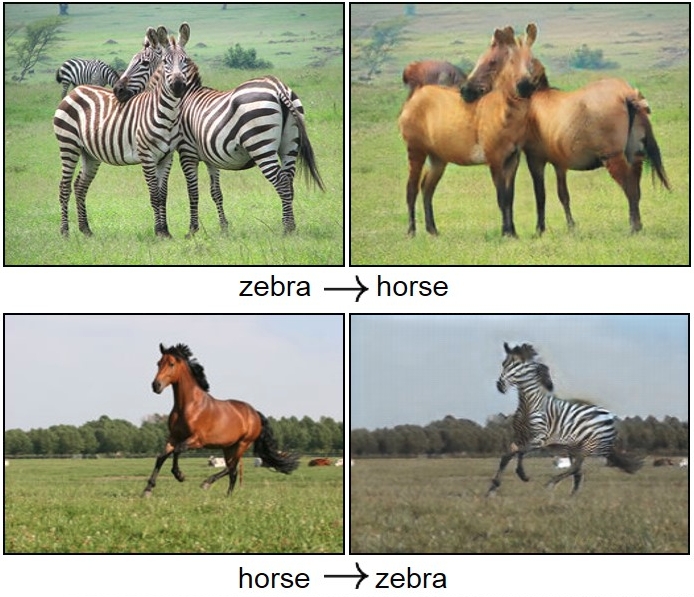

В этом году группа исследователей из Беркли выпустила два видео. В одном из них лошадь бегает за оградой. Во втором она внезапно получает черно-белый узор зебры. Результат не безупречен, но полоски так четко подходят лошади, будто генеалогическое древо этих животных поверглось в хаос. Подобный трюк — показатель развивающейся способности алгоритмов машинного обучения менять реальность.

Еще одни исследователи использовали нейросети для превращения фото черных медведей в правдоподобные изображения панд, яблок — в апельсины, а кошек — в собак. Один из пользователей Reddit использовал другой алгоритм машинного обучения для редактирования порновидео, и вставил туда лица знаменитостей. Стартап Lyrebird синтезирует вполне убедительную речь на основе одноминутной записи голоса человека. А инженеры Adobe, разрабатывающие платформу искусственного интеллекта Sensei, внедряют машинное обучение в новаторские инструменты для видео-, фото- и аудиомонтажа. Эти проекты сильно отличаются по своему происхождению и целям, но у них есть одна общая черта: они синтезируют картины и звуки, которые оказываются потрясающе похожими на настоящие. В отличие от предыдущих экспериментов, эти творения ИИ выглядят и звучат реалистично.

Технологии, лежащие в основе этих изменений, скоро подтолкнут нас к новым творческим сферам, увеличивая возможности современных художников и делая простых любителей профессионалами. Мы будем искать новые определения понятия творчества, которые расширят его горизонт и будут включать в себя творения машин. Но этот бум будет иметь и обратную сторону. Часть контента, созданного искусственным интеллектом, будет использоваться для обмана, зарождая страх бесконечной лавины фальшивых новостей. Старые дебаты о том, была ли изменена картинка, уступят место новым — о происхождении всех видов контента, включая текст. Вы начнете задаваться вопросом: какую роль сыграли люди (если вообще сыграли) в создании этого альбома/сериала/статьи?

Раньше существовало два способа создания аудио или видео, похожих на настоящие. Первый — использовать камеры и микрофоны для записи постановочной сцены. Второй — по максимуму задействовать человеческий талант, часто за огромные деньги, для создания точной копии. Теперь алгоритмы машинного обучения предлагают третий вариант, позволяя любому человеку с минимальными техническими знаниями изменить существующий контент для создания нового материала.

«Рождение Венеры» — версия Deep Dreams

Сначала контент, сгенерированный нейросетями, не был ориентирован на реалистичность. Deep Dreams от Google, выпущенная в 2015 году, была ранним примером использования глубокого обучения для штампования психоделических пейзажей и многоглазых гротескных произведений искусства. Приложение-хит 2016 года, Prisma, использовало глубокое обучение для улучшения фотофильтров, например, стилизации снимков под картины Мондриана или Мунка. Эта техника известна как перенос стиля: возьмите стиль одного изображения (например, «Крика») и примените его ко второму кадру.

Сейчас алгоритмы переноса стилей постоянно совершенствуются. Возьмем, к примеру, работу лаборатории Кавиты Балы из Корнельского университета. В ней показано, как глубокое обучение может перенести стиль одной фотографии (мерцающую ночную атмосферу) в снимок мрачного мегаполиса — и обмануть людей-рецензентов, которые будут думать, что это место реально. Вдохновленная потенциалом искусственного интеллекта распознавать эстетические свойства, профессор Бала стала соучредителем компании GrokStyle. Представим, что вам понравились декоративные подушки на диване у друга или одеяло в журнале. Покажите алгоритму GrokStyle это изображение, и он найдет изображения вещей в том же стиле.

Профессор Бала говорит: «Что мне нравится в этих технологиях, так это то, как они демократизируют дизайн и стиль. Я технолог: я ценю красоту и стиль, но даже близко не могу их создавать. А эта работа делает такие вещи доступными для меня. Также очень радует возможность сделать это доступным для других. То, что мы не одарены в этой сфере, не значит, что мы должны жить в скучной обстановке».

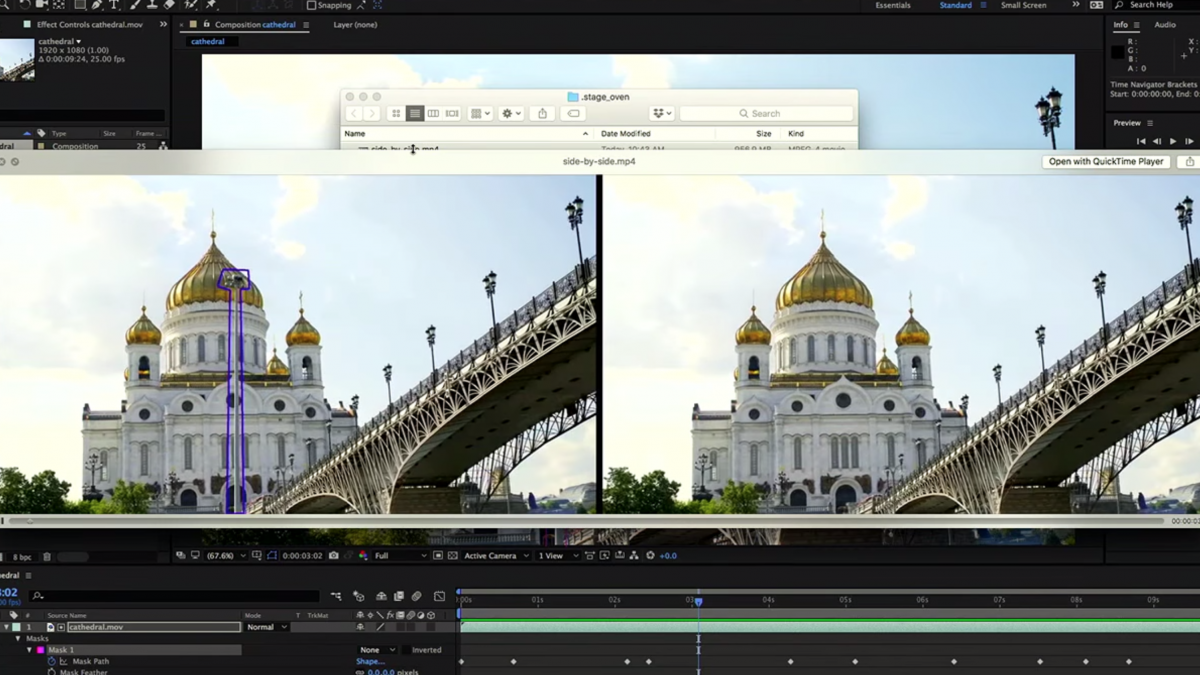

В Adobe машинное обучение является частью создания творческих продуктов уже более десяти лет, но недавно компания совершила огромный шаг вперед. В октябре инженеры, работающие над Sensei, продемонстрировали перспективный инструмент для редактирования видео под названием Adobe Cloak. Он позволяет пользователю легко удалить, скажем, фонарный столб из видеоклипа — задача, которая была бы ужасно мучительной даже для опытного монтажера. Другой проект, под названием Project Puppetron, применяет определенный художественный стиль к видео в реальном времени. Он позволяет отображать человека в виде ожившей бронзовой статуи или рисованного персонажа из мультфильма. «Вы можете просто делать что-то перед камерой и превращать это в анимацию в режиме реального времени», — говорит Джон Брандт, старший ученый и директор Adobe Research.

Машинное обучение делает эти проекты возможными, потому что оно умеет различать части лица и видеть разницу между передним и задним фонами лучше, чем предыдущие подходы к компьютерному зрению. Инструменты Sensei позволяют художникам работать не с материалами, а с концепциями. «Photoshop отлично справляется с управлением пикселями, но на самом деле люди пытаются манипулировать содержимым, отображаемым этими пикселями», — поясняет Брандт.

Это хорошая часть новости. Когда художникам больше не нужно тратить время на прорисовку отдельных точек на экране, их продуктивность возрастает. По словам Брандта, он очень рад возможности появления новых форм искусства и ждет, когда они придут.

Демонстрация возможностей Adobe Cloak

Но нетрудно представить, как этот творческий взрыв приводит к очень плохим последствиям. Юаньшунь Яо, выпускник Чикагского университета, увидел фейковое видео, созданное ИИ, и решил основать проект, исследующий опасности машинного обучения. В увиденном им ролике сгенерированный Барак Обама произносил речь. Яо захотел проверить, можно ли провернуть нечто подобное с текстовым материалом?

Строение текста должно быть почти безупречным, чтобы большинство читателей убедились в его «человеческом происхождении». Яо начал с относительно простой задачи — генерирование фейковых рецензий для Yelp и Amazon. Подобный текст может состоять всего из нескольких предложений и читатели не ожидают высокого уровня владения языком. Он и его коллеги создали нейросеть, создающую тексты по тематике Yelp длиной в 5 предложений. Полученные рецензии включали такие высказывания как «Теперь это наше любимое место!» и «Ходили туда с братом, заказали вегетарианскую пасту — очень вкусно». Дальше Яо спросил людей о том, настоящие или фейковые эти тексты — и конечно, люди довольно часто ошибались.

Стоимость написания подобных рецензий колеблется от 10 до 50 долларов, и Яо утверждает, что это лишь вопрос времени, пока кто-то не попытается автоматизировать процесс, снизив цены и наводнив площадку поддельными отзывами. Он также исследовал возможности нейросетей для защиты Yelp от поддельного контента — и добился некоторых успехов. Его следующая цель — генерирование правдоподобных новостных статей.

Что касается видеоконтента, то тут прогресс может двигаться еще быстрее. Хани Фарид, эксперт по обнаружению фейковых фото и видео и профессор Дартмутского колледжа, обеспокоен тем, как быстро распространяется вирусный контент и как отстает процесс распознавания его подлинности. Он допускает, что в ближайшем будущем появится правдоподобное видео, где Дональд Трамп отдает приказ ядерной атаки на Северную Корею. Оно станет вирусным и посеет панику — такую же, как когда-то вызвал радиоспектакль по «Войне миров». «Я не хочу делать истерических предположений, но не думаю, что опасения необоснованны», — говорит он.

Впрочем, сгенерированные выступления Трампа уже гуляют по Сети. Они — продукт Lyrebird, стартапа по синтезированию голоса. Хосе Сотело, сооснователь и гендиректор компании, убежден, что существование этой технологии неизбежно, так что он и его коллеги будут продолжать ее развивать — не забывая, конечно, об этике. Он уверен, что лучшая защита на сегодня — повышение осведомленности о возможностях машинного обучения. Сотело отмечает: «Если вы увидите мои фото на Луне, вы почти наверняка решите, что они сделаны в графическом редакторе. Но если вы услышите аудиозапись, где лучший друг говорит о вас гадости, скорее всего, вы будете обеспокоены. Это действительно новая технология, и она предъявляет человечеству новые вызовы».

Вряд ли что-то сможет остановить волну сгенерированного ИИ контента. Не исключен сценарий, при котором мошенники и недобросовестные политики будут использовать технологии для создания вводящей в заблуждение информации.

Положительная сторона — в том, что сгенерированный ИИ контент может также оказать огромную услугу обществу. Сотело из Lyrebird мечтает, что его технология сможет вернуть способность разговаривать людям, потерявшим голос из-за бокового амиотрофического склероза или рака. А видео с лошадьми и зебрами, о котором говорилось в начале, стало побочным результатом работы по улучшению зрения беспилотных автомобилей. Программное обеспечение для таких машин сначала обучается в виртуальной среде. Но мир наподобие Grand Theft Auto напоминает реальность очень отдаленно. Алгоритм «зебрификации» был создан, чтобы сократить разрыв между виртуальной средой и реальным миром, чтобы в конечном итоге сделать беспилотные авто безопаснее.