[Перевод] Почему запрет на автономных роботов-убийц ничего не решит

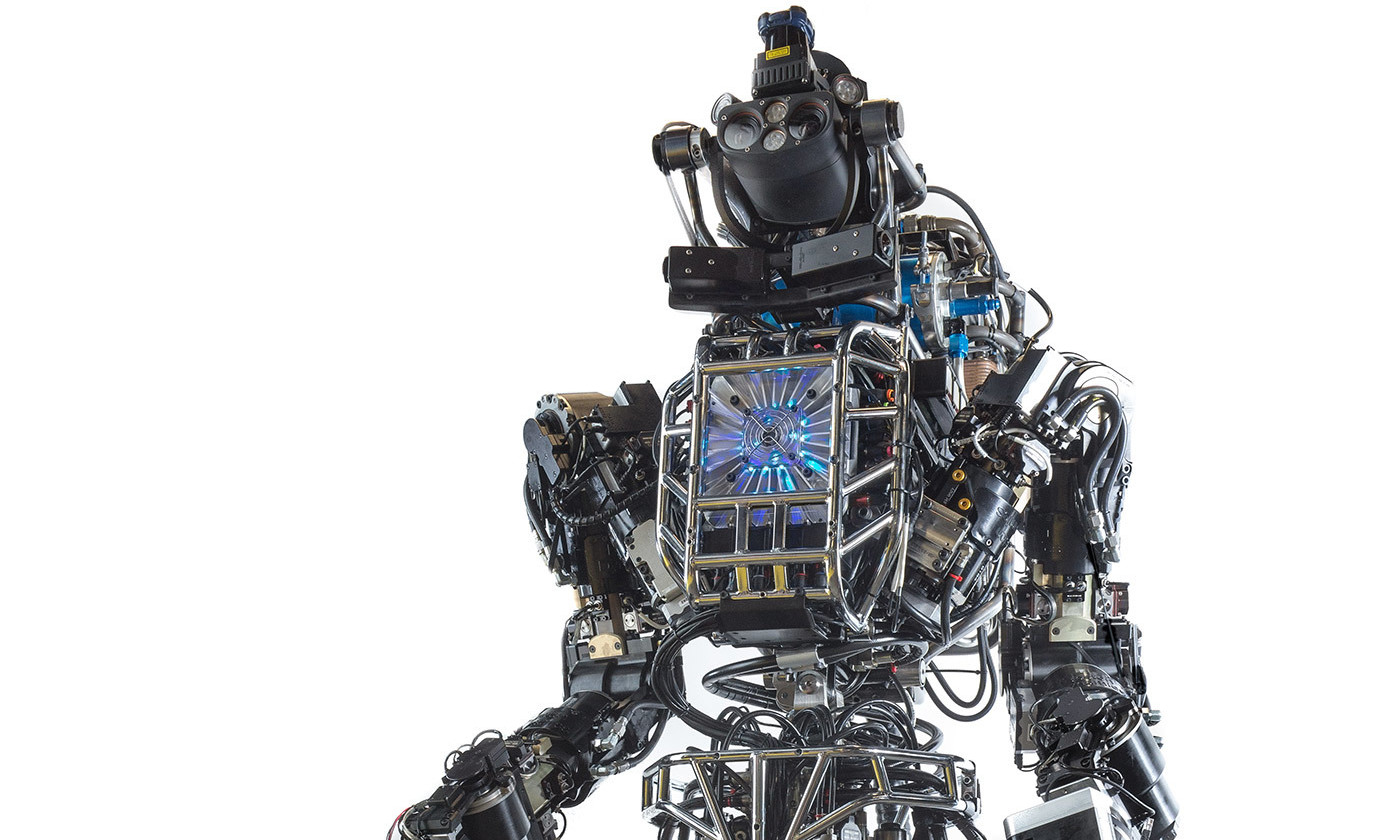

Автономное оружие — роботы-убийцы, способные атаковать без участия человека — это очень опасный инструмент. По этому поводу нет никаких сомнений. Как изложили в своём открытом письме в ООН подписавшиеся под ним Илон Маск, Мустава Сулейман [сооснователь ИИ-компании DeepMind / прим. перев.] и другие авторы, автономное оружие может стать «оружием устрашения, оружием, которое тираны и террористы смогут использовать против невинного населения, оружием, которое можно будет взломать и заставить работать нежелательными способами».

Но это не значит, что ООН должна ввести превентивный запрет на дальнейшие исследования подобного рода оружия, как призывают авторы письма.

Во-первых, иногда опасные инструменты нужны для достижения достойных целей. Вспомните о геноциде в Руанде, когда мир стоял в стороне и ничего не делал. Если бы в 1994 году существовало автономное оружие, возможно, мы бы не смотрели в сторону. Кажется вероятным, что если бы стоимость гуманитарных интервенций можно было бы измерить только деньгами, было бы проще получить поддержку общественности на подобные интервенции.

Во-вторых, наивно полагать, что мы можем наслаждаться преимуществами недавних прорывов в ИИ, без того, чтобы не испытывать и некоторые из их недостатков. Допустим, ООН введёт превентивный запрет на любые технологии автономных вооружений. Также допустим — уже довольно оптимистично — что все армии мира будут уважать этот запрет, и отменят программы разработки автономного оружия. И даже тогда нам всё равно придётся беспокоиться по этому поводу. Робомобиль можно легко превратить в автономную систему вооружения: вместо того, чтобы объезжать пешеходов, можно научить его переезжать их.

Говоря обобщённо, технологии ИИ чрезвычайно полезны и уже проникают в нашу жизнь, даже если иногда мы этого и не видим и не можем полностью осознать. Учитывая это проникание было бы близоруко думать, что можно запретить злоупотребление технологиями, просто запретив разработку автономного оружия. Возможно, именно сложные и выборочно действующие системы автономного вооружения, разрабатываемые разными армиями по всему миру, смогут эффективно противостоять более грубому автономному оружию, которое легко разработать, перепрограммировав кажущуюся мирной технологию ИИ, такую, как те же робомобили.

Более того, идея о простом запрете на международном уровне выдаёт чрезмерно упрощённый подход к рассмотрению автономных вооружений. Такая концепция не признаёт долгой истории причин и следствий действий и договорённостей разных стран между собой и в одиночку, которые путём тысяч мелких действий и упущений привели к развитию таких технологий. Пока дебаты об автономном оружии ведутся в основном на уровне ООН, можно простить среднего гражданина, солдата или программиста за то, что он не предполагает у себя моральных обязательств за вред, наносимый автономным оружием. Но это очень опасное предположение, которое может привести к катастрофе.

Все люди, которые каким-то образом имеют отношение к технологиям автоматического вооружения, должны проявлять должную осмотрительность, и каждый из нас обязан тщательно думать о том, какой вклад его действие или бездействие вносит в список потенциальных опасностей этой технологии. Это не значит, что у стран и международных агентств нет своей важной роли. Это подчёркивает тот факт, что если мы хотим устранить потенциальную опасность автоматического оружия, то необходимо пропагандировать этику персональной ответственности, и эта пропаганда должна дойти до самых нижних уровней, на которых принимаются решения. Для начала чрезвычайно важно подробно и полностью рассказывать о развитии автономного вооружения — включая и следствия действий всех тех, кто принимает решения на всех уровнях.

Наконец, иногда утверждается, что автономное оружие опасно не потому, что этот инструмент опасен сам по себе, а потому, что оно может стать самостоятельным и начать действовать в своих интересах. Это ошибочное заблуждение, и к тому же, эту опасность запрет на разработку автономного вооружения никак не поможет предотвратить. Если сверхинтеллект — это угроза для человечества, нам срочно необходимо искать способы эффективно противостоять этой угрозе, и делать это независимо от того, будет ли и далее разрабатываться технология автоматического вооружения.

Открытое письмо к Конвенции Объединённых Наций по поводу некоторых обычных видов вооружения

Поскольку некоторые компании создают технологии, связанные с искусственным интеллектом и робототехникой, которые можно перенаправить на разработку автономного вооружения, мы чувствуем особую ответственность за поднятие этой тревоги. Мы тепло приветствуем решение конференции ООН по принятию «Конвенции о конкретных видах обычного оружия» о назначении группы правительственных экспертов (Group of Governmental Experts, GGE) по летальным автономным системам вооружения. Многие из наших исследователей и инженеров готовы давать технологические консультации для помощи в рассмотрении этого вопроса.

Мы одобряем назначение посла Амандипа Сингха Гилла от Индии председателем GGE. Мы просим Высокие Договаривающиеся Стороны, участвующие в GGE, активно работать над поиском способов предотвращения гонки такого рода вооружений, защиты граждан от их неправильного использования и избегания дестабилизирующих эффектов этих технологий. Мы сожалеем, что первая встреча GGE, назначенная на август 2017 г ода, была отменена из-за того, что некоторые страны не сделали финансовый взнос в ООН. Мы призываем Высокие Договаривающиеся Стороны удвоить усилия на первой встрече GGE, которая должна состояться в ноябре.

Детальное автономное оружие угрожает совершить третью революцию в военном деле. После его разработки оно позволит вести военные конфликты на масштабах, невиданных ранее, и на временных отрезках меньших, чем способен воспринять человек. Оно может стать оружием устрашения, оружием, которое тираны и террористы смогут использовать против невинного населения, оружием, которое можно будет взломать и заставить работать нежелательными способами. У нас осталось мало времени. После открытия этого ящика Пандоры его будет уже сложно закрыть. Поэтому мы просим Высокие Договаривающиеся Стороны найти способы защитить нас всех от этих угроз.