Программу предсказания преступлений обвинили в расизме

Правоохранительные органы США несколько лет используют в своей работе специальные программы, которые анализируют статистику преступлений и выдают рекомендации. Например, в Калифорнии программа рассчитывает оптимальный маршрут патрулей с учётом вероятности преступлений в каждом районе города в определённое время суток. Полиция Чикаго в 2014 году составила список наблюдения с именами 400 наиболее вероятных преступников в будущем. Алгоритм предсказания преступников и будущих жертв беспокоит правозащитников, хотя он показал удивительную точность (более 70% жертв огнестрела в Чикаго в 2016 году были в списке, заранее составленном программой).

В последнее время аналитические программы начали использовать в судах. Судья должен определить, наказать преступника по минимальной или максимальной строгости, предусмотренной законом для конкретного преступления. В этом случае программа на основе имеющихся данных вычисляет так называемый «показатель оценки риска» (risk assessment score). Этот показатель определяет вероятность повторения преступления и, соответственно, влияет на тяжесть приговора.

Так вот, тщательный анализ результатов работы программы, проведённый ProPublica, выявил странную тенденцию: по какой-то причине для афроамериканцев (негров) программа выдаёт более высокую оценку риска, чем для белых. Другими словами, алгоритм проявляет расовую дискриминацию! И это при том, что эту программу специально внедряли в судебную систему именно для того, чтобы исключить такую дискриминацию.

Показатель оценки риска очень важен. Он влияет и на тяжесть приговора, и на размер суммы, под которую подозреваемого выпускают под залог, а также на выбор меры пресечения и многое другое.

Журналисты ProPublica провели анализ более 7000 дел в округе Броуард (Флорида), где показатель оценки риска для подозреваемого вычисляет одна из самых популярных такого рода программ от компании Northpointe.

Как выяснилось, только 20% подозреваемых, по которым программа определила высокий риск совершения преступлений, действительно совершили его в течение двух лет после выставления риска. Даже если учитывать мелкие нарушения вроде выхода за периметр домашнего ареста, «точность работы программы чуть больше, чем подбрасывание монетки».

Но самое ужасное, что программа проявляет расовую дискриминацию. Показатели оценки риска для афроамериканцев гораздо выше, чем для белых преступников. Ошибочное предсказание рецидива для чернокожих вдвое выше, чем для белых.

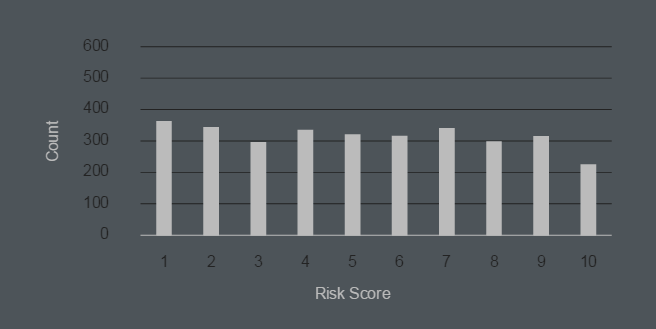

Показатель оценки риска для афроамериканцев (1 — минимальный, 10 — максимальный)

Показатель оценки риска для белых (1 — минимальный, 10 — максимальный)

Исследователи делают вывод, что программа нарушает закон, специально учитывая фактор цвета кожи как один из параметров для определения вероятности преступления в будущем.

Компания Northpointe уверяет, что раса подозреваемого ни в коем случае не учитывается при анализе. Но учитываются другие факторы, которые сильно коррелируют с расой: уровень образования, статус занятости, криминальная история родственников, приём запрещённых наркотиков друзьями/знакомыми и т.д. Вес каждого фактора в итоговой оценке засекречен — это проприетарный алгоритм компании Northpointe.