[Перевод] Почему AlphaGo – это не искусственный интеллект

Что можно назвать ИИ, а что нельзя — в некотором смысле зависит от определения. Нельзя отрицать, что AlphaGo — ИИ, играющий в го, разработанный командой Google DeepMind и обыгравший чемпиона мира –, а также похожие системы с глубинным обучением за последние несколько лет смогли решить довольно сложные вычислительные проблемы. Но приведут ли они нас к настоящему, полному ИИ, к обобщённому интеллекту, или ОИ? Вряд ли — и вот, почему.

Одна из ключевых особенностей ОИ, с которой приходится иметь дело при его создании — он должен быть способен самостоятельно разобраться с окружающим миром и разработать своё, внутреннее понимание всего, с чем он встретится, что услышит, скажет или сделает. Иначе у вас на руках окажутся современные ИИ-программы, смысл которых был заложен разработчиком приложения. ИИ, по сути, не понимает, что происходит и его область специализации очень узка.

Проблема смысла — возможно, самая фундаментальная из задач ИИ, и она до сих пор не решена. Одним из первых выразивших её людей стал когнитивист Стеван Харнад, написавший в 1990 году работу «Задача сопоставления символов». Даже если вы не верите в то, что мы манипулируем именно символами, задача всё равно остаётся: сопоставление представления, существующего внутри системы, с реальным миром.

Для конкретики заметим, что задача осмысления приводит нас к четырём подзадачам:

1. Как структурировать информацию, которую личность (человек или ИИ) получает из окружающего мира?

2. Как связывать эту структурированную информацию с миром, то есть, как построить понимание мира личностью?

3. Как синхронизировать это осмысление с другими личностями? (В противном случае общение окажется невозможным, и интеллект получится необъяснимым и обособленным).

4. Почему личность что-то делает? Как запустить всё это движение?

Первая проблема, структурирование, хорошо решается через глубинное обучение и подобные обучающие алгоритмы, не требующие надзора — оно, к примеру, используется в AlphaGo. В этой области мы достигли значительных успехов, в частности благодаря недавнему росту вычислительных мощностей и использованию GPU, которые особенно хорошо распараллеливают обработку информации. Эти системы работают, принимая на вход чрезмерно избыточный сигнал, выраженный в многомерном пространстве, и сводят его к сигналам меньших измерений, минимизируя при этом потерю информации. Иначе говоря, они захватывают важную часть сигнала с точки зрения обработки информации.

Вторая проблема, проблема связи информации с реальным миром, то есть, создание «осмысления», непосредственно связана с роботизацией. Для взаимодействия с миром вам необходимо тело, а для построения этой связи вам необходимо взаимодействовать с миром. Поэтому я часто утверждаю, что без роботизации нет и ИИ (хотя бывают отличные роботы без ИИ, но это уже другая история). Это часто называют «проблемой воплощения», и большинство исследователей ИИ соглашаются, что интеллект и воплощение тесно связаны. В разных телах существуют разные формы интеллекта, что легко можно видеть по животным.

Всё начинается с таких простых вещей, как поиск смысла в ваших собственных частях тела и том, как их контролировать для достижения нужного эффекта в обозримом мире, как строится ощущение пространства, расстояния, цвета, и т.д. В этой области подробные исследования проводил такой учёный, как Дж. Кевин О'Реган, известный своей «сенсомоторной теорией сознания». Но это лишь первый шаг, поскольку затем необходимо будет строить всё больше и больше абстрактных концепций на базе этих приземлённых сенсомоторных структур. Мы пока ещё не добрались до этого, но исследования на эту тему уже ведутся.

Третья проблема — вопрос происхождения культуры. У некоторых животных прослеживаются простейшие формы культуры и даже передаваемые через поколения способности, но в очень ограниченном объёме, и лишь люди достигли того порога экспоненциального роста приобретённого знания, который мы зовём культурой. Культура — катализатор интеллекта, и ИИ, не обладающий возможностью культурного взаимодействия, будет представлять лишь академический интерес.

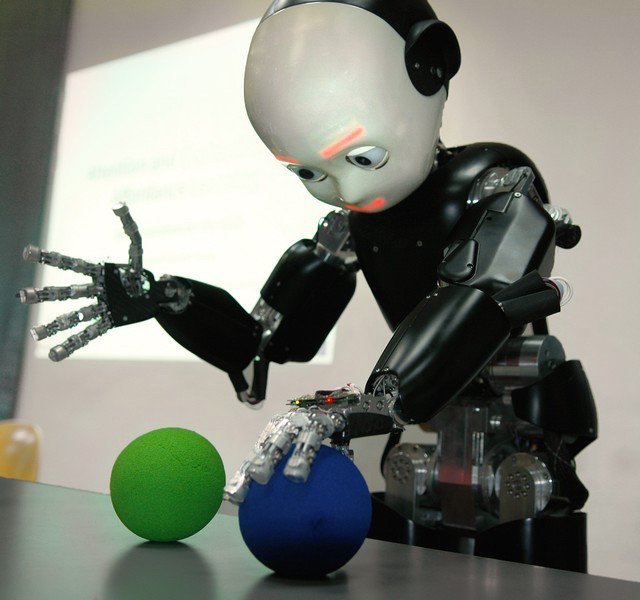

Но культуру нельзя вручную ввести в машину в виде кода. Она должна стать результатом процесса обучения. Лучший способ искать пути к пониманию этого процесса — психология развития. Работу на эту тему проделали Жан Пьяже [Jean Piaget] и Майкл Томасело [Michael Tomasello], изучавшие процесс приобретения культурологических знаний детьми. Этот подход породил новую дисциплину робототехники, «робототехническое развитие», берущую ребёнка в качестве модели (как в случае с роботом iCub на иллюстрации).

Также этот вопрос тесно связан с исследованием процесса обучения языку, а это одна из тем, которые изучаю и лично я. Работы таких людей, как Люк Стилс [Luc Steels] и др. показали, что процесс приобретения языка можно сравнить с эволюцией: личность создаёт новые понятия, взаимодействуя с миром, используя их для общения с другими личностями, и выбирает структуры, помогающие общаться успешнее других (в основном для достижения совместных целей). После сотен проб и ошибок, как и в случае биологической эволюции, система порождает наилучшее понятие и его синтаксический/грамматический перевод.

Этот процесс проверяли экспериментально, и он удивительно похож на то, как эволюционируют и растут естественные языки. Также он отвечает за мгновенное обучение, когда личность воспринимает концепцию сразу — такие вещи не способны объяснить такие основанные на статистике модели, как глубинное обучение. Сейчас несколько исследовательских лабораторий при помощи этого подхода пытаются пройти дальше по пути восприятия грамматики, жестов и более сложных культурных явлений. Конкретно это AI Lab, основанная мною во французской компании, занимающейся робототехникой Aldebaran. Сейчас она стала частью группы SoftBank Group — именно они создали роботов Nao, Romeo и Pepper (внизу).

И, наконец, четвёртая проблема сталкивается с «внутренней мотивацией». Почему личность вообще что-то делает, а не просто находится в покое. Требований к выживанию недостаточно для объяснения человеческого поведения. Даже если накормить и обеспечить безопасность человека, он не сидит в ожидании возвращения голода. Люди изучают окружения, пытаются что-то сделать, и движет ими какая-то форма присущего им любопытства. Исследователь Пьер-Ив Удейер [Pierre-Yves Oudeyer] показал, что простейшего математического выражения любопытства в виде стремления личности к максимизации скорости обучения достаточно для появления удивительно сложного и неожиданного поведения (см., к примеру, эксперимент с «игровой площадкой», проведённый в Sony CSL).

Судя по всему, нечто подобное необходимо системе, чтобы побудить в ней желание пройти через три предыдущих шага: структурировать информацию о мире, объединить её со своим телом и создать осмысленные понятия, а затем выбрать из них наиболее эффективные с точки зрения коммуникации, чтобы создать совместную культуру, в которой возможна кооперация. Именно это, с моей точки зрения, и есть программа ОИ.

Повторюсь, что быстрое развитие глубинного обучения и недавние успехи таких ИИ в играх типа го — это очень хорошие новости, поскольку такой ИИ найдёт много точек приложения в медицинских исследованиях, индустрии, сохранении окружающей среды и в других областях. Но это только одна часть проблемы, что я и пытался здесь объяснить. Я не верю, что глубинное обучение — это панацея, которая приведёт нас к настоящему ИИ, в смысле машины, способной научиться жить в мире, взаимодействовать с нами естественным образом, понимать сложность наших эмоций и культурных искажений и в итоге помочь нам сделать мир лучше.